对抗性分割损失素描着色

点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

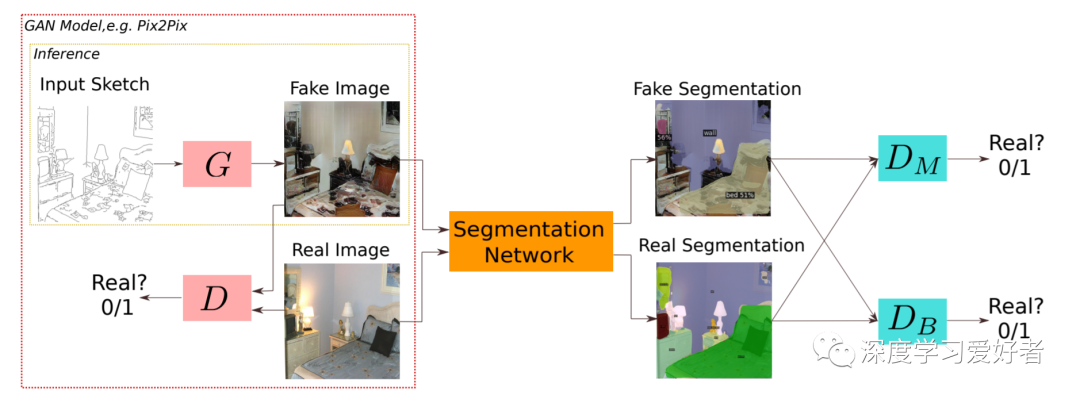

作者介绍了一种新的从草图或边缘图生成彩色图像的方法。目前的方法要么需要某种形式的额外用户指导,要么仅限于成对翻译方法。作者认为,分割信息可以为草图着色提供有价值的指导。为此,作者建议利用通用pantoptic分割网络提供的语义图像分割来创建额外的对抗性损失函数。作者的损失功能可以集成到任何基线GAN模型。作者的方法不局限于包含分割标签的数据集,并且可以训练它用于未配对的翻译任务。通过定性、定量和用户研究分析,作者在四个不同的数据集上展示了作者的方法的有效性。作者的模型在FID度量上提高了35个基准点。

代码链接:https://github.com/giddyyupp/AdvSegLoss

针对基于草图的图像着色问题,提出了一种利用语义分割的新方法。作者引入了三种模型来考虑图像转换过程中不同层次的分割反馈。作者的模型可以集成到任何配对或未配对的GAN模型中。作者通过广泛的评估证明了使用分割线索的有效性。作者在本文中的贡献可以总结如下。

作者提出在GAN模型中使用通用语义分割作为额外的对抗性损失,以解决草图着色问题。Ground-truth分割标签不是作者方法的要求。

作者的方法既不特定于某一领域(如人脸、艺术、动漫等),也不局限于配对方法。

作者对四个不同的数据集进行了广泛的评估,包括配对和非配对设置,并通过定性、定量和用户研究分析显示了作者的方法的有效性。

作者提出的模型具有对抗性分割损失的草图着色。

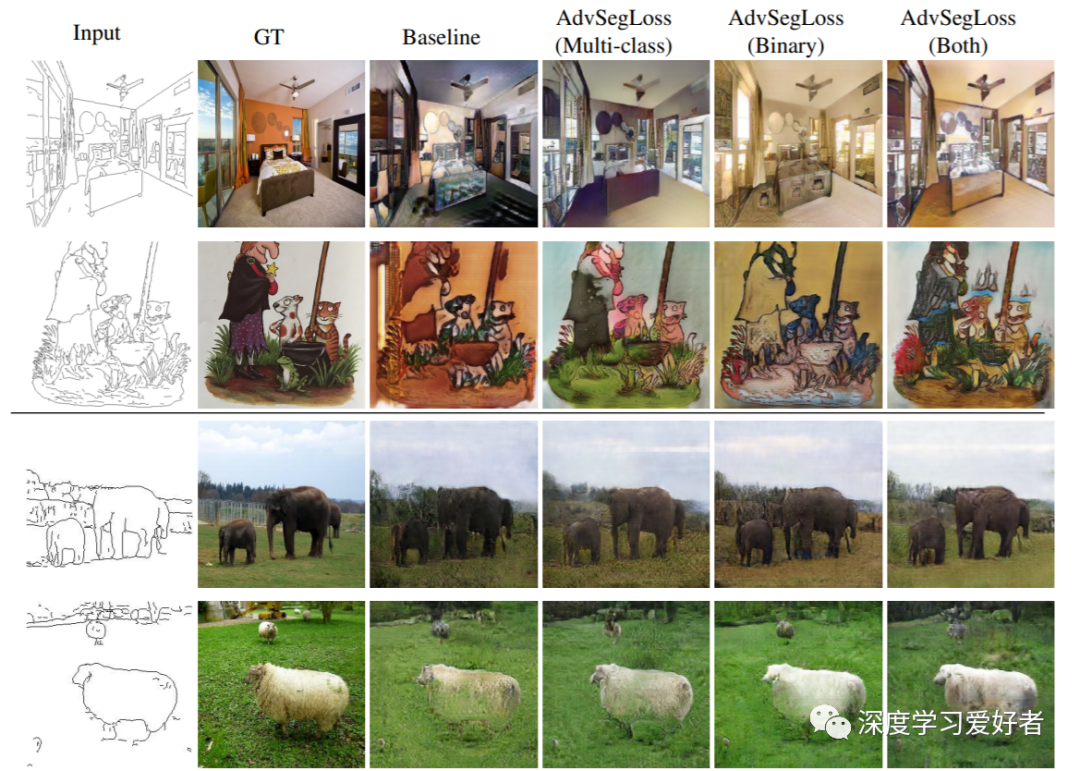

使用不同设置的基线(CycleGAN和Pix2Pix)和模型的样本结果。每行输入的图像分别来自卧室、插图、大象和绵羊数据集。前两行显示未配对训练的结果,后两行显示配对训练的结果。在卧室数据集和大象数据集上,在插图数据集和绵羊数据集上,两种训练方案都得到了最好的结果。

本文提出了一种解决草图着色问题的新方法。作者的方法利用了一个通用的图像分割网络,并在常规GAN丢失的基础上增加了一个对抗性分割损失(AdvSegLoss)。AdvSegLoss可以集成到任何GAN模型,并工作,即使数据集没有分割标签。作者使用CycleGAN和Pix2Pix作为GAN模型的基线。作者对各种数据集进行了广泛的评估,包括卧室、绵羊、大象和插图图像,并从定量(使用FID分数)和定性(通过用户研究)两方面评估性能。作者表明,作者的模型在所有数据集上的FID分数和用户研究分析都优于基线。

由于作者方法的局限性,虽然作者在定性和定量上都改进了基线,特别是大象和绵羊的结果缺乏真实性。即使成对的训练结果在这两个数据集上看起来也不吸引人(图3的最后两行),这很可能是由于基线模型在生成复杂场景方面不太成功。消融研究需要将wg、wb和wm设置为最优值。

论文链接:https://arxiv.org/pdf/2102.06192.pdf

每日坚持论文分享不易,如果喜欢我们的内容,希望可以推荐或者转发给周围的同学。

- END -

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~