开源爬虫框架 Scrapy 快速入门

一、Scrapy 简介

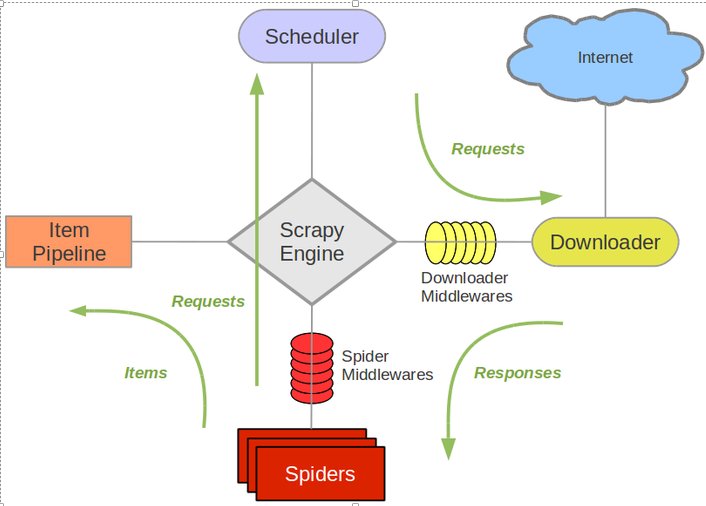

1.1 Scrapy 框架

ENGIINE:整个框架的控制中心, 控制整个爬虫的流程。根据不同的条件添加不同的事件(就是用的 Twisted) SCHEDULER:事件调度器 DOWNLOADER:接收爬虫请求,从网上下载数据 SPIDERS:发起爬虫请求,并解析 DOWNLOADER返回的网页内容,同时和数据持久化进行交互,需要开发者编写ITEM PIPELINES:接收 SPIDERS解析的结构化的字段,进行持久化等操作,需要开发者编写MIDDLEWARES: ENGIINE和SPIDERS、ENGIINE和DOWNLOADER之间一些额外的操作,hook 的方式提供给开发者

SPIDERS(要爬什么网站,怎么解析)和 ITEM PIPELINES(如何处理解析后的内容)就可以了。其他的都是有框架帮你完成了。

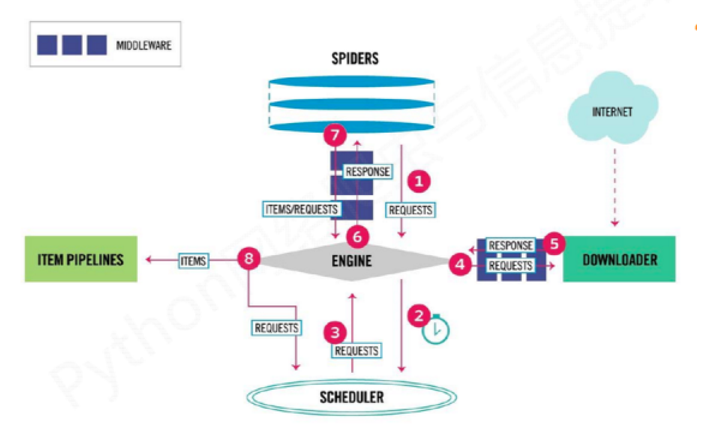

1.2 Scrapy 数据流

1、SPIDERS 发爬虫请求给 ENGIINE, 告诉它任务来了2、ENGIINE 将请求添加到 SCHEDULER 调度队列里,说任务就交给你了,给我安排好3、SCHEDULER 看看手里的爬取请求很多,挑一个给 ENGIINE, 说大哥帮忙转发给下载 DOWNLOADER4、ENGIINE:好的, DOWNLOADER 你的任务来了5、DOWNLOADER:开始下载了,下载好了。任务结果交给 ENGIINE6、ENGIINE 将结果给 SPIDERS,你的一个请求下载好了,快去解析吧7、SPIDERS:好的,解析产生了结果字段。又给 SPIDERS 转发给 ITEM PIPELINES8、ITEM PIPELINES:接收到字段内容,保存起来。ENGIINE 夹在中间当传话筒,能不能直接跳过?可以考虑跳过了会怎么样。SCHEDULER的作用:任务调度, 控制任务的并发,防止机器处理不过来ENGIINE:就是基于Twisted框架, 当事件来(比如转发请求)的时候,通过回调的方式来执行对应的事件。ENGIINE让所有操作变的统一,都是按照事件的方式来组织其他组件, 其他组件以低耦合的方式运作;对于一种框架来说,无疑是必备的。

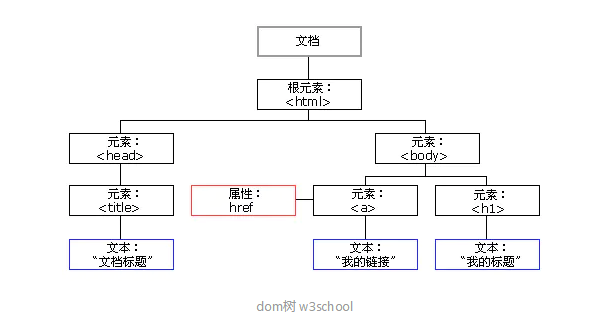

二、基础:XPath

XPath 来解析网页,提取内容。2.1 HTML 节点和属性

2.2 解析语法

a / b:‘/’ 在 xpath 里表示层级关系,左边的 a 是父节点,右边的 b 是子节点 a // b:表示 a 下所有 b,直接或者间接的 [@]:选择具有某个属性的节点 //div[@classs], //a[@x]:选择具有 class 属性的 div 节点、选择具有 x属性的 a 节点 //div[@class="container"]:选择具有 class 属性的值为 container 的 div 节点 //a[contains(@id, "abc")]:选择 id 属性里有 abc 的 a 标签

response.xpath('//div[@class="taglist"]/ul//li//a//img/@data-original').get_all()

# 获取所有class属性(css)为taglist的div, 下一个层ul下的所有li下所有a下所有img标签下data-original属性

# data-original这里放的是图片的url地址

三、安装部署

lxml:一个高效的 XML 和 HTML 解析器 parsel:一个写在 lxml 上面的 html/xml 数据提取库 w3lib:用于处理 URL 和网页编码的多用途帮助程序 twisted:异步网络框架 cryptography 和 pyOpenSSL:处理各种网络级安全需求

# 安装

pip install scrapy

四、创建爬虫项目

scrapy startproject sexy

# 创建一个后的项目目录

# sexy

# │ scrapy.cfg

# │

# └─sexy

# │ items.py

# │ middlewares.py

# │ pipelines.py

# │ settings.py

# │ __init__.py

# │

# ├─spiders

# │ │ __init__.py

# │ │

# │ └─__pycache__

# └─__pycache__

# 执行 需要到scrapy.cfg同级别的目录执行

scrapy crawl sexy

spiders 里的具体的 spider 类和 items.py 和 pipelines.py(对应的 ITEM PIPELINES)五、开始 Scrapy 爬虫

5.1 简单而强大的 spider

类要继承 scrapy.Spider取一个唯一的 name 爬取的网站 url 加到 start_urls 列表里 重写 parse利用 xpath 解析 reponse 的内容

parse 实现的时候没有转发给 ITEM PIPELINES,直接处理了。这样简单的可以这么处理,如果业务很复杂,建议交给 ITEM PIPELINES。# 目录结果为:spiders/sexy_spider.py

import scrapy

import os

import requests

import time

def download_from_url(url):

response = requests.get(url, stream=True)

if response.status_code == requests.codes.ok:

return response.content

else:

print('%s-%s' % (url, response.status_code))

return None

class SexySpider(scrapy.Spider):

# 如果有多个spider, name要唯一

name = 'sexy'

allowed_domains = ['uumdfdfnt.94demo.com']

allowed_urls = ['http://uumdfdfnt.94demo.com/']

# 需要爬取的网站url加到start_urls list里

start_urls = ['http://uumdfdfnt.94demo.com/tag/dingziku/index.html']

save_path = '/home/sexy/dingziku'

def parse(self, response):

# 解析网站,获取图片列表

img_list = response.xpath('//div[@class="taglist"]/ul//li//a//img/@data-original').getall()

time.sleep(1)

# 处理图片, 具体业务操作, 可交给items, 见5.2 items例子

for img_url in img_list:

file_name = img_url.split('/')[-1]

content = download_from_url(img_url)

if content is not None:

with open(os.path.join(self.save_path, file_name), 'wb') as fw:

fw.write(content)

# 自动下一页(见5.3 自动下一页)

next_page = response.xpath('//div[@class="page both"]/ul/a[text()="下一页"]/@href').get()

if next_page is not None:

next_page = response.urljoin(next_page)

yield scrapy.Request(next_page, callback=self.parse)

5.2 items 和 pipline 例子

items:提供一个字段存储, spider 会将数据存在这里 pipline:会从 items 取数据,进行业务操作,比如 5.1 中的保存图片;又比如存储到数据库中等

items.py 其实就是定义字段 scrapy.Field()

import scrapy

class SexyItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

img_url = scrapy.Field()

spiders/sexy_spider.py

import scrapy

import os

# 导入item

from ..items import SexyItem

class SexySpider(scrapy.Spider):

# 如果有多个spider, name要唯一

name = 'sexy'

allowed_domains = ['uumdfdfnt.94demo.com']

allowed_urls = ['http://uumdfdfnt.94demo.com/']

# 需要爬取的网站url加到start_urls list里

start_urls = ['http://uumdfdfnt.94demo.com/tag/dingziku/index.html']

save_path = '/home/sexy/dingziku'

def parse(self, response):

# 解析网站,获取图片列表

img_list = response.xpath('//div[@class="taglist"]/ul//li//a//img/@data-original').getall()

time.sleep(1)

# 处理图片, 具体业务操作, 可交给yield items

for img_url in img_list:

items = SexyItem()

items['img_url'] = img_url

yield items

pipelines.py

import os

import requests

def download_from_url(url):

response = requests.get(url, stream=True)

if response.status_code == requests.codes.ok:

return response.content

else:

print('%s-%s' % (url, response.status_code))

return None

class SexyPipeline(object):

def __init__(self):

self.save_path = '/tmp'

def process_item(self, item, spider):

if spider.name == 'sexy':

# 取出item里内容

img_url = item['img_url']

# 业务处理

file_name = img_url.split('/')[-1]

content = download_from_url(img_url)

if content is not None:

with open(os.path.join(self.save_path, file_name), 'wb') as fw:

fw.write(content)

return item

重要的配置要开启在 settings.py中开启 piplines 类,数值表示优先级

ITEM_PIPELINES = {

'sexy.pipelines.SexyPipeline': 300,

}

5.3 自动下一页

start_urls 里。大家都是聪明人来试试这个。先在页面解析下下一页的url scrapy.Request(next_page, callback=self.parse) 发起一个请求,并调用 parse 来解析,当然你可以用其他的解析

5.1next_page = response.xpath('//div[@class="page both"]/ul/a[text()="下一页"]/@href').get()

if next_page is not None:

next_page = response.urljoin(next_page)

yield scrapy.Request(next_page, callback=self.parse)

5.4 中间件

下载中间件 中间件的作用是提供一些常用的钩子 Hook 来增加额外的操作。中间件的操作是在 middlewares.py。可以看到主要是处理请求process_request,响应process_response和异常process_exceptio n三个钩子函数。处理请求 process_request: 传给DOWNLOADER之前做的操作响应 process_response:DOWNLOADER给ENGIINE响应之前的操作

process_requestfrom scrapy.contrib.downloadermiddleware.useragent import UserAgentMiddleware

import random

agents = ['Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; Trident/5.0;',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10.6; rv,2.0.1) Gecko/20100101 Firefox/4.0.1',

'Opera/9.80 (Macintosh; Intel Mac OS X 10.6.8; U; en) Presto/2.8.131 Version/11.11',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_7_0) AppleWebKit/535.11 (KHTML, like Gecko) Chrome/17.0.963.56 Safari/535.11',

'Mozilla/4.0 (compatible; MSIE 7.0; Windows NT 5.1; 360SE)']

class RandomUserAgent(UserAgentMiddleware):

def process_request(self, request, spider):

ua = random.choice(agents)

request.headers.setdefault('User-agent',ua,)

settings.py 中开启下载中间件,数值表示优先级DOWNLOADER_MIDDLEWARES = {

'sexy.middlewares.customUserAgent.RandomUserAgent': 20,

}

5.5 可用配置 settings.py

爬虫机器人规则:ROBOTSTXT_OBEY = False, 如果要爬取的网站有设置 robots.txt,最好设置为 False CONCURRENT_REQUESTS:并发请求 DOWNLOAD_DELAY:下载延迟,可以适当配置,避免把网站也爬挂了。

https://doc.scrapy.org/en/latest/topics/settings.html

六、总结

scrapy 是基于事件驱动Twisted框架的爬虫框架。 ENGIINE是核心,负责串起其他组件开发只要编写 spider 和 item pipline 和中间件、download 和 schedule 交给框架 scrapy crawl 你的爬虫 name,name 要唯一 爬取的 url 放在 start_urls,spider 会自动 Request 的,parse 来解析 pipline 和中间件要记得在 settings 中开启 关注下 settings 的常用配置,需要时看下文档

👆「点击关注」更多惊喜等待你的发现👆

评论