微软旷视人脸识别100%失灵!北京十一学校校友新研究「隐身衣」,帮你保护照片隐私数据

共 3093字,需浏览 7分钟

·

2020-07-30 16:32

Python实战社群

Java实战社群

长按识别下方二维码,按需求添加

扫码关注添加客服

进Python社群▲

扫码关注添加客服

进Java社群▲

萧箫 鱼羊 发自 凹非寺

量子位 报道 | 公众号 QbitAI

“本文经AI新媒体量子位(公众号 ID: QbitAI)授权转载,转载请联系出处”

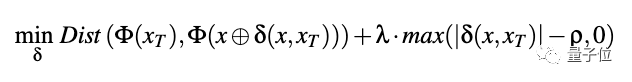

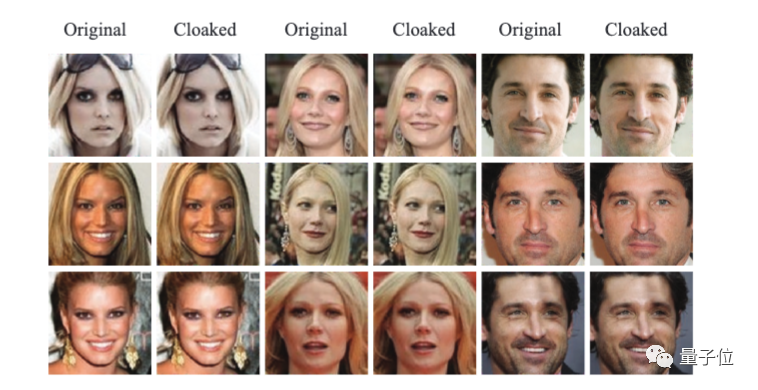

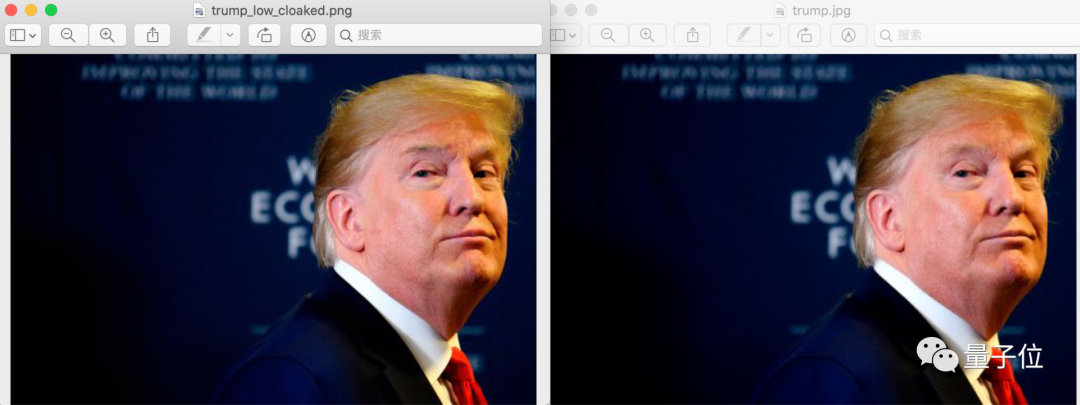

左图,右图,你能看出区别吗?

其实,算法已经悄悄给右边的照片加上了微小的修改。

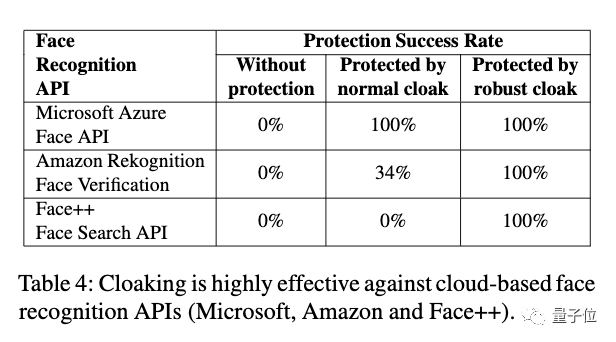

但就是这样肉眼根本看不出来的扰动,就能100%骗过来自微软、亚马逊、旷视——全球最先进的人脸识别模型!

所以意义何在?

这代表着你再也不用担心po在网上的照片被某些软件扒得干干净净,打包、分类,几毛钱一整份卖掉喂AI了。

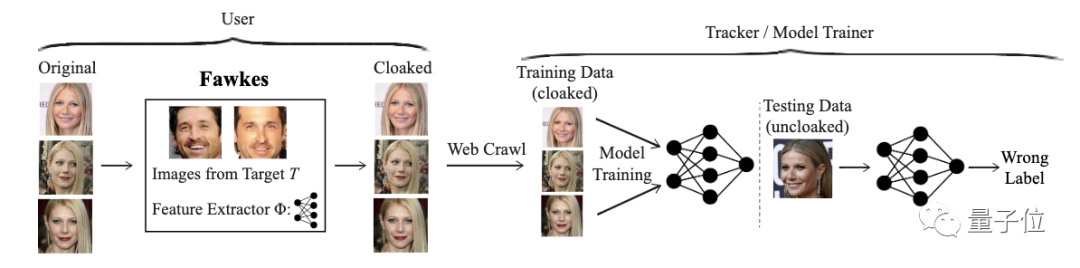

这就是来自芝加哥大学的最新研究:给照片加上一点肉眼看不出来的修改,就能让你的脸成功「隐形」。

如此一来,即使你在网络上的照片被非法抓取,用这些数据训练出来的人脸模型,也无法真正成功识别你的脸。

给照片穿上「隐身衣」

这项研究的目的,是帮助网友们在分享自己的照片的同时,还能有效保护自己的隐私。

因此,「隐身衣」本身也得「隐形」,避免对照片的视觉效果产生影响。

也就是说,这件「隐身衣」,其实是对照片进行像素级别的微小修改,以蒙蔽AI的审视。

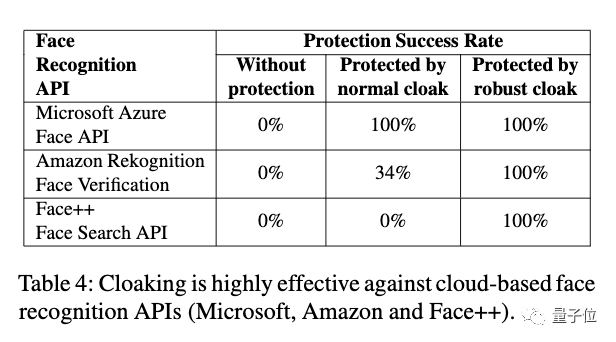

其实,对于深度神经网络而言,一些带有特定标签的微小扰动,就能够改变模型的「认知」。

比如,在图像里加上一点噪声,熊猫就变成了长臂猿:

Fawkes就是利用了这样的特性。

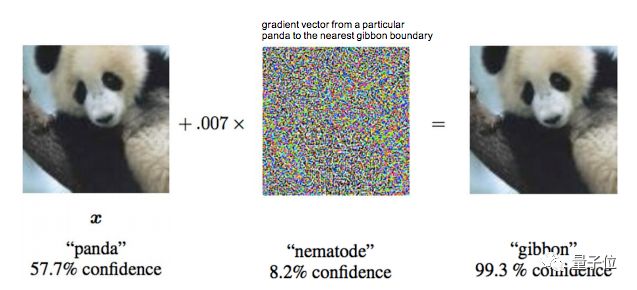

用 x 指代原始图片,xT为另一种类型/其他人脸照片,φ 则为人脸识别模型的特征提取器。

具体而言,Fawkes是这样设计的:

第一步:选择目标类型 T

指定用户 U,Fawkes的输入为用户 U 的照片集合,记为 XU。

从一个包含有许多特定分类标签的公开人脸数据集中,随机选取 K 个候选目标类型机器图像。

使用特征提取器 φ 计算每个类 k=1…K 的特征空间的中心点,记为 Ck。

而后,Fawkes会在 K 个候选集合中,选取特征表示中心点与 XU 中所有图像的特征表示差异最大的类,作为目标类型 T。

第二步:计算每张图像的「隐身衣」

随机选取一幅 T 中的图像,为 x 计算出「隐身衣」δ(x, xT) ,并按照公式进行优化。

其中 |δ(x, xT)| < ρ。

研究人员采用DDSIM(Structural Dis-Similarity Index)方法。在此基础上进行隐身衣的生成,能保证隐身后的图像与原图在视觉效果上高度一致。

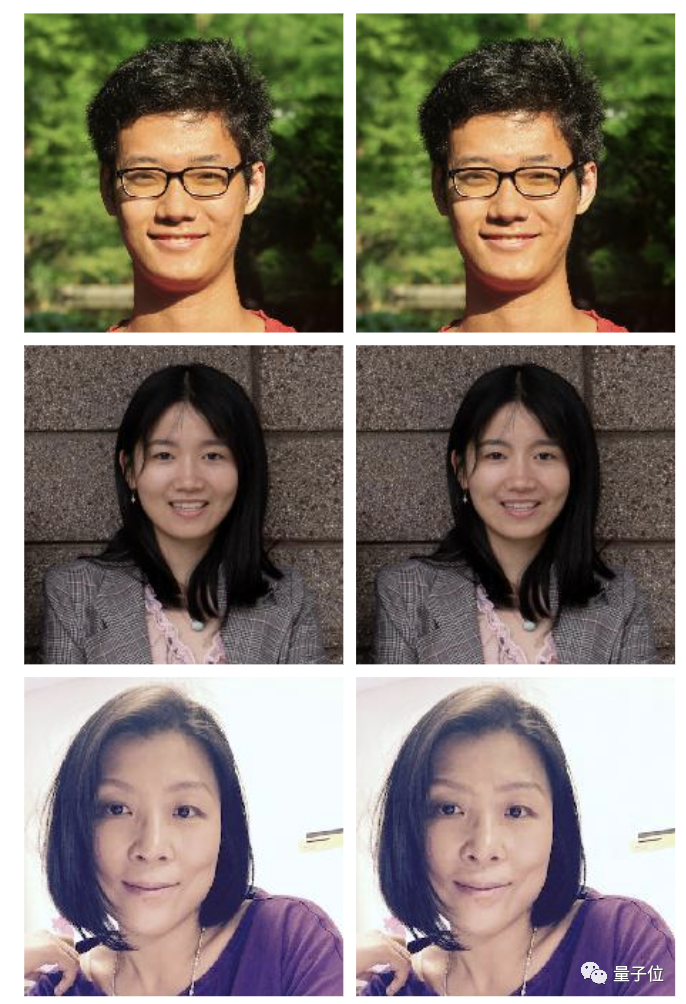

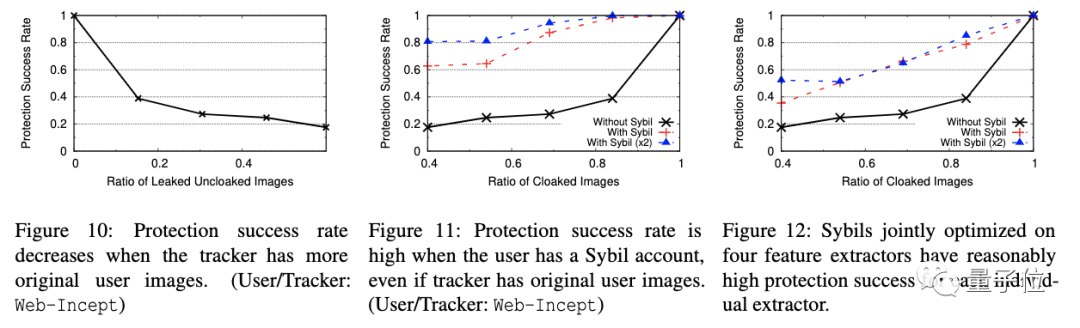

实验结果表明,无论人脸识别模型被训练得多么刁钻,Fawkes都能提供95%以上有效防护率,保证用户的脸不被识别。

即使有一些不小心泄露的未遮挡照片被加入人脸识别模型的训练集,通过进一步的扩展设计,Fawkes也可以提供80%以上的防识别成功率。

在Microsoft Azure Face API、Amazon Rekognition和旷视Face Search API这几个最先进的人脸识别服务面前,Fawkes的「隐身」效果则达到了100%。

目前,Fawkes已开源,Mac、Windows和Linux都可以使用。

安装简易方便

这里以Mac系统为例,简单介绍一下软件的使用方法。使用的笔记本是MacBook Air,1.1GHz双核Intel Core i3的处理器。

首先,我们从GitHub上下载压缩安装包,并进行解压。

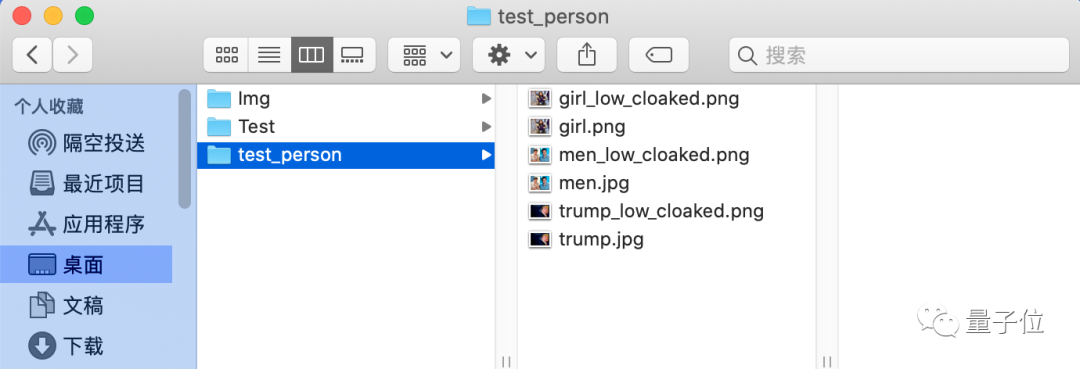

接下来,把想要修改的所有照片放入一个文件夹里,并记住路径。

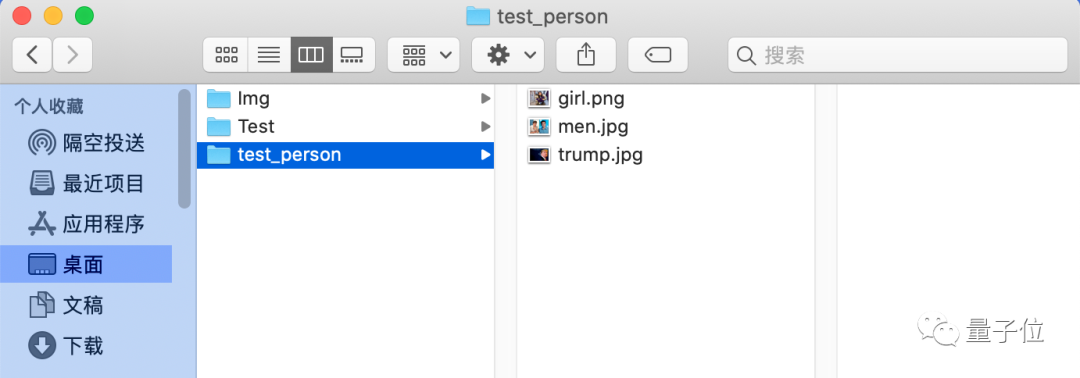

以桌面上的一个名为test_person的图片文件夹为例,里面我们放了三张照片,其中一张图片包含两个人。

这里的图片路径是~/Desktop/test_person,根据你的图片保存位置来确定。

接下来,打开启动台中的终端,进入压缩包所在的文件夹。

注意,如果MacOS是Catalina的话,需要先修改一下权限,以管理员身份运行,sudo spctl —master-disable就可以了。

这里我们的压缩包直接放在下载的文件夹里,直接cd downloads就行。

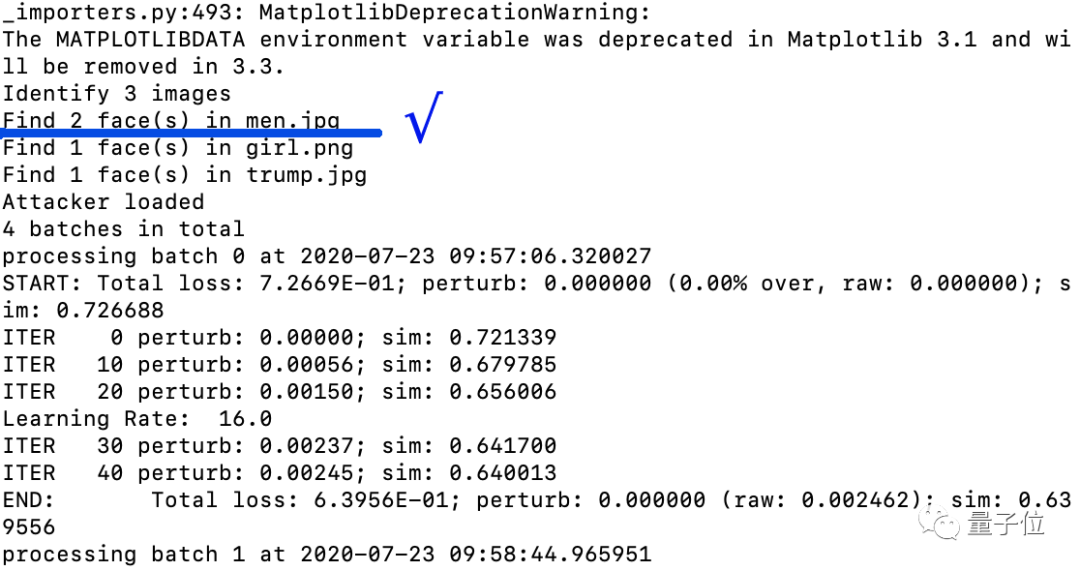

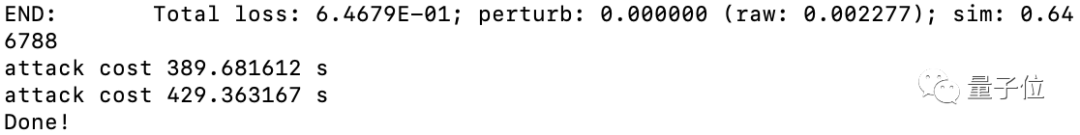

进入下载文件夹后,输入./protection -d 文件路径(文件路径是图片文件夹所在的位置,这里输入~/Desktop/test_person),运行生成图片的「隐身衣」。

嗯?不错,看起来竟然能识别一张图中的2个人脸。

缓慢地运行……

据作者介绍说,生成一张「隐身衣」的速度平均在40秒左右,速度还是比较快的。

如果电脑配置够好,应该还能再快点。

不过,双核的就不奢求了…我们耐心地等一下。

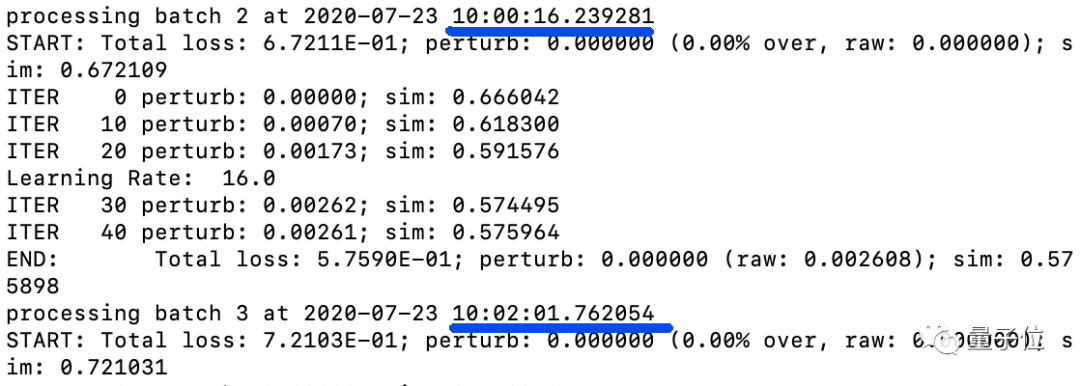

从时间看来,处理速度还算可以接受。

Done!

图中来看,生成3张图片的「隐身衣」,电脑用了大约7分钟(一定是我的电脑太慢了)。

来看看生成的结果。

可以看见,文件夹中的3张图片,都生成了带有_low_cloaked的后缀名的图片。

虽然介绍里说,生成的后缀是_mid_cloaked的图片,不过软件提供的模式有「low」、「mid」、「high」、「ultra」、「custom」几种,所以不同的模式会有不同的后缀名。

以川普为例,来看看实际效果。

两张图片几乎没有差别,并没有变丑,川普脸上的皱褶看起来还光滑了一点。

这样,我们就能放心地将经过处理后的人脸照片放到网上了。

即使被某些不怀好意的有心之人拿去使用,被盗用的数据也并不是我们的人脸数据,不用再担心隐私被泄露的问题。

不仅如此,这个软件还能「补救」一下你在社交网站上晒出的各种人脸数据。

例如,你曾经是一名冲浪达人,之前会将大量的生活照po到社交网站上——

照片可能已经被软件扒得干干净净了……

不用担心。

如果放上这些经过处理后的图片,这些自动扒图的人脸识别模型会想要添加更多的训练数据,以提高准确性。

这时候,穿上「隐身衣」图片在AI看来甚至「效果更好」,就会将原始图像作为异常值放弃。

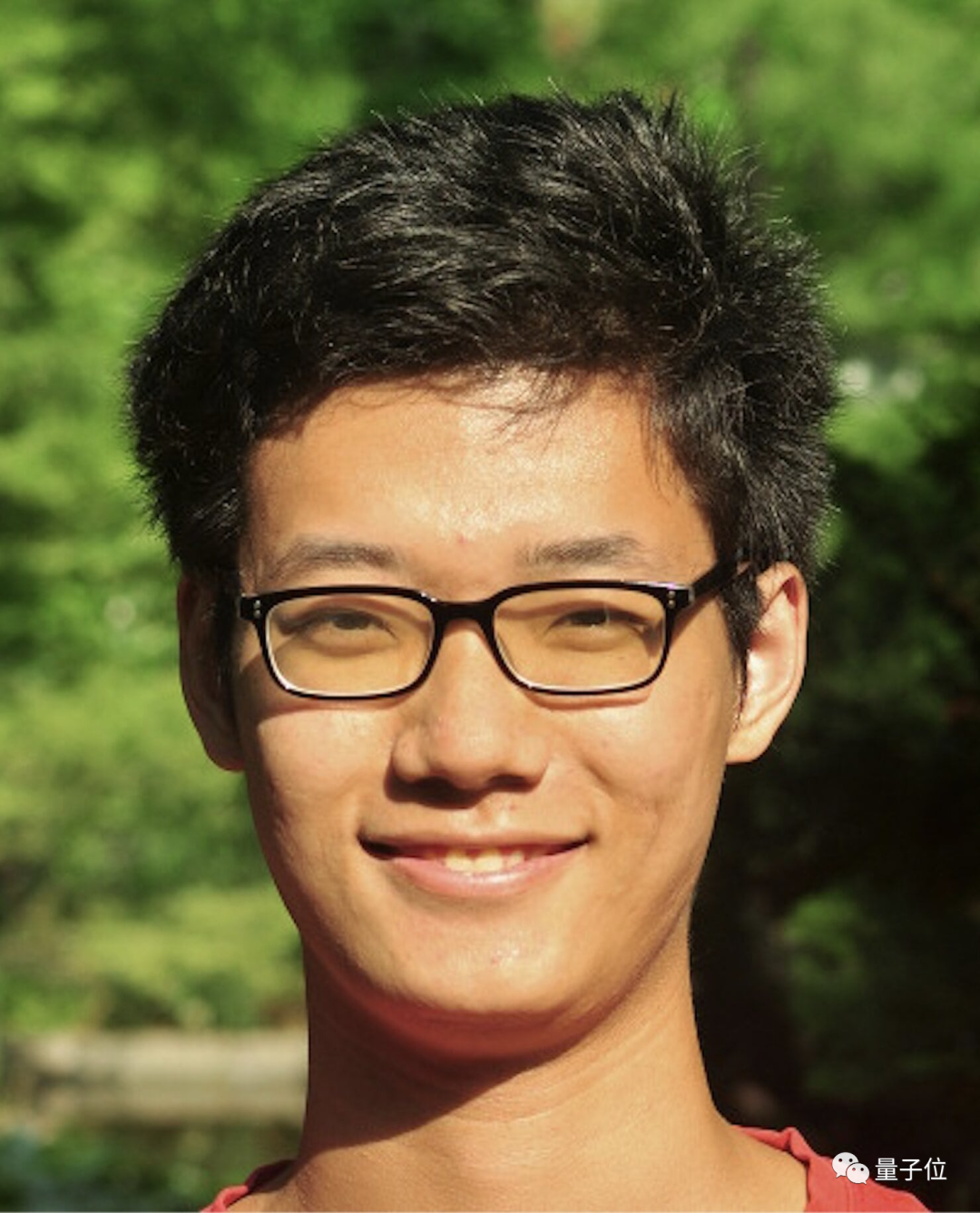

华人一作

论文的一作是华人学生单思雄,高中毕业于北京十一学校,目前刚拿到了芝加哥大学的学士学位,将于9月份入学攻读博士学位,师从赵燕斌教授和Heather Zheng教授。

作为芝加哥大学SAND Lab实验室的一员,他的研究主要侧重于机器学习和安全的交互,像如何利用不被察觉的轻微数据扰动,去保护用户的隐私。

从单同学的推特来看,他一直致力于在这个「透明」的世界中,为我们争取一点仅存的隐私。

论文的共同一作Emily Wenger同样来自芝加哥大学SAND Lab实验室,正在攻读CS博士,研究方向是机器学习与隐私的交互,目前正在研究神经网络的弱点、局限性和可能对隐私造成的影响。

项目链接:

https://github.com/Shawn-Shan/fawkes/tree/master/fawkes

论文链接:

http://people.cs.uchicago.edu/~ravenben/publications/pdf/fawkes-usenix20.pdf

参考链接:

https://www.theregister.com/2020/07/22/defeat_facial_recognition/

— 完 —

近期精彩内容推荐: