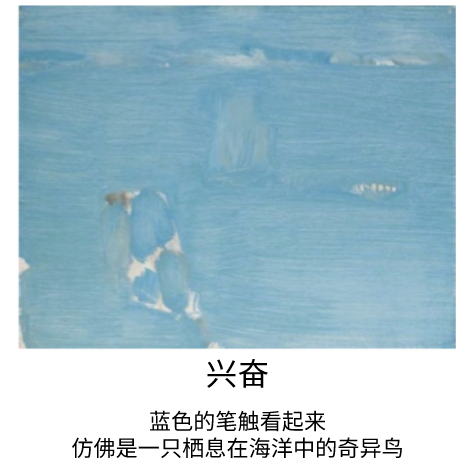

经过 8 万画作+人工注释训练,算法学会了赏析名画

来源:HyperAI超神经 本文约2100字,建议阅读7分钟

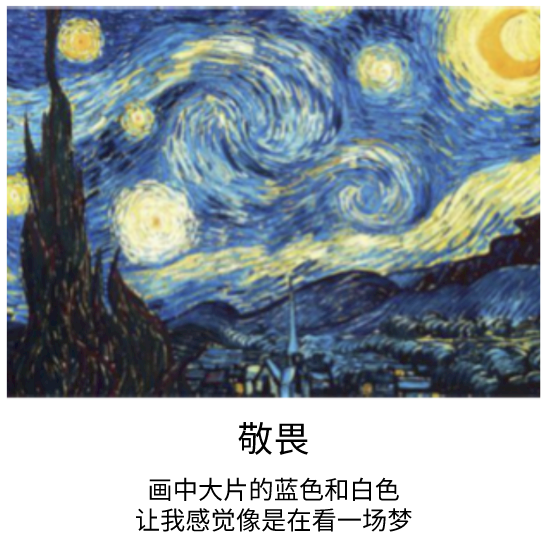

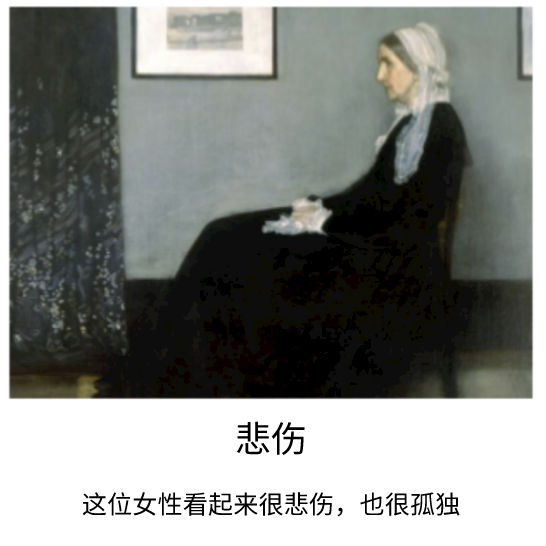

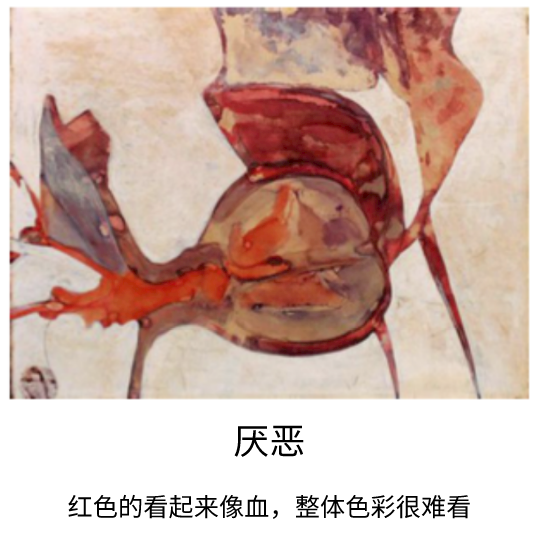

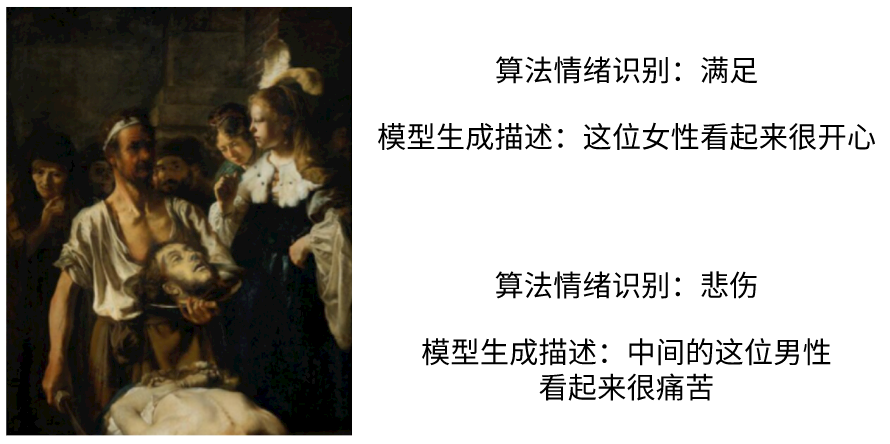

AI艺术评论家的诞生。

WikiArt:线上名画博物馆

ArtEmis:诞生于 WikiArt 的新数据集

ArtEmis 数据集 视觉艺术的情感标记数据集 发布机构:斯坦福大学,巴黎综合理工学院以及阿卜杜拉国王科技大学 包含数量:共 439121 条画作标注 数据格式:csv 数据大小:21.8 MB 地址:https://hyper.ai/datasets/14861

一个可感知情感的算法,是怎样炼成的

新闻来源:

https://techxplore.com/news/2021-03-artist-intent-ai-emotions-visual.html

数据集论文:

https://arxiv.org/pdf/2101.07396.pdf

项目主页:

https://www.artemisdataset.org/#videos

评论