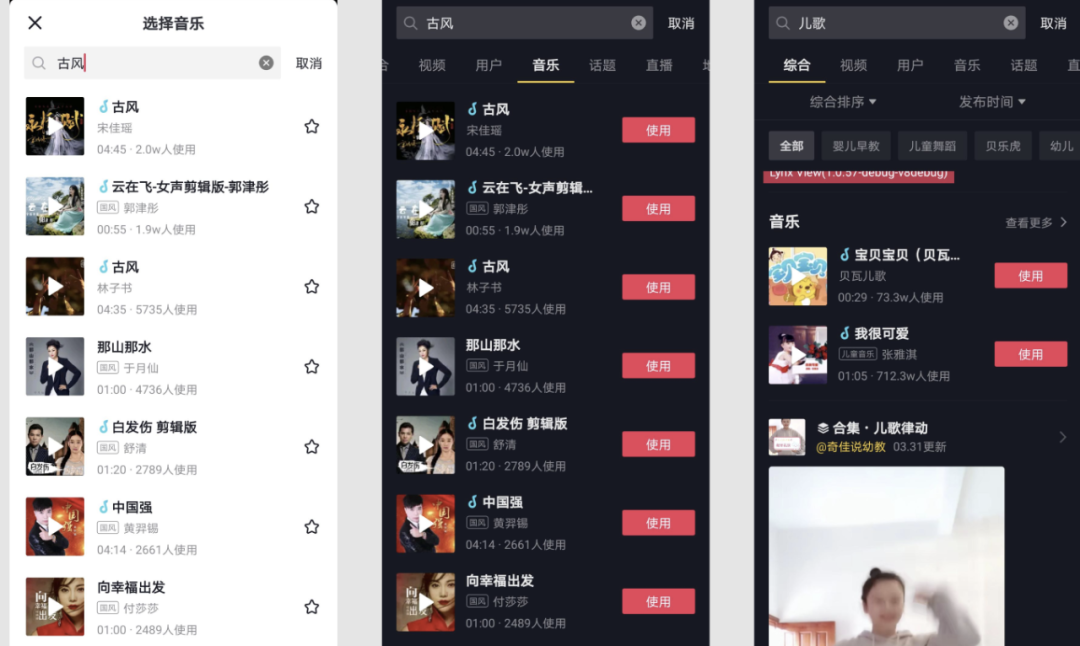

抖音「神曲」那么多,字节跳动是如何玩转亿级曲库的?

视学算法发布

在今年的音乐科技顶会 ISMIR 2021(International Society for Music Information Retrieval)上,字节跳动海外技术团队有 7 篇论文入选,涵盖了音乐分类、音乐标签、音源分离、音乐结构分析等多个技术方向。

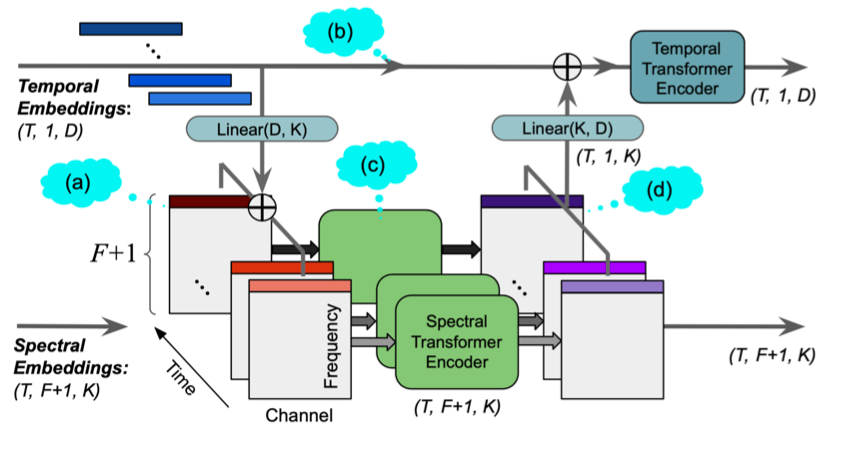

ISMIR 2021 论文:SpecTNT: a Time-Frequency Transformer for Music Audio SpectTNT 模型的原理是将音频信号经过短时傅立叶变换,得到频谱图。然后,频谱图经过时间和频域的转换模型提取高层次特征。模型本身包含残差结构,使得底层信息能够充分流入到高层中。

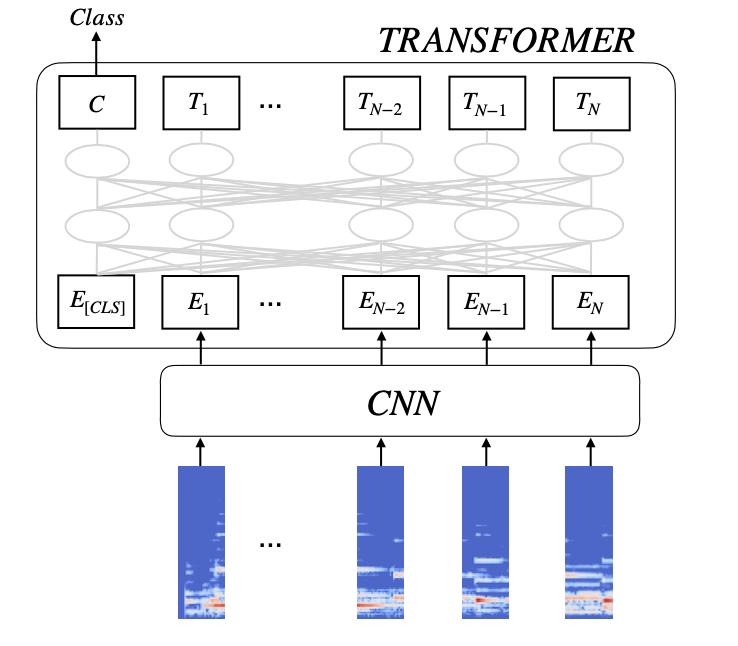

ISMIR 2021 论文:< Semi-supervised Music Tagging Transformer > 论文提出的半监督式 Transformer 音乐模型,能够突破传统卷积神经网络的一些表现,进一步提出了基于噪声学习和半监督学习的方法,充分利用有标记数据和无标注数据,大幅减少人工数据标注的工作量。该模型已经超越了现在大规模使用的深度残差网络表现。

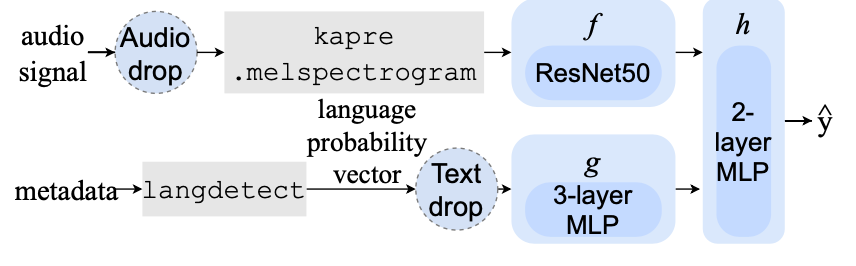

ISMIR 2021 论文:<Listen, Read, and Identify: Multimodal Singing Language Identification of Music> 字节提出的音乐语种识别,支持多模态作为系统的输入。基于音频的对数梅尔谱图,经过 50 层的深度残差网络提取嵌入特征,并且支持使用音乐的一些结构化文本数据,例如专辑名等作为输入。经过一个语言识别模型输出嵌入特征。最后通过结合音频和元数据的多模态特征,经过全连接层输出预测的语言结果。

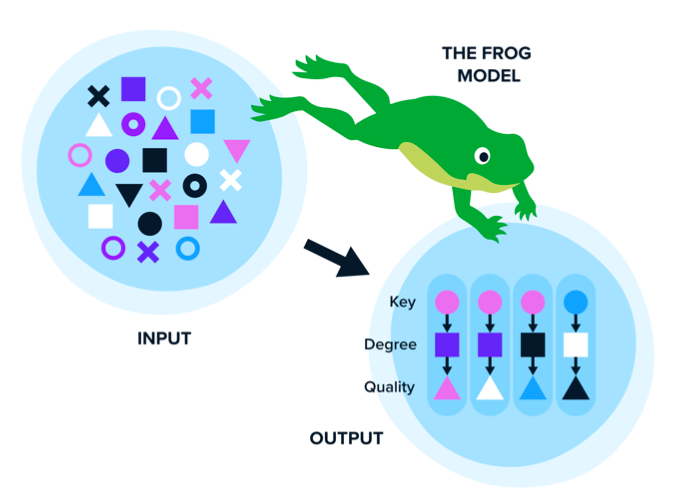

ISMIR 2021 论文:< A deep learning method for enforcing coherence in Automatic Chord Recognition> 该技术提出了一种能够识别音乐和弦的方法,可识别非常丰富的和弦种类,是一种基于神经网络的自回归蒸馏估计方法 NADE。经过详实的数据实测,该方案在一些经典的数据集上的和弦识别效果优于很多同类研究。

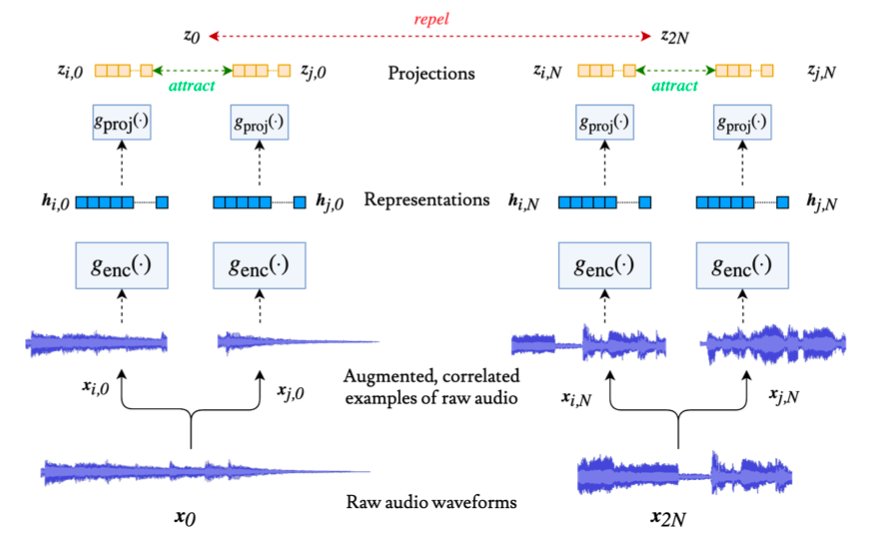

ISMIR 2021 论文:< Contrastive Learning of Musical Representations > CLMR 只需极少的数据标注,避免了监督学习中需要大量标签的情况,大幅降低了数据成本。通过对音频数据做出多种增强处理,并使用对比学习的方法,训练出音乐的通用表征。在多个音频分类的迁移学习任务上,CLMR 表征均取得了非常好的效果。

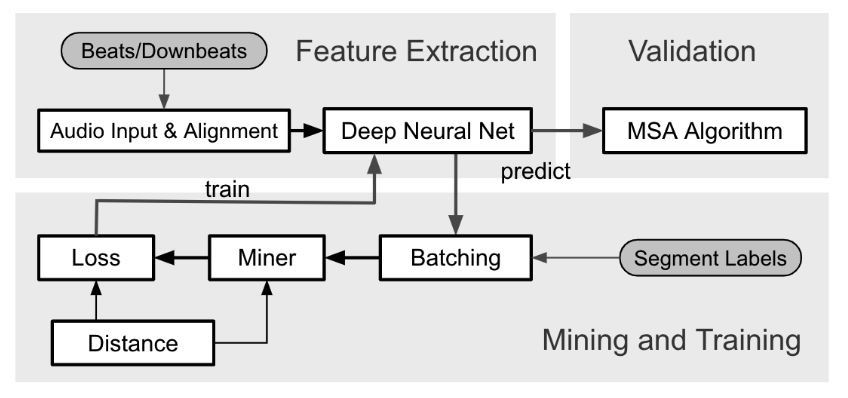

ISMIR 2021 论文:<Supervised Metric Learning for Music Structure Features> 字节的音乐高光检测等技术利用一种较为前沿的音乐结构分析方法,音频经过深度神经网络提出特征,提取的特征会送到一个数据挖掘模块中继续分析。本文提出的方法已用在 HarmonixSet, SALAMI, RWC 等多个数据集上。

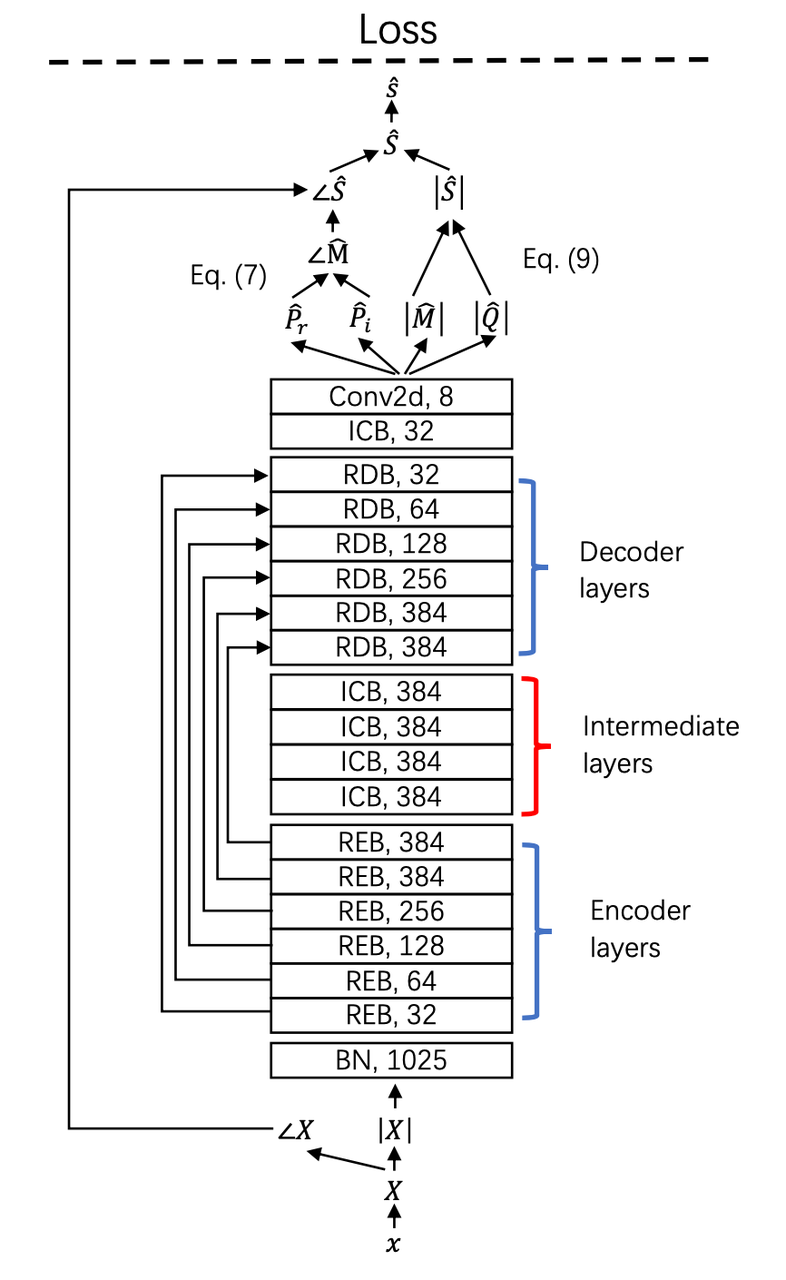

ISMIR 2021 论文:< Decoupling Magnitude and Phase Estimation with Deep ResUNet for Music Source Separation> 这项技术的创新之处在于,作者们提出了一种同时估计幅度谱和相位谱的方法,提升了理想掩模方法的上限,进一步提出了一个 143 层的深度残差网络。实验表明,该系统在人声分离中取得了 8.98 dB 的值。

© THE END

转载请联系原公众号获得授权

投稿或寻求报道:content@jiqizhixin.com

点个在看 paper不断!

评论