系统掌握BERT原理、代码、相关模型、精调技巧,方法就在这里

扫描上方二维码,尽享超值优惠

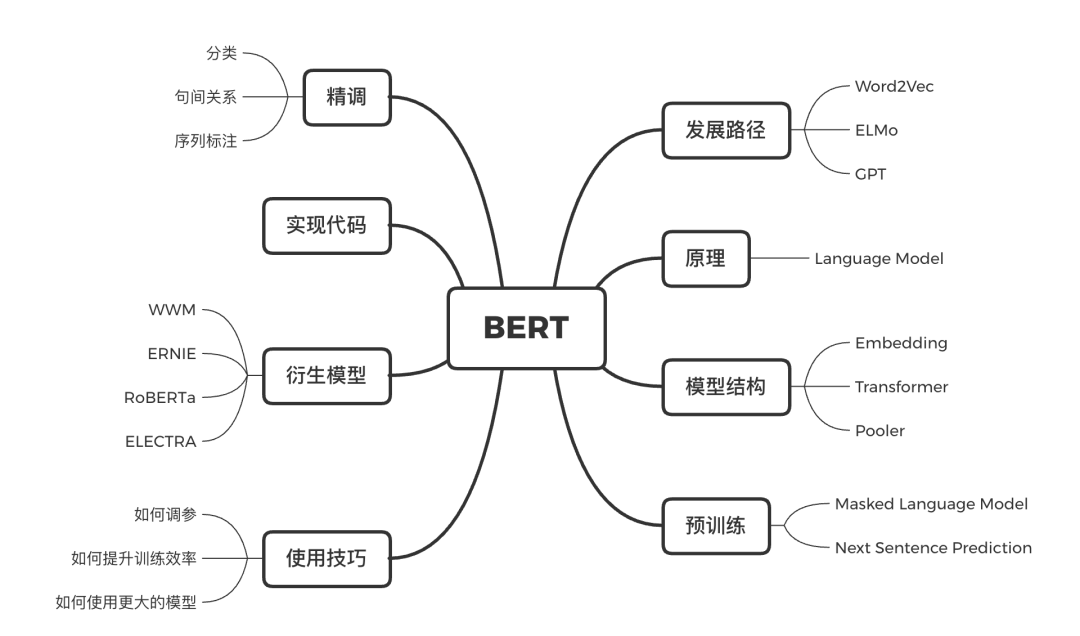

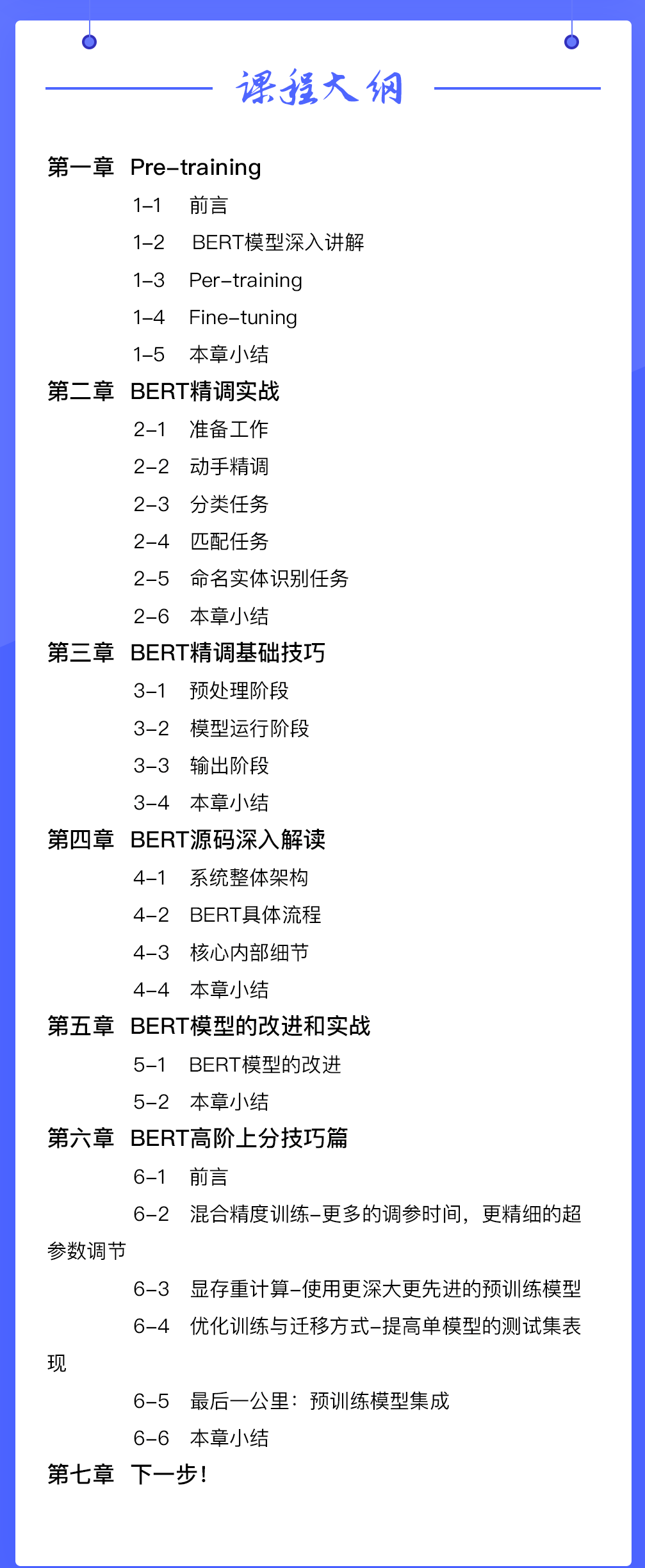

从产生背景到推导,彻底搞懂BERT模型原理 熟练掌握3种NLP经典任务的解决方法 深入解读BERT源码,不做调参侠 后BERT时代模型的发展脉络与核心思想 BERT在实战中的高级上分技巧

早鸟优惠¥79,原价¥99。

订阅后生成海报分享给朋友,每成功邀请一位好友购买,可得¥15.8佣金,多邀多得,上不封顶。

实习/全职编辑记者招聘ing

加入我们,亲身体验一家专业科技媒体采写的每个细节,在最有前景的行业,和一群遍布全球最优秀的人一起成长。坐标北京·清华东门,在大数据文摘主页对话页回复“招聘”了解详情。简历请直接发送至zz@bigdatadigest.cn

评论