半监督学习(SSL)已成为深度学习领域热门的新方向,该方法只需要少量有带标签的样本和大量无标签的样本。在这种情况下,半监督学习方法更适用于现实世界中的应用,因为,无标签的数据易于获取,而有标签的数据收集起来通常很困难,标注也耗时和耗力。先前的半监督学习方法主要适用于分类任务,而在目标检测任务今天我们介绍适用于双阶段目标检测网络的通用半监督学习框架 Semi-Supervised Object Detection。

论文:Proposal Learning for Semi-Supervised Object Detection论文:https://arxiv.org/pdf/2001.05086.pdf

01

目标检测的半监督学习方法

方法简介:

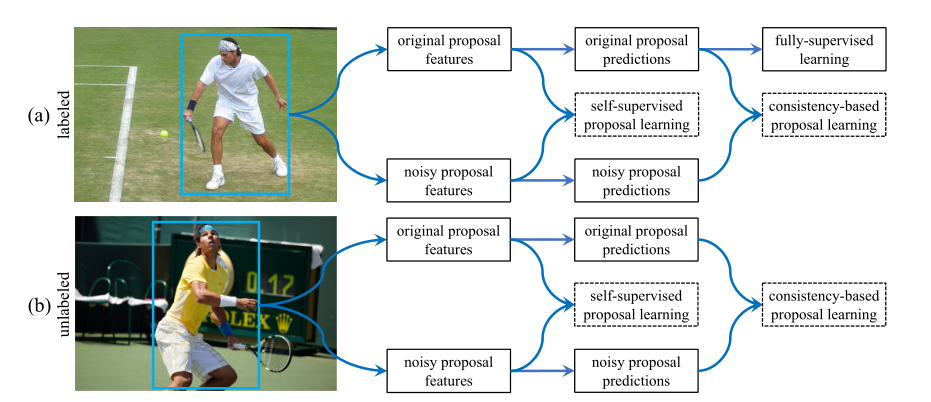

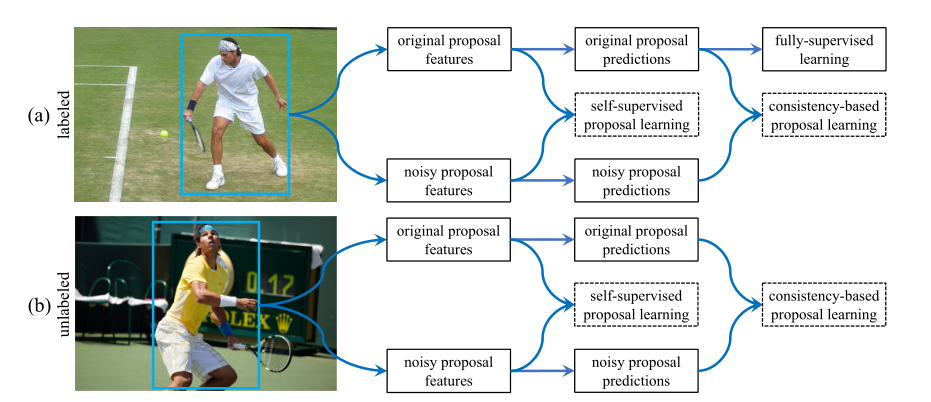

作者提出一种 proposal 学习方法(方法框架如下图所示),从标记和未标记的数据中学习proposal 特征和预测。该方法包括 :

作者建立一个通用且高性能的半监督目标检测框架,该框架可轻松适应具有不同主干架构的基于提议的目标检测器。在COCO数据集上,所提出方法比各种基于 Faster R-CNN 的完全监督基线和数据蒸馏分别高出约 2.0% 和 0.9%。

提出的模块以虚线框突出显示, 给定图像,将生成原始/嘈杂的投标特 征和 预测。(a)为标签数据选择标准的完全监督学习。(a)和(b)提出的 proposal学习方法从标记和未标记的数据中学习proposal特征和预测。

背景介绍

为了让大家能够更好的理解这篇文章,我们简要介绍一下半监督学习和自监督学习半监督学习:半监督学习简单来说就是利用带标签数据和未带标签的数据训练模型,主要有多种策略如:自训练、一致性正则化、协同训练。本文采用一致性正则化方法,主要的思想是如果两个样本x1,x2相似,则是它们的相应输出y1,y2也应相似,因此在输入x1加入噪声扰动后的输入x2的预测结果y2应该与y1相同。更多关于半监督学习的介绍可以看我们之前的文章【Review】一文梳理混合的半监督学习方法自监督学习:回想一下在监督学习中,系统被赋予输入(x)和标签(y),而在自监督学习中,仅给定系统(x),而系统学习的不是(y),而是“学会根据输入的其他部分来预测其输入的一部分”。这种表达方式是多样化的,可以创造性地“分解”输入内容, 这些策略称为 pretext tasks。研究人员尝试了各种方法,这里举三个示例:(1)预测两个斑块的相对位置,(2)解决拼图游戏,(3)给图像着色。更多关于半监督学习的介绍可以看我们之前的文章对比自监督学习范式了解完半监督学习和自监督学习我们就可以开始了解论文的主要方法。

02

方法

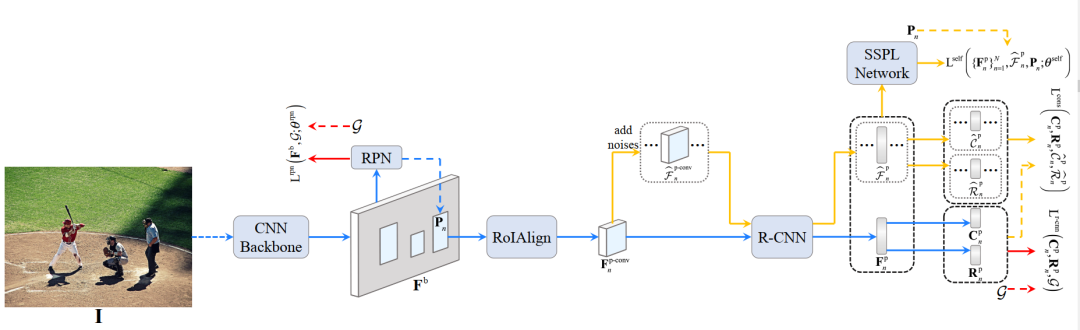

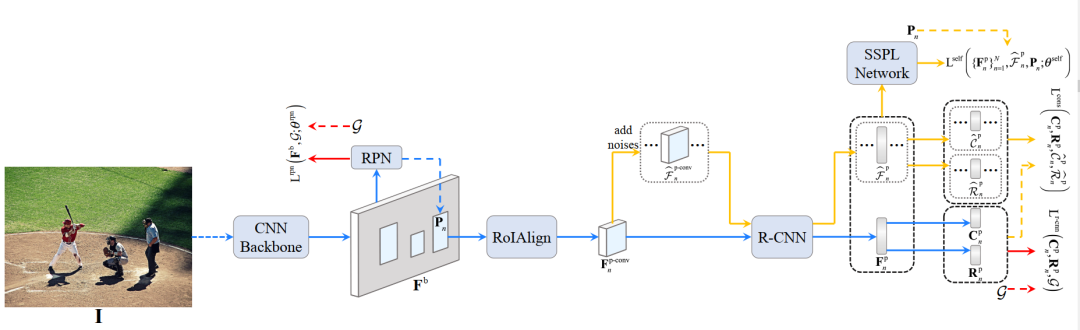

文章的框架如上图所示,这是一个通用两阶段的半监督目标检测框架,图中蓝色线代表完全监督的Faster RCNN框架,黄色线代表文章提出的 proposal 学习方法。主要有两个部分:自监督的 proposal 学习模块,基于一致性的 proposal 学习模块。

2.1 自监督的 proposal 学习模块

自监督的 proposal 学习模块在上图为SSPL Network部分,这部分的动机:一个具有上下文信息的特征可以提升目标检测能力,一个好的特征应该希望是对噪声具有鲁棒性。自监督的一个主要任务就是去学的一个“好”的特征,所以作者这里通过定义不同的pretext tasks来让模型学会生成一个具有上下文信息,对噪声鲁棒的特征。 上式的pretext tasks 是希望SSPL Network去预测出proposal的原图的位置。实际上就是预测RPN网络的输出。通过这种方式迫使网络去感知全局信息,达到具有上下文信息的目的。 总共K+1个特征图,会把每一个特征图作为输入去预测proposal的位置。

上式的pretext tasks是instance discrimination,这也是在自监督领域使用较广泛的一种。首先会将每个特征图嵌入为向量,然后计算当前新生成的特征图对应的向量与所有的proposal对应的向量之间的点积,归一化,求和。直觉上就是表示特征图之间的关系,希望来自同一个proposal的值大,来自不同proposal的值小,来达到对噪声不敏感的目的。

将这两部分合起来就是SSPL Network的损失函数,对应整体框架中的 如下所示:

基于一致性的半监督学习的思路是对于无标签图像,在添加了噪声之后模型预测也应该保持不变。与分类任务类似的是,目标检测也需要分类,这部分与半监督的分类任务是类似的,如下式所示: 与分类任务不同的是目标检测还需要对边框预测。与分类任务类似,希望有噪声的特征图预测出的边框与原特征图预测的边框保持一致,使用smooth l1 loss来回归。如下式所示。将这两部分合起来对应整体框架的Loss:

03

实验结果

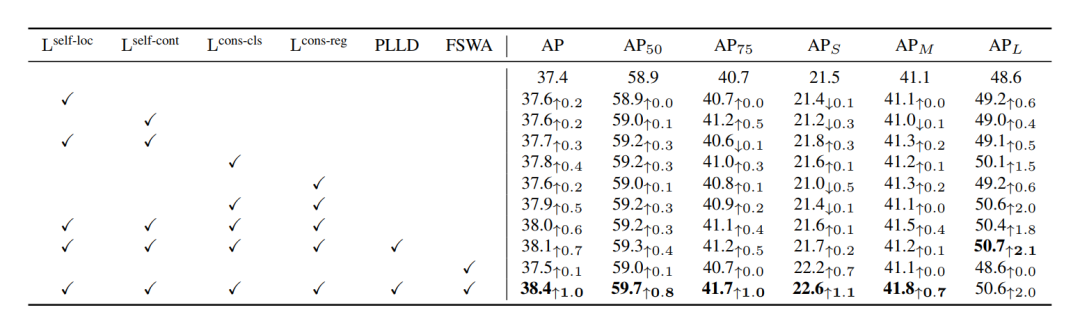

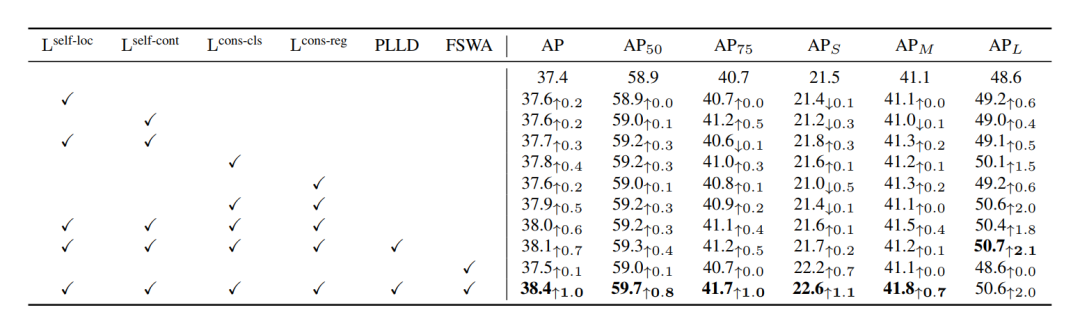

作者做了充足的实验验证了这种半监督学习目标检测方法对目标检测性能的提升。在COCO数据集上,所提出方法比各种基于 Faster R-CNN 的完全监督基线和数据蒸馏分别高出约 2.0% 和 0.9%。

04

总结

这篇文章提出了适用于通用两阶段目标检测网络的半监督学习框架,利用两阶段网络中的proposal阶段进行自监督和一致性学习,在实验结果表明该方法比完全监督的效果更好,但是该方法的局限之处在于只适合于具有proposal阶段的目标网络,因此对一般的单阶段网络就不能使用该方法。

✄------------------------------------------------

双一流高校研究生团队创建,专注于目标检测相关知识分享

整理不易,点赞三连!