Ollama - 本地运行、创建和共享大型语言模型

大家好,又见面了,我是 GitHub 精选君!

背景介绍

在当前的人工智能领域,大型语言模型(LLMs)的应用越来越广泛,但是对于许多开发者来说,如何在本地快速运行和创建大型语言模型仍然是一个挑战。这主要是因为大型语言模型通常需要大量的计算资源和专业的技术知识。此外,如何共享和管理这些模型也是一个问题。因此,我们需要一个工具来帮助我们解决这些问题。

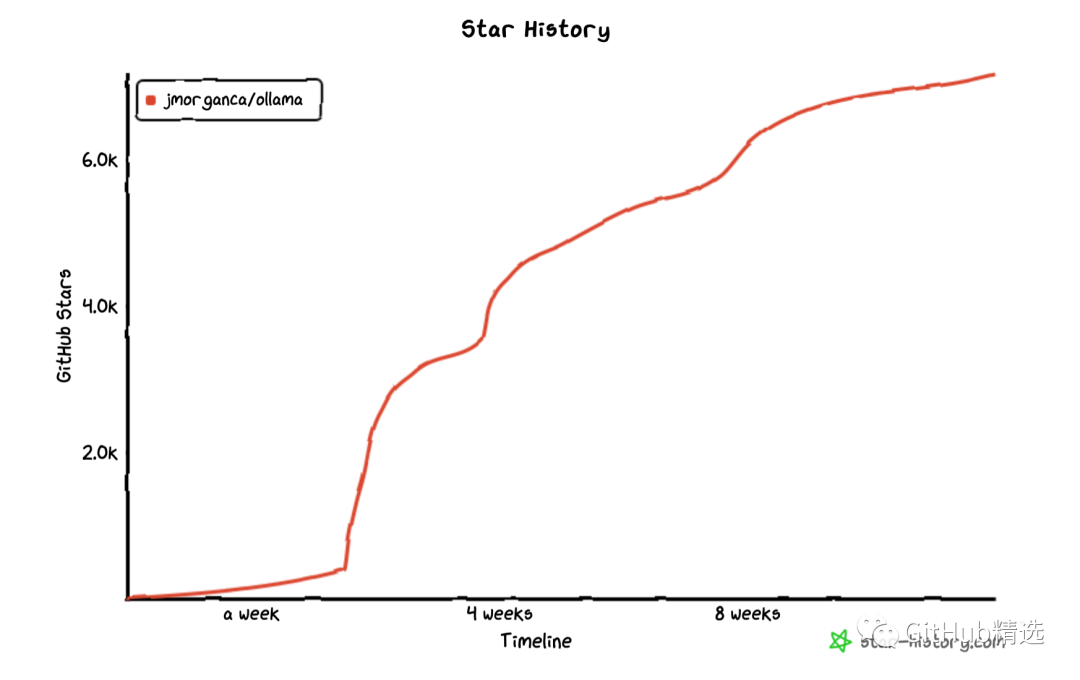

今天要给大家推荐一个 GitHub 开源项目 jmorganca/ollama,该项目在 GitHub 有超过 6.6k Star,用一句话介绍该项目就是:“Get up and running with Llama 2 and other large language models locally”。

项目介绍

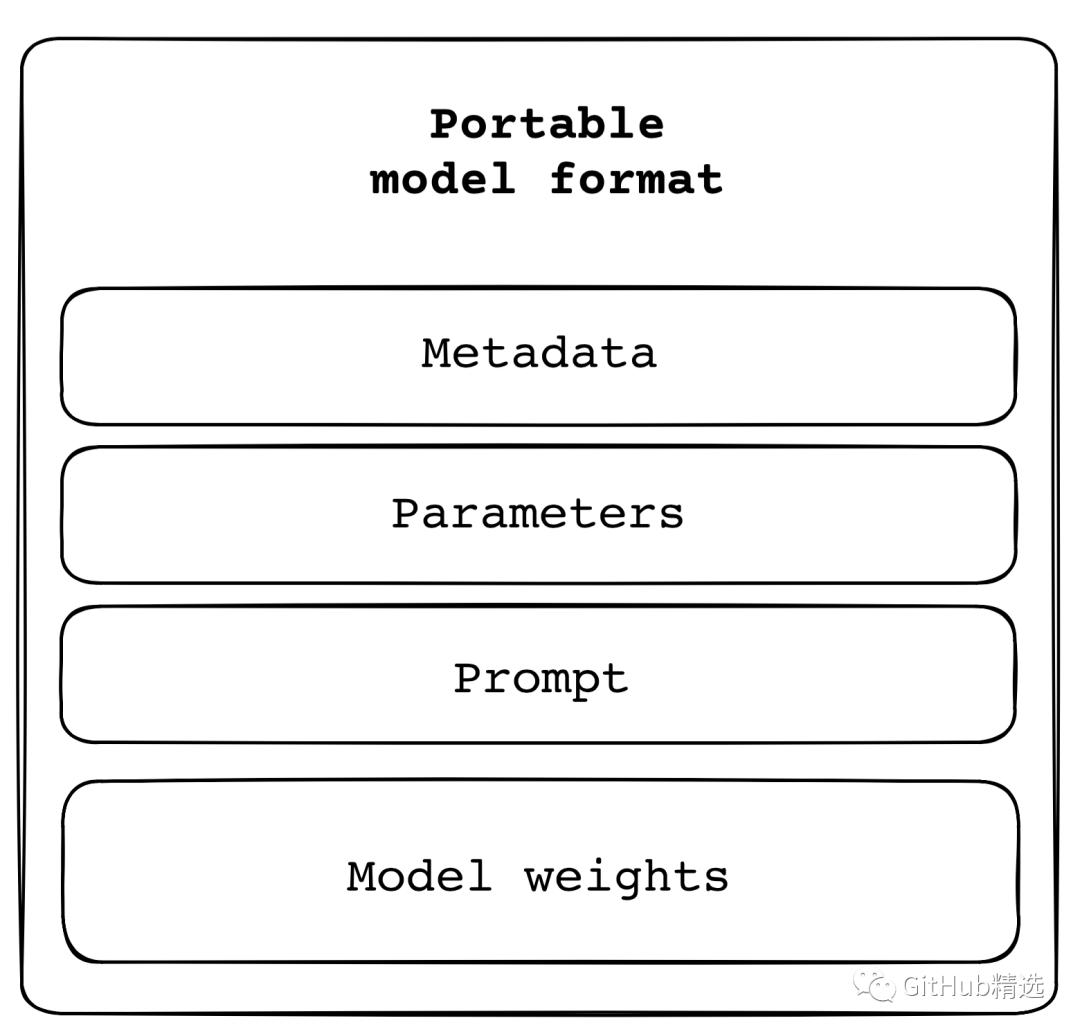

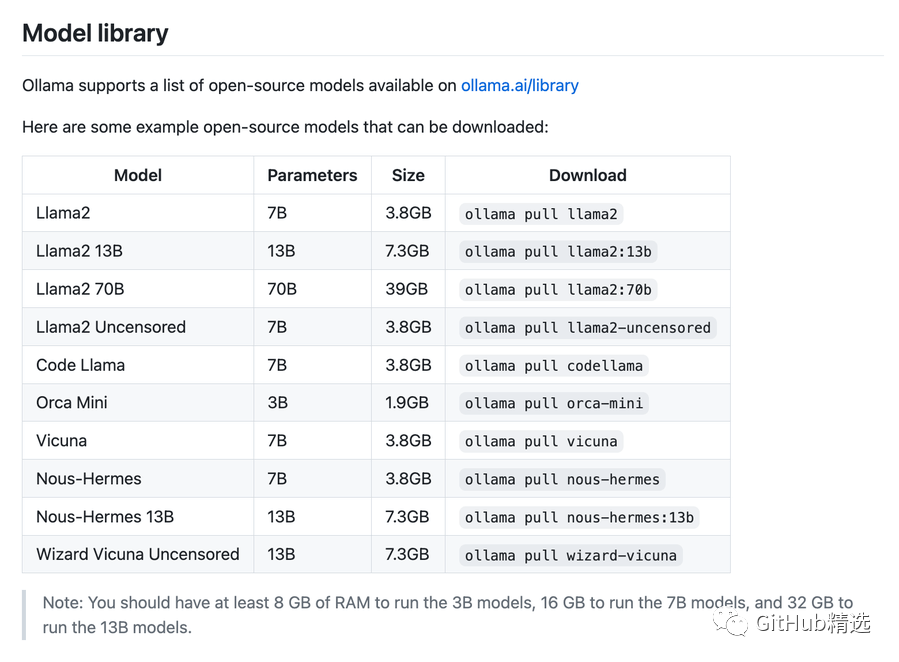

Ollama 的目标是帮助开发者在本地运行、创建和共享大型语言模型。Ollama 目前处于早期预览阶段,但已经提供了一些核心功能。例如,它支持运行和对话 Llama 2,这是 Meta 新推出的模型。此外,Ollama 还提供了一个模型库,开发者可以在这里下载和使用各种开源模型。Ollama 还提供了一种名为 Modelfile 的文件格式,开发者可以使用它来定义和创建自定义模型。

如何使用

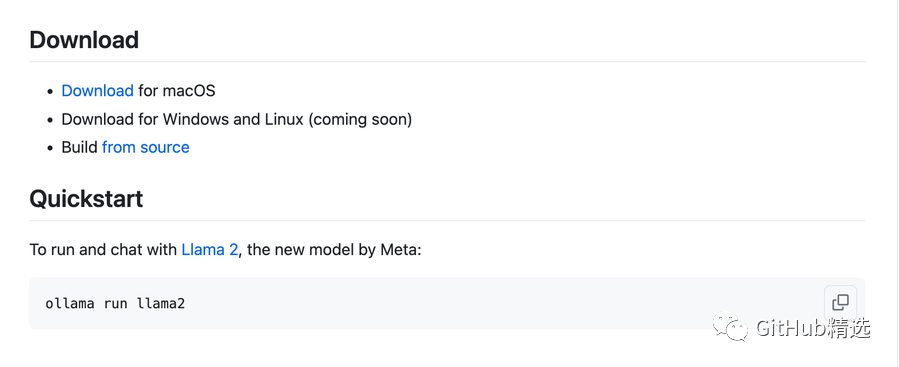

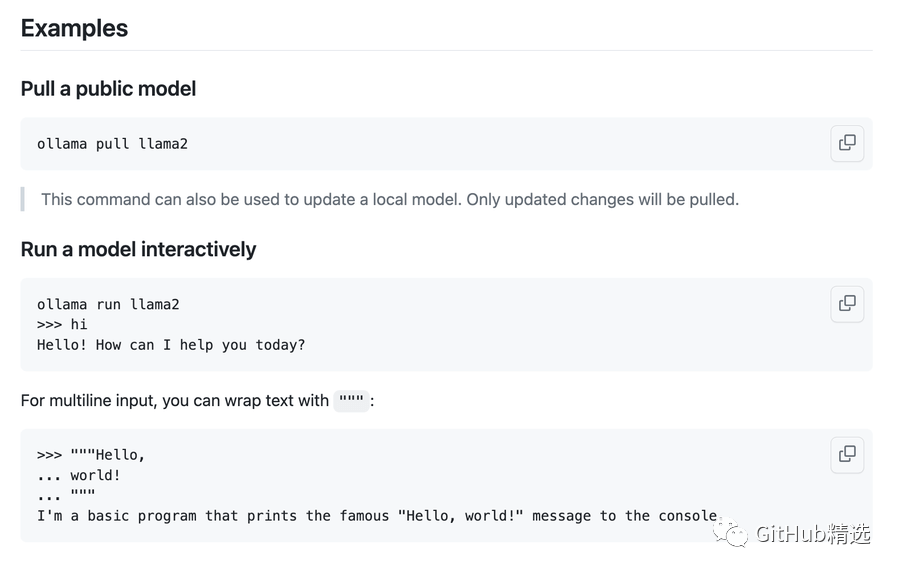

首先,你需要下载 Ollama。目前,它支持 macOS,Windows,其中 Linux 的版本正在开发中。你也可以从源代码构建 Ollama。

然后,你可以使用命令 ollama run llama2 来运行和对话 Llama 2。如果你想下载和使用其他模型,你可以访问 ollama.ai/library,这里列出了所有可用的开源模型。你可以使用命令 ollama pull <模型名> 来下载模型。如果你想创建自定义模型,你可以创建一个 Modelfile,然后使用命令 ollama create <模型名> -f ./Modelfile 来创建模型。最后,你可以使用命令 ollama run <模型名> 来运行你的模型。

项目推介

尽管 Ollama 还处于早期阶段,但它已经展示了巨大的潜力。它的设计理念和功能都非常符合当前大型语言模型的发展趋势。因此,无论你是大型语言模型的研究者,还是希望在自己的项目中使用大型语言模型的开发者,我都强烈推荐你尝试使用 Ollama。

以下是该项目 Star 趋势图(代表项目的活跃程度):

更多项目详情请查看如下链接。

开源项目地址:https://github.com/jmorganca/ollama

开源项目作者:jmorganca

以下是参与项目建设的所有成员:

关注我们,一起探索有意思的开源项目。

点击如下卡片后台回复:加群,与技术极客们一起交流人工智能、开源项目,一起成长。