引用次数在15000次以上的都是什么神仙论文?

链接:https://www.zhihu.com/question/433702668 声明:仅做学术分享,侵删

作者:小牧牧

链接:https://www.zhihu.com/question/433702668/answer/1617092684

来源:知乎

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

我来列举一些机器学习(Machine Learning)领域的高被引文章。

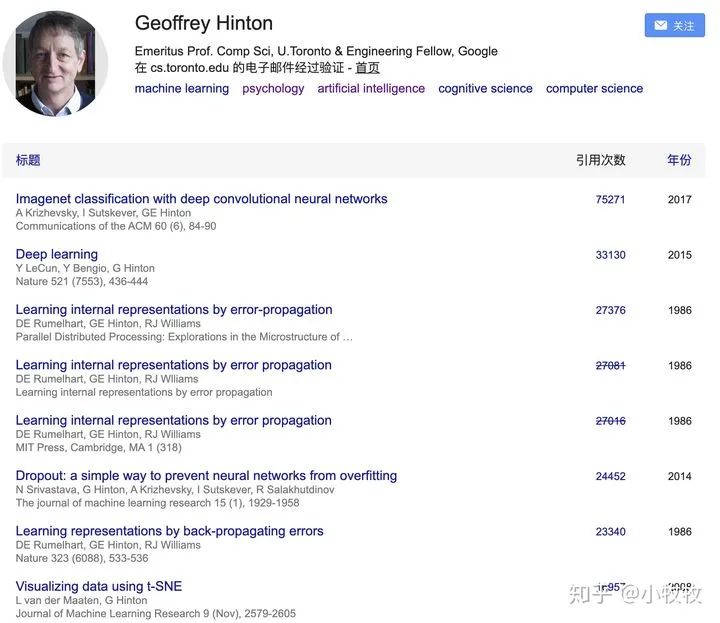

机器学习领域泰斗级学者Geoffrey Hinton的文章引用:

引用次数超过15000次文章有6篇。

ImageNet Classification with Deep Convolutional Neural Networks,引用75231次(AlexNet,点燃了深度学习的热潮,因此2012年被认为是深度学习元年,当然要十分感谢ImageNet和GPU的加持);

Learning internal representations by error-propagation & Learning representations by back-propagating errors,引用50716次(BP算法,殿堂级别的成果,几乎所有关于神经网络的文章都会用到BP算法);

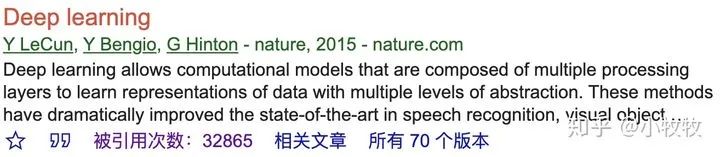

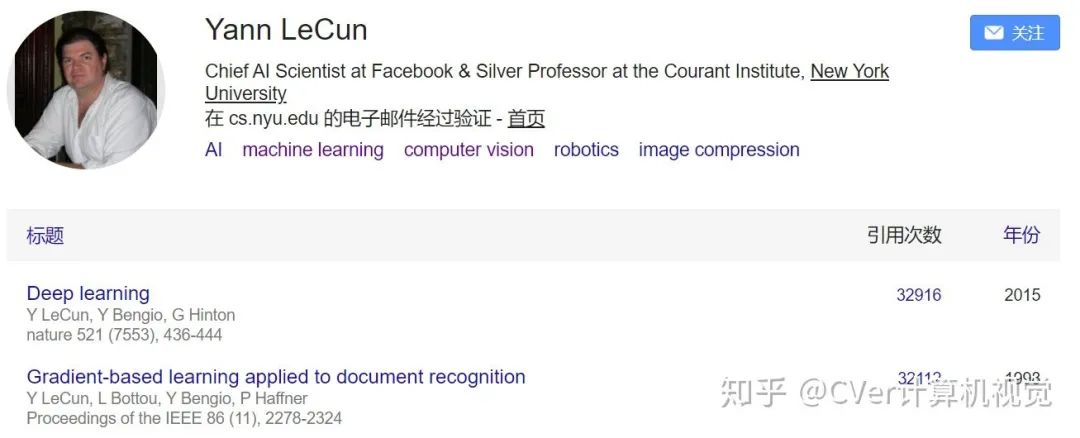

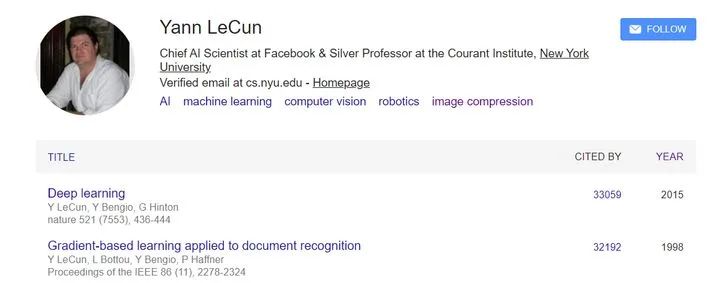

Deep learning,引用33222次(“三巨头”关于深度学习的综述文章);

Dropout: a simple way to prevent neural networks from overfitting,引用24452次(Dropout是一种防止深度学习模型过拟合的正则化方法,目前已被Google申请专利,面对封锁,华为诺亚实验室开源了Disout算法,直接对标Google的Dropout);

Visualizing data using t-SNE,引用16957次(t-SNE是一种流形学习方法,用于数据降维和可视化)。

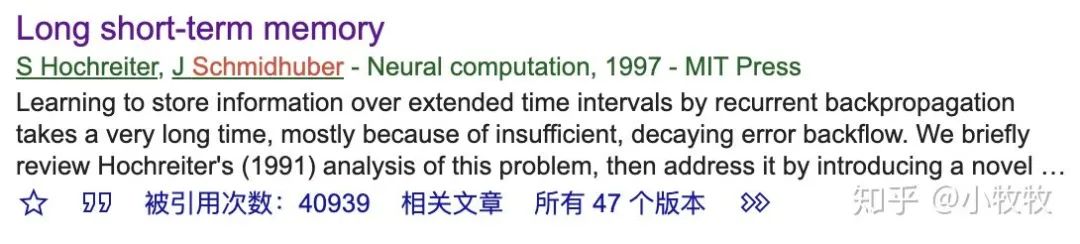

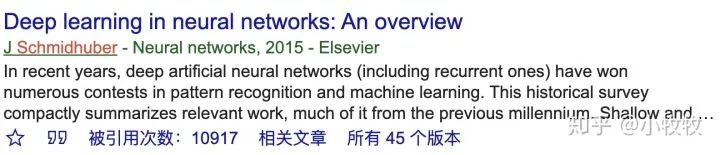

在机器学习领域还有一个泰斗级的人物Jürgen Schmidhuber,他的一篇文章Long short-term memory目前的引用量是40934次,是深度学习-循环神经网络(Recurrent Neural Network, RNN)中的重要成果。但是LeCun Y,Bengio Y和Hinton G在2015年发表在Nature上的文章Deep learning作者中没有Jürgen Schmidhuber,不过Schmidhuber在2015也发表了一篇关于深度学习的综述文章Deep learning in neural networks: An overview,目前的引用量是10917。后来,“三巨头“获得了2018年的“图灵奖”,Schmidhuber和“三巨头“在网络上因为“成果引用”和“成果认定”发生了大量的口水战,这些都是后话了。

机器学习领域还有一些重要的成果,对应的文章也有不俗的引用量。比如:

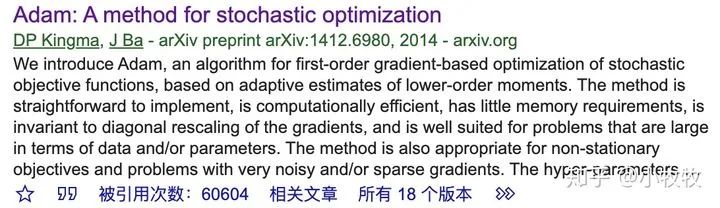

一直被对比,从未被超越的Adam,目前的引用量是60604次;

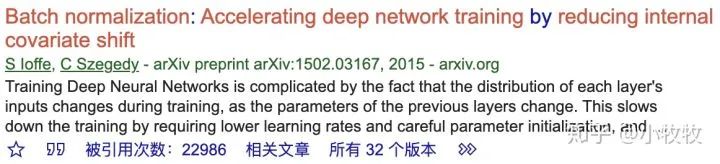

使神经网络训练更快、更稳定的Batch normalization,目前的引用量是22986次;

避免深层网络训练时梯度消失或梯度爆炸的激活函数—线性整流函数ReLU(Rectified linear units improve restricted boltzmann machines),目前的引用量是11548次。

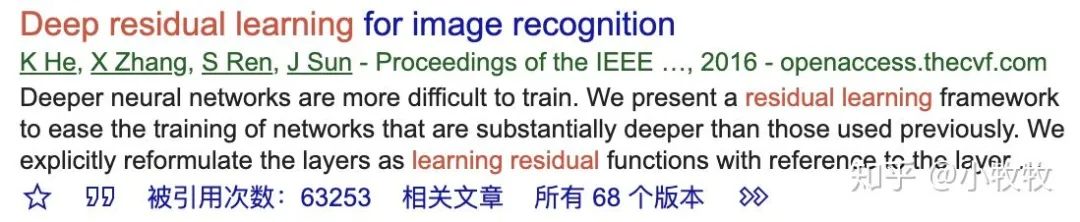

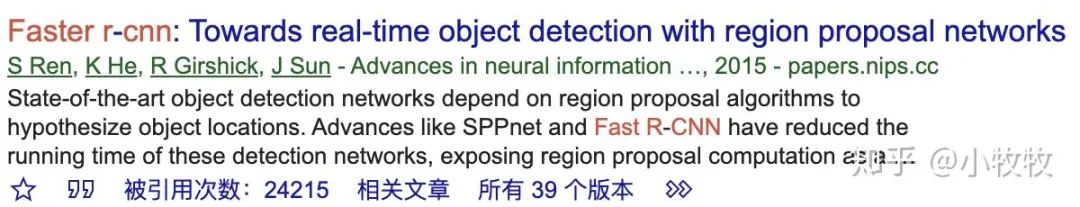

Zisserman在2014年发表的关于VGGNet的文章Very deep convolutional networks for large-scale image recognition,目前的引用量是48691次。Google在2015年发表的关于GoogLeNet的文章Going deeper with convolutions,目前的引用量是26353次。何凯明2016年的文章Deep residual learning for image recognition,提出的多达152层ResNet,目前的引用量是63253次。2016年提出的用于目标检测的Faster R-CNN,目前的引用量是24215次。

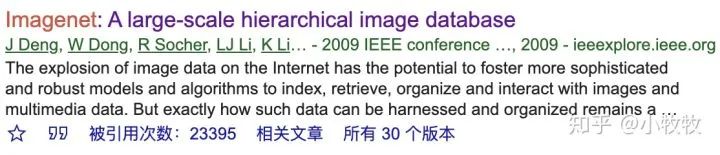

女神李飞飞构建的ImageNet是计算机视觉(Computer vision)领域非常著名的大型数据集,关于ImageNet的论文ImageNet: A large-scale hierarchical image database发表时间是2009年,目前的引用量是23395次,AlexNet就是在2012年ImageNet大规模视觉识别挑战赛(ILSVRC)上一举成名,自此点燃了深度学习的热潮,可见大规模数据对于深度学习的重要性。

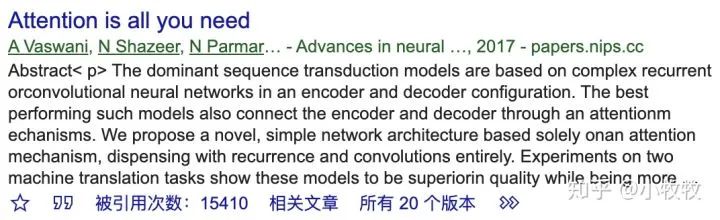

经常被调侃“Money(GPU) Is All You Need”的文章Attention Is All You Need目前的引用量是15410次,这篇文章提出的Transformer是自然语言处理(NLP)领域的重要成果,它的出现迅速取代了LSTM在NLP领域的霸主地位,像BERT、GPT这样的SOTA模型均采用Transformer。NLP领域的另一个重量级成果是word2vec,作者是来自Google的Tomas Mikolov,关于word2vec的两篇文章Distributed representations of words and phrases and their compositionality和Efficient estimation of word representations in vector space目前的引用量分别是24323次和19220次(感谢@ccking的提醒),其实我一直觉得NLP比图像处理问题复杂的多,最让人头疼的莫过于如何将语言数字化,我对此的了解仅限于One-hot encoding,实在是太难了。

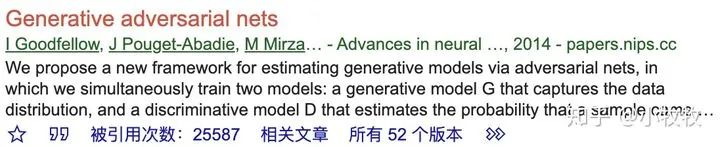

谷歌大神Ian Goodfellow的关于GAN的文章Generative adversarial nets目前的引用量是25592次,关于GAN究竟是谁提出来的我就不得而知了,但是Schmidhuber在这个问题上肯定有很多话要说,至于Schmidhuber究竟说了些啥,参见:郑华滨:从PM到GAN——LSTM之父Schmidhuber横跨22年的怨念(文字版)。

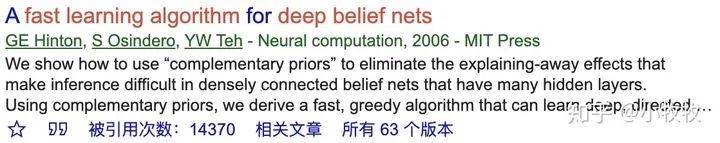

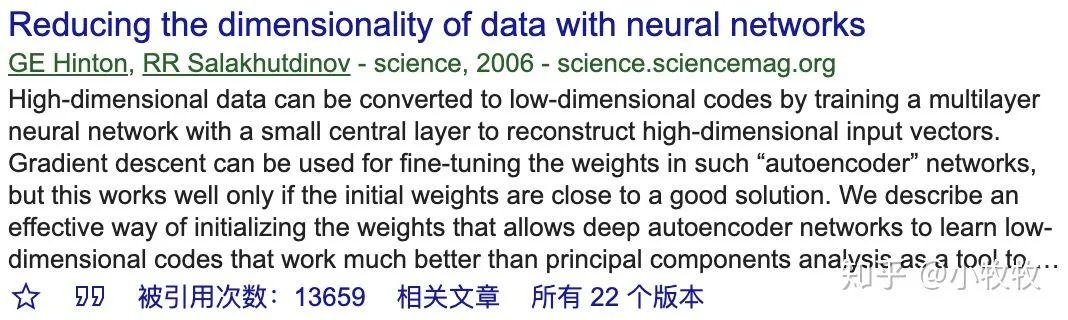

Hinton老爷子在2006年提出的深度置信网络(DBN)被普遍认为是深度学习的前夕,关于DBN的两篇文章A fast learning algorithm for deep belief nets和Reducing the dimensionality of data with neural networks的引用量分别是14370次和13659次,DBN是Hinton老爷子最引以为傲的成果,它是一种由多个限制玻尔兹曼机(RBM)堆栈而成的概率生成模型,是最初训练深度网络的一种方法,尽管目前深度学习模型不再需要这种预训练,但它的思想仍然影响着当前的研究工作。

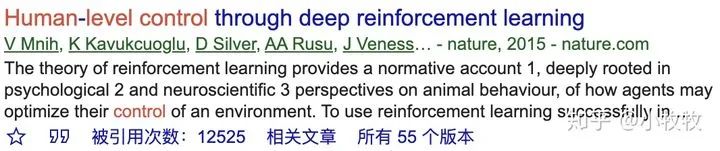

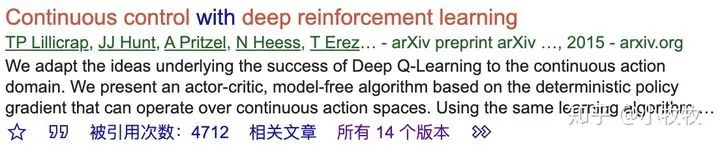

未来我认为机器学习领域的另一个方向将会有大量的文章引用次数超过15000,这个领域就是强化学习(Reinforcement learning)。强化学习领域的奠基人之一是来自DeepMind的Richard S. Sutton,它的贡献主要在时序差分学习和策略梯度法,Sutton是David Silver的老师,Silver最引人瞩目的成果就是AlphoGo & AlphoGo Zero。

Sutton的专著Reinforcement Learning, An introduction目前的引用量是47121次。强化学习与深度学习碰撞出的DQN方法目前的引用量是12525,用于连续控制的DDPG方法的引用量是4712。最近DeepMind开发AlphaFold利用AI技术解决生物学50年来的重大挑战-预测蛋白质折叠,可见AI技术在众多领域表现出惊人的生命力,期待AI成为人类扩展科学知识边界的“得力助手”。

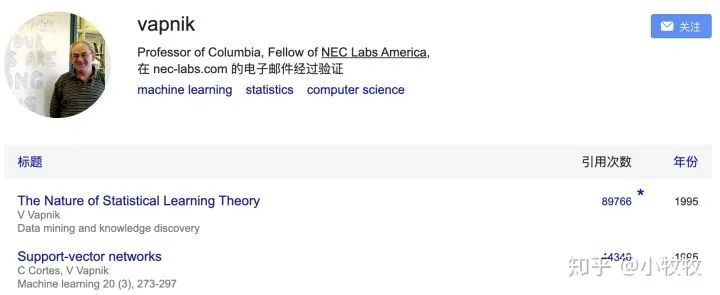

其实近几年深度学习的大热使得一些传统的机器学习算法不被人们广知。比如Vapnik在1995年基于统计学习理论提出的支持向量机(Support Vector Machine, SVM),代表性文章Support-vector networks目前的引用量是44340次,Vapnik的关于统计学习理论的专著The Nature of Statistical Learning Theory目前的引用量是89766次。

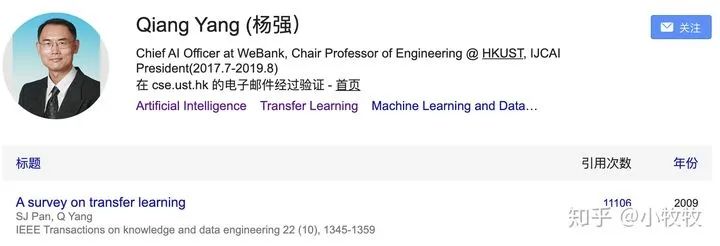

机器学习领域很多方向都是由外国学者主导的。很庆幸的是,我们在迁移学习(Transfer learning)这个方向占据了一席之地,迁移学习领域的发起人和带头人是香港科技大学的杨强教授。杨强教授的代表性文章A survey on transfer learning目前的引用量是11106次。吴恩达在NIPS 2016中说:Transfer learning will be the next driver of machine learning commercial success after supervised learning to highlight the importance of transfer learning,让我们拭目以待吧。

看到很多人喜欢这个回答,我就分享一下我对机器学习的认识和理解。

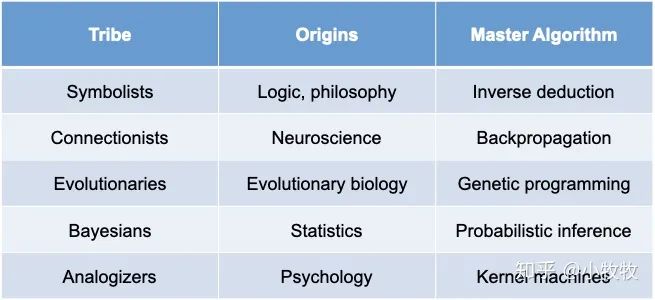

机器学习被普遍认为是一种最有希望实现人工智能(Artificial intelligence, AI)的方法,经几十年的发展,机器学习领域涌现了大量的成果,Pedro Domingos教授将机器学习总结为5大流派,分别是Symbolists、Connectionists、Evolutionaries、Bayesians和Analogizers。机器学习领域的最初成果是符号主义,它的优点在于学习的模型和结果很容易实现跨领域和跨任务的推广,但是由于知识获取和表示的困难,以及当时计算能力的限制,符号主义的主张没有得到应用的发展和大规模的应用。随着大规模数据量和高性能处理器的出现,联结主义(神经网络)得到了飞速的发展,2012年后,以深度学习为代表的联结主义迅速火爆全球,但是以数据驱动为基础的联结主义十分脆弱,推广能力也很差,这也是为什么人们并不信任深度学习模型决策的自动驾驶系统。

因此,很多学者对未来机器学习的发展方向提供了自己的见解,Geoffrey Hinto老爷子在NIPS2017发表了一篇题目为Dynamic routing between capsules的文章(目前的引用量为2071次),核心思想在于重视图像识别中主要特征的逻辑性,如果只关注主要特征而忽视特征之间的逻辑性,很容易出现一些非常低级的错误,比如一张图片中随机分布两个眼睛、一个鼻子和一张嘴,现有的深度学习模型会认为这是一张人脸,简直不可思议。张钹院士在《迈向第三代人工智能》文章中指出:当前需要将符号主义和联结主义这两种范式结合起来,去发展安全、可信、可靠和可扩展的 AI 技术,即第三代AI技术。

我非常认同张钹院士的观点,就机器学习技术在其他学科的应用来说,我认为,数据驱动技术应该建立在领域知识(控制方程)的框架内,去开发一些physics-based & physics-informed的方法,从而使得机器学习做出合理的决策,对其他学科的发展起到催化作用。

另外这里重点盘点一下AI领域,特别是CV方向的论文。

值得说一下,自从2012年,特别是2014年后,AI领域再度火爆,延续至今,很多优秀论文(特别是基于深度学习)也是发表在这个期间,引用量也迅速爆炸。

注:下面会边介绍作者,边介绍论文,侧重点有点不同。

计算机视觉领域引用量1.5万+的论文

Andrew Zisserman(传闻欧洲计算机视觉第一人)

第一篇引用量近5万的是:深度学习时代的经典backbone模型VGG:Very deep convolutional networks for large-scale image recognition

第二篇引用量近3万,这其实是一本书《Multiple view geometry in computer vision》,可称为深度学习时代前的CV必读之作(现在其实也强推,但不少新入坑CV的人,直接跳过这些基础知识,去玩CNN了)

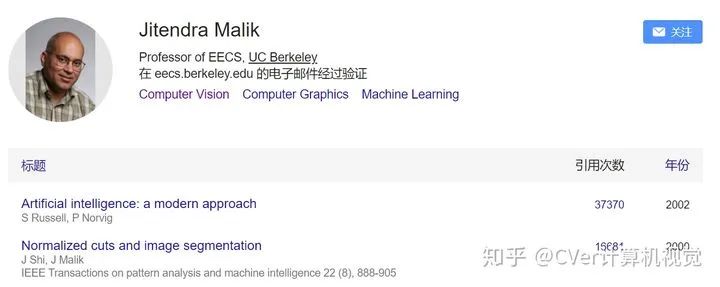

Jitendra Malik

加州大学伯克利分校的电子工程与计算机科学系(EECS)教授 Jitendra Malik获颁 2019 年 IEEE 计算机先驱奖。

第一篇引用量近4万,算是12年之前人工智能最经典的书籍,内容覆盖范围相当之广。不过Jitendra Malik并非一二作,所以搜索该书的时候,不容易看到他的名字。

第二篇引用量近1.7万,基于传统方法的图像分割代表作!

下面说说深度学习三巨头(Hinton、Bengio和LeCun)

Geoffrey Hinton

Hinton老爷子的代表作太多了,1.5万+引用量的论文见下图(6篇)。比如

第一篇引用量7.5万+,发表于2012年的AlexNet!永远滴神!

第二篇引用量3.3万+,是为了纪念人工智能60周年,深度学习三巨头合作在Nature上发表深度学习的综述性文章:Deep Learning

还有4篇破1.5万引用量的论文,这里不赘述,膜拜即可!

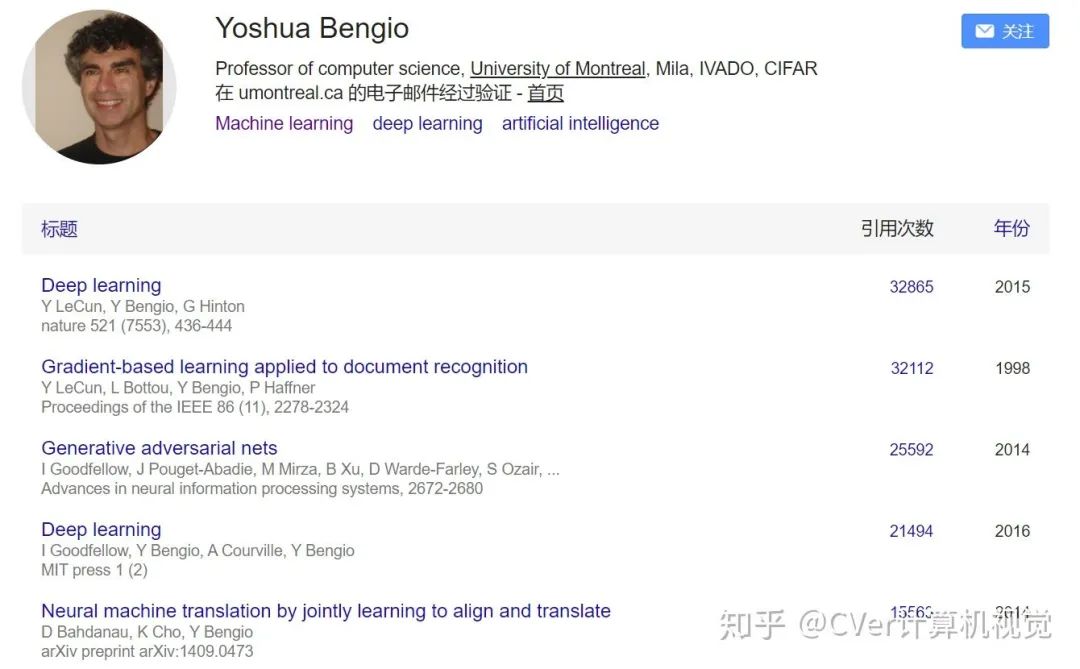

Yoshua Bengio

Bengio教授的代表作也太多了,1.5万+引用量的论文见下图(5篇)。比如:

第一篇上面说过了,是深度学习三巨头合著的。

第二篇引用量3万+,这是和LeCun提出了当时风靡一时的字符识别器(当时就是典型落地应用)

第三篇引用量2.5万+,这是和Goodfellow提出了鼎鼎大名的GAN!

第四篇引用量2万+,这是和Goodfellow发布了深度学习时代的"圣经"书籍:Deep Learning,国内不少人又称为花书。

Yann LeCun

LeCun大佬的两篇破1.5万的工作,上面已经介绍了。

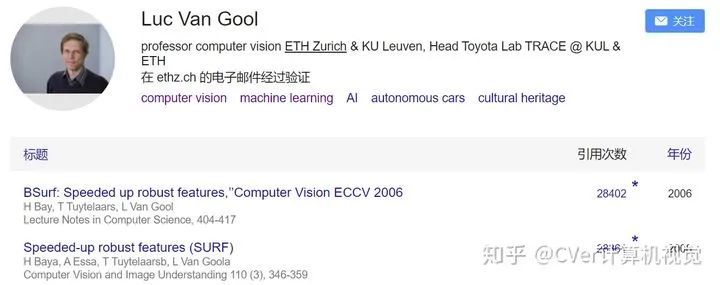

Luc Van Gool

Luc Van Gool 苏黎世联邦理工学院教授,据了解,有若干中国学生曾师从于他。

这篇近3万引用量就是非常著名的SURF算法

上面提到SURF算法,就不得不提SIFT算法。

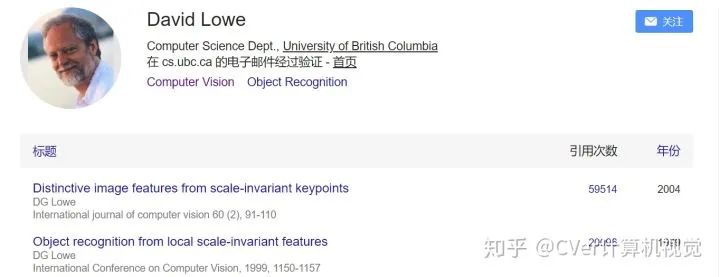

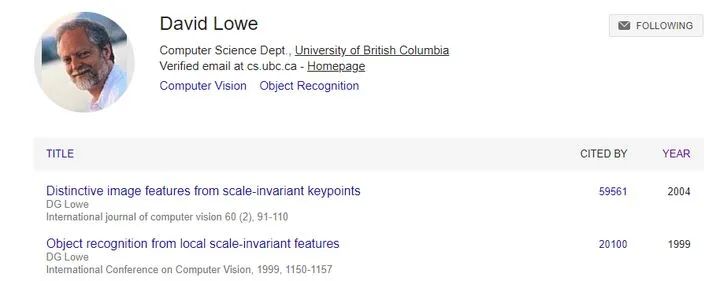

David Lowe

SIFT算法引用量近6万!其是手工特征时代的最具代表性工作!SURF、ORB在它面前都是弟弟,截止目前SIFT仍被广泛应用,相当能打!

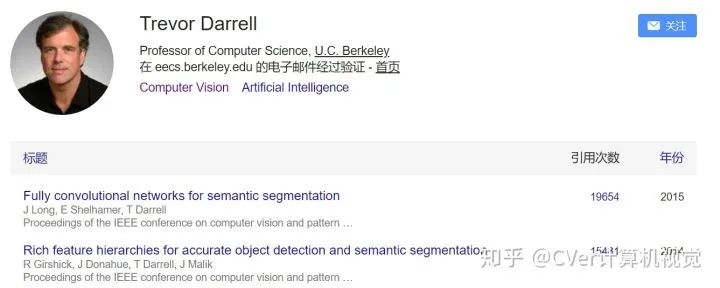

Trevor Darrell

第一篇引用量近2万,鼎鼎大名的基于FCN的语义分割网络!

第二篇引用量1.5万+,鼎鼎大名的R-CNN目标检测网络。

李飞飞(Li Fei-Fei)

李飞飞女神,创建了ImageNet数据集和相关赛事~ 影响力巨大

上述主要是AI、CV领域的大前辈(年龄基本40+),这里重点介绍几位"新秀":

何恺明(Kaiming He)

做CV的应该都听过何恺明,有鼎鼎大名的ResNet、Faster R-CNN、Mask R-CNN、Focal Loss、FPN和近期的MoCo等工作。

第一篇是目前CV主流使用的backbone:ResNet,永远滴神!

第二篇是目标检测领域代表性网络:Faster R-CNN

估计17年发表的Mask R-CNN 也快破1.5万引用量了

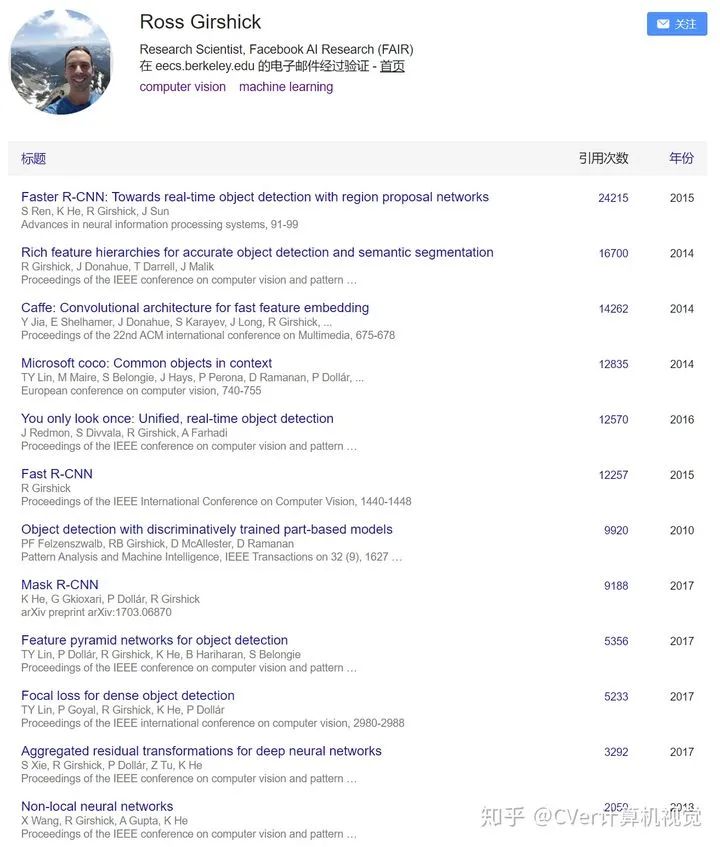

Ross Girshick

他与何恺明算是合作搭档,都在FAIR工作,有不少合作的工作。

有鼎鼎大名的R-CNN系列工作,合作的有Caffe、Mask R-CNN、Focal Loss、FPN和YOLO等工作。

Ian Goodfellow

GAN 之父!下面三个工作都是目前顶级活跃的,比如GAN、Deep Learning书籍和TensorFlow框架

任少卿(Shaoqing Ren)

Faster R-CNN一作!貌似现在不做研究了,主要在企业(目前在蔚来)担任技术主管/副总裁。

其实CV领域还有很多超1.5万的论文,限于篇幅这里就不一一盘点:

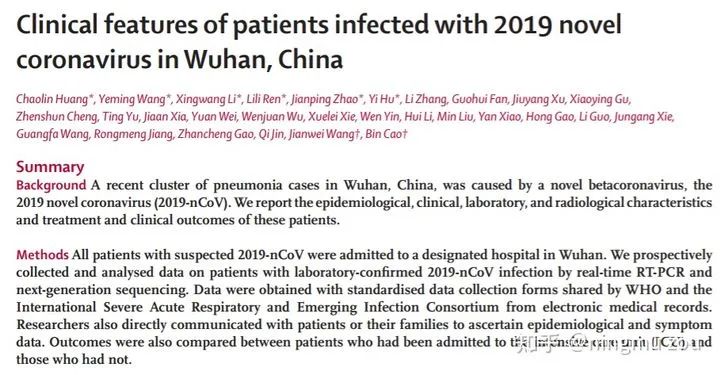

2020年1月底发表在《柳叶刀》的文章,一年时间不到超过两万次引用,应该是人类科学史上从发表到被引用超过两万次用时最短的文章。第一作者是武汉金银潭医院的副院长黄朝林,通讯作者是中日友好医院曹彬。文章报道了2019年底在武汉发现的一种能感染人类的新型乙类冠状病毒以及其临床特点。现在再阅读此文有种幻如隔世的不真实感。

作者:BeyondSelf

链接:https://www.zhihu.com/question/433702668/answer/1624083551

来源:知乎

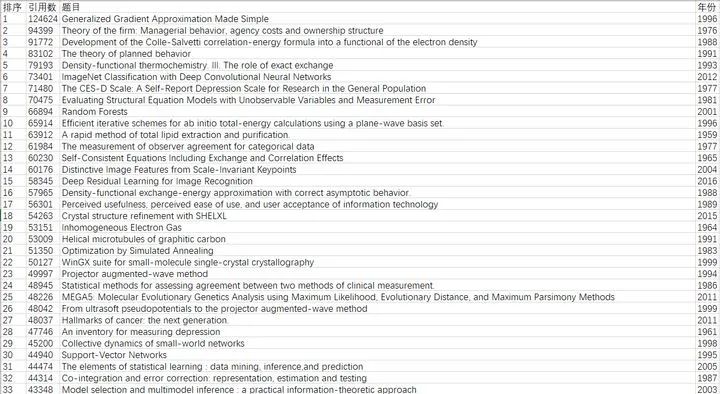

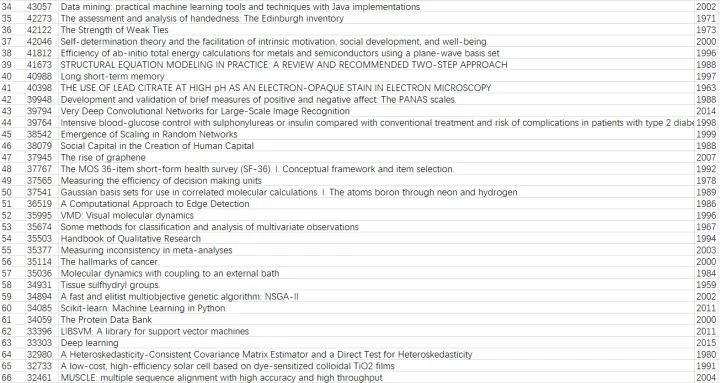

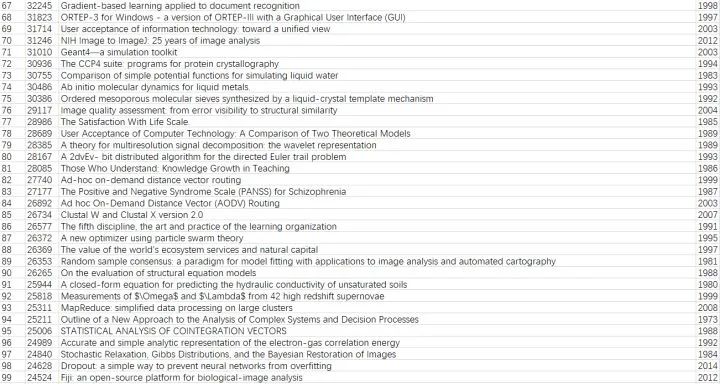

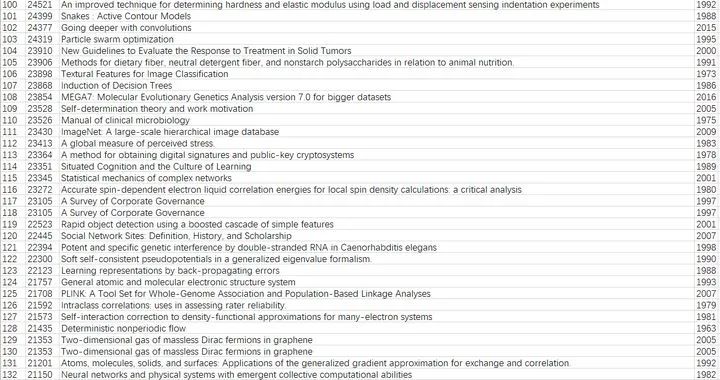

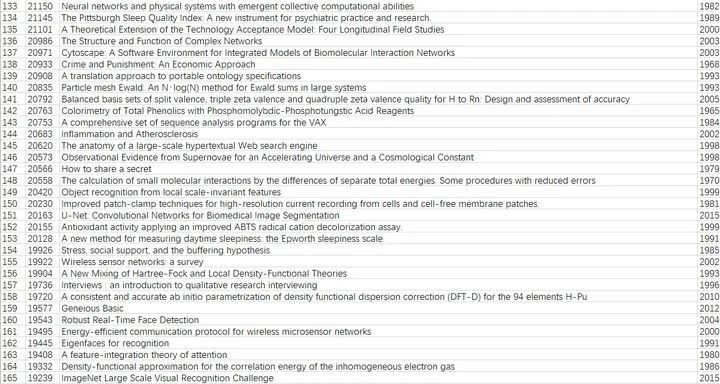

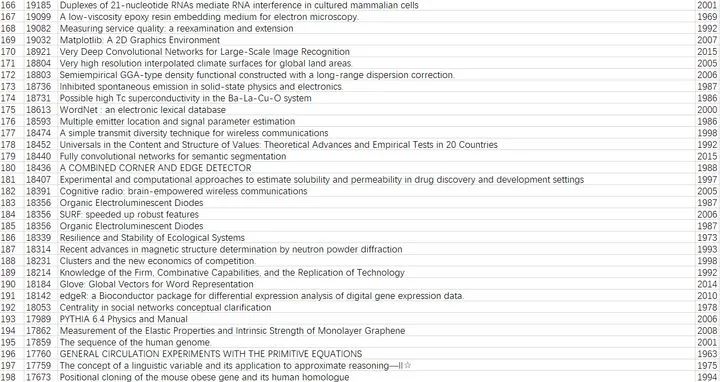

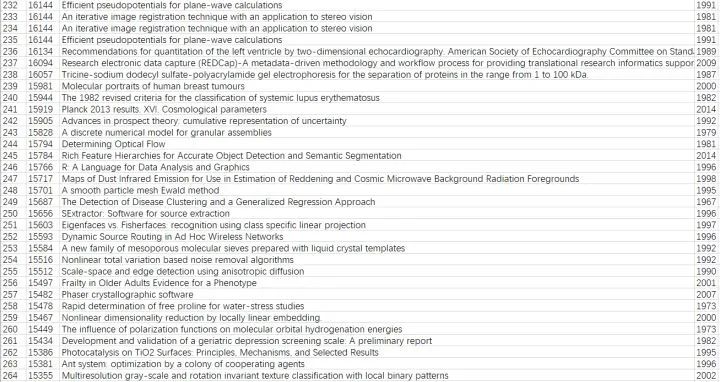

这一次我要来一点硬核的,暴力搜索跟IEEE的关键词相关的高被引论文,主要涉及计算机、自动化、通信、电气、机器学习等领域,得到300篇引用次数在15000以上的论文。

做法如下:

使用IEEE提供的关键词文档,选取它的所有一级关键词,作为我们搜索论文时所使用的关键词

调用微软学术的搜索API

对每一个关键词搜索,得到引用排名前1000的论文

将所有论文合并,删除重复值,进行排序

按照引用次序,得到相关的300篇论文

以下就是结果:

作者:BeyondSelf

链接:https://www.zhihu.com/question/433702668/answer/1624083551

来源:知乎

我梳理一下通信和图像处理方面,读过的一些经典的,超过15000引用的论文.

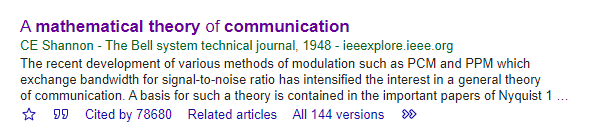

A Mathematical theory of communication

引用次数:78680

评价:开创了信息论,直接奠定了通信的发展,大名鼎鼎的香农三定理和熵的概念就是在这篇文章中提出的。没有它,就没有WiFi和5G,也没有我们刷着知乎听着歌

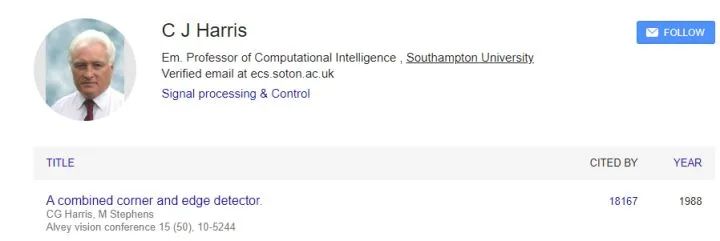

2. A combined coerner and edge detector

引用次数:18167

评价:提出了角点特征,能够检测图片中的角点、边缘和图片。是图像特征提取的代表作,是图像分割、匹配等的基础。

3. Distinctive image features from scale-invariant keypoints

引用次数:59561

评价:大名鼎鼎的SIFT特征,具有尺度、方向、仿射不变性,和上一篇论文的Haris特征一起,成为图像特征提取的两个最重要技术。

4. Object recognition from local scale-invariant features

引用次数:20100

评价:David Lowe的另一篇文章,说的是利用尺度不变特征来进行目标识别

5. Compressed Sensing

引用次数:27557

评价:压缩感知的代表作之一,将采样和压缩过程结合起来同时进行,直接对信号的稀疏性进行感知。

6. Robust Uncertainty Principles: Exact Signal Reconstruction From Highly Incomplete Frequency Information

引用次数:16700

评价:压缩感知的另一篇代表作

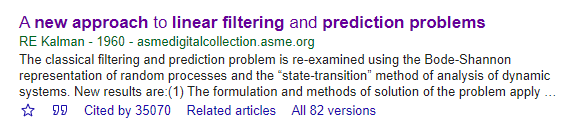

7. A new approach to linear filtering and prediction problems

引用次数:35070

评价:提出了著名的卡尔曼滤波。如果你没听说过卡尔曼滤波不要仅,但你一定点过外卖,打过滴滴,甚至美国阿波罗号上天也用过它,根据测量值和状态方程修正真实值,就是它干的事情,

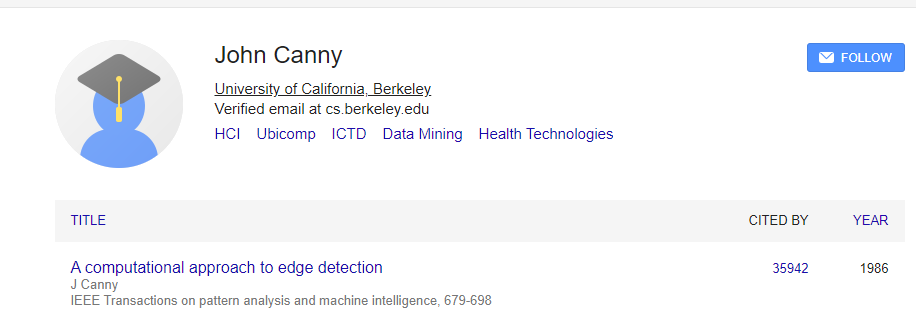

8. A computational approach to edge detection

引用次数:35942

评价:边缘检测的另一篇代表作

9. Gradient-based learning applied to document recognition

引用次数:32192

评价:LeCun的经典论文,做过机器学习的都知道,没做过机器学习的也一般听说过MNIST数据集

作者:远处群山

链接:https://www.zhihu.com/question/433702668/answer/1622573162

来源:知乎

引用一万五千次以上的论文相当罕见,基本上都属于开山之作,开创了某个中等或者大领域的作品。也可以说是养活了很多人的作品...

现在深度学习的论文里15000次引用的挺多的,看到也有其他答主总结了,我就重点说下信号处理和图像处理的经典论文,

压缩感知的两篇开山之作:

Donoho D L. Compressed sensing[J]. IEEE Transactions on information theory, 2006, 52(4): 1289-1306. 27000次引用

Candès E J, Romberg J, Tao T. Robust uncertainty principles: Exact signal reconstruction from highly incomplete frequency information[J]. IEEE Transactions on information theory, 2006, 52(2): 489-509. 16000次引用

统计学习里大名鼎鼎的LASSO:

Tibshirani R. Regression shrinkage and selection via the lasso[J]. Journal of the Royal Statistical Society: Series B (Methodological), 1996, 58(1): 267-288. 引用35000次

统计学习的圣典:

Cortes C, Vapnik V. Support-vector networks[J]. Machine learning, 1995, 20(3): 273-297.

图像分割的开山之作normalized cut:

Shi J, Malik J. Normalized cuts and image segmentation[J]. IEEE Transactions on pattern analysis and machine intelligence, 2000, 22(8): 888-905. 引用16000次

同样来自Malik老师的图像去噪神作——扩散滤波,威名赫赫的Perona-Malik模型,多少PDE-based image processing methods就是源自这里:

Perona P, Malik J. Scale-space and edge detection using anisotropic diffusion[J]. IEEE Transactions on pattern analysis and machine intelligence, 1990, 12(7): 629-639. 引用15000次

图像去噪的又一神作,超级经典的全变差模型:

Rudin L I, Osher S, Fatemi E. Nonlinear total variation based noise removal algorithms[J]. Physica D: nonlinear phenomena, 1992, 60(1-4): 259-268. 引用15000次

无比经典的SIFT图像特征检测以及方向梯度直方图(HOG)模型,做图像处理的应该没有不知道这两个的:

Lowe D G. Distinctive image features from scale-invariant keypoints[J]. International journal of computer vision, 2004, 60(2): 91-110. 58000次引用

Dalal N, Triggs B. Histograms of oriented gradients for human detection[C]//2005 IEEE computer society conference on computer vision and pattern recognition (CVPR'05). IEEE, 2005, 1: 886-893. 32000次引用

做图像恢复的人肯定都知道SSIM这个指标,出自这篇文章:

Wang Z, Bovik A C, Sheikh H R, et al. Image quality assessment: from error visibility to structural similarity[J]. IEEE transactions on image processing, 2004, 13(4): 600-612. 引用27000

往期精彩:

求个在看