【机器学习】Bagging思想!

共 4283字,需浏览 9分钟

· 2021-08-10

↑↑↑点击上方蓝字,回复资料,10个G的惊喜

作者:小偶,来源:偶数科技

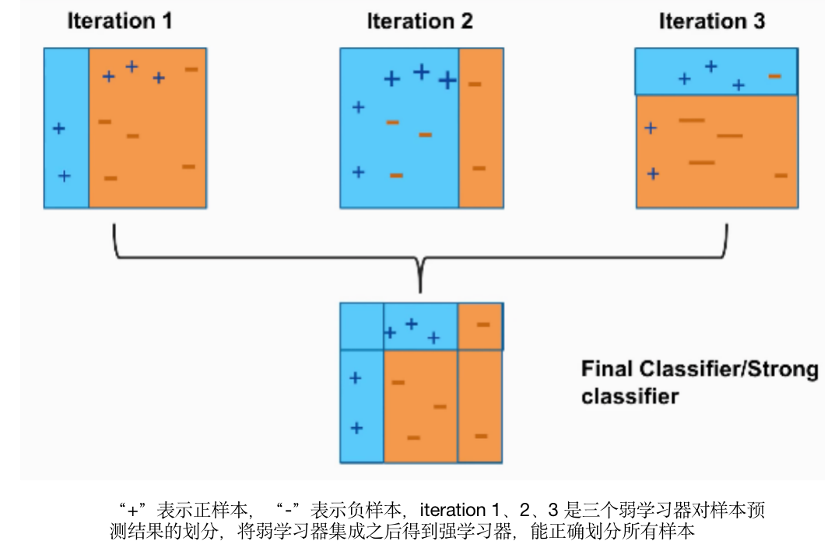

· 为什么要使用集成学习 ·

· 机器学习建模的偏差和方差 ·

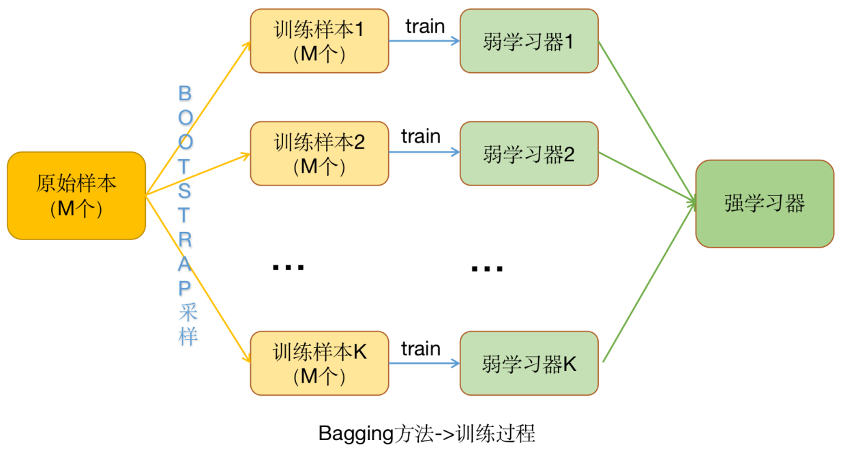

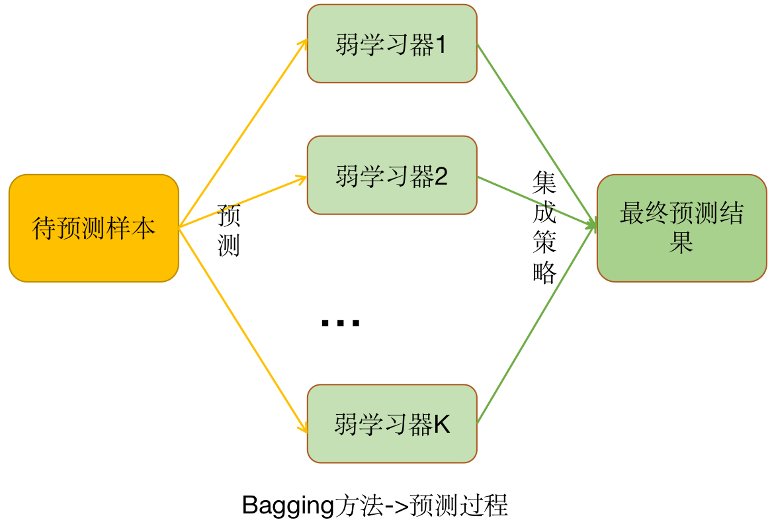

· 集成学习之Bagging思想 ·

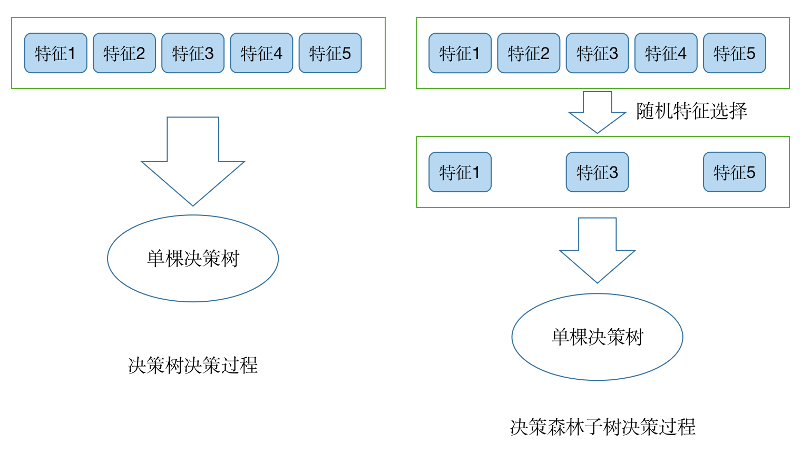

· 随机森林 (Random Forest) ·

随机森林算法原理

随机森林是在Bagging策略的基础上进行修改后的一种算法,方法如下:

随机森林OOB Error

对于已经生成的随机森林,用袋外数据测试其性能,假设袋外数据总数为O,用这O个袋外数据作为输入,带进之前已经生成的随机森林分类器,分类器会给出O个数据相应的分类,因为这O条数据的类型是已知的,则用正确的分类与随机森林分类器的结果进行比较,统计随机森林分类器分类错误的数目,设为X,则袋外数据误差大小为X/O。

优点:这已经经过证明是无偏估计的,所以在随机森林算法中不需要再进行交叉验证或者单独的测试集来获取测试集误差的无偏估计。

缺点:当数据量较小时,Bootstrap采样产生的数据集改变了初始数据集的分布,这会引入估计偏差。

· 随机森林算法变种 ·

Extra Trees (ET)

Totally Random Trees Embedding (TRTE)

Isolation Forest (IForest)

· 随机森林优缺点总结 ·

本期AI小课堂我们一起了解了Bagging思想及其原理,以及基于Bagging的随机森林相关知识。最后,让我们一起总结下随机森林的优缺点:

优点

缺点

推荐阅读

(点击标题可跳转阅读)

老铁,三连支持一下,好吗?↓↓↓