转自 | 新智元

来源 | GitHub

编辑 | LRS

随着AI技术的发展,在模仿脸之后,模仿声音也不是难事。最近GitHub上一个超火的项目,可以快速模仿声音,最重要的是支持中文,目前已收获8700星!

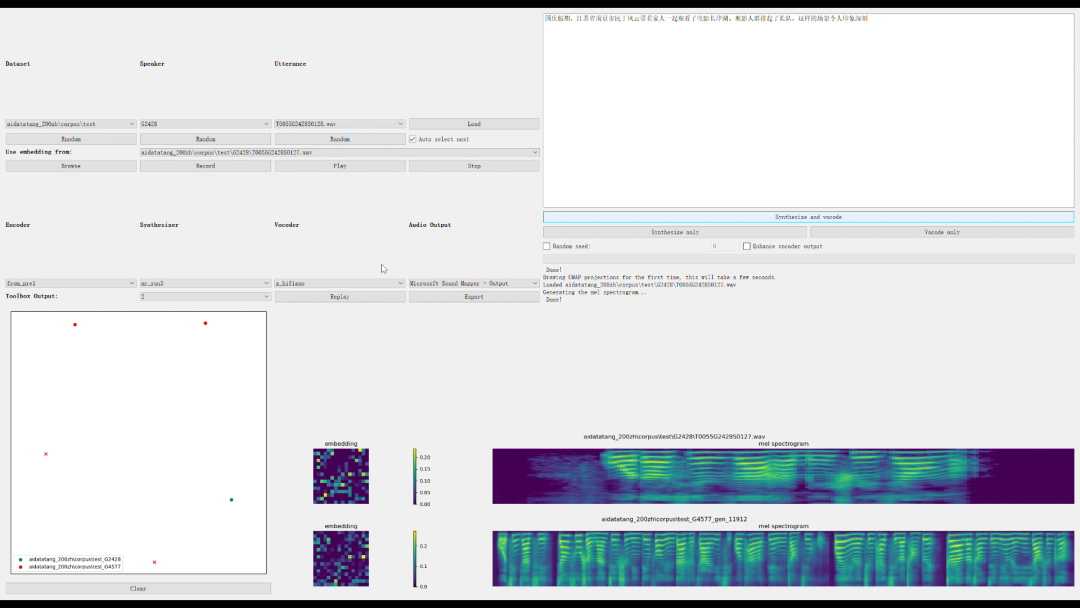

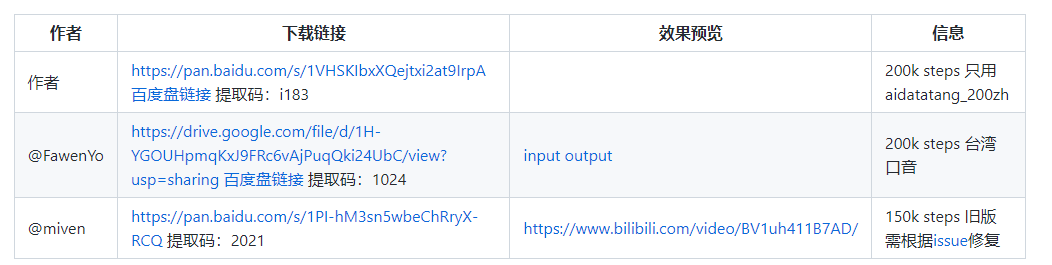

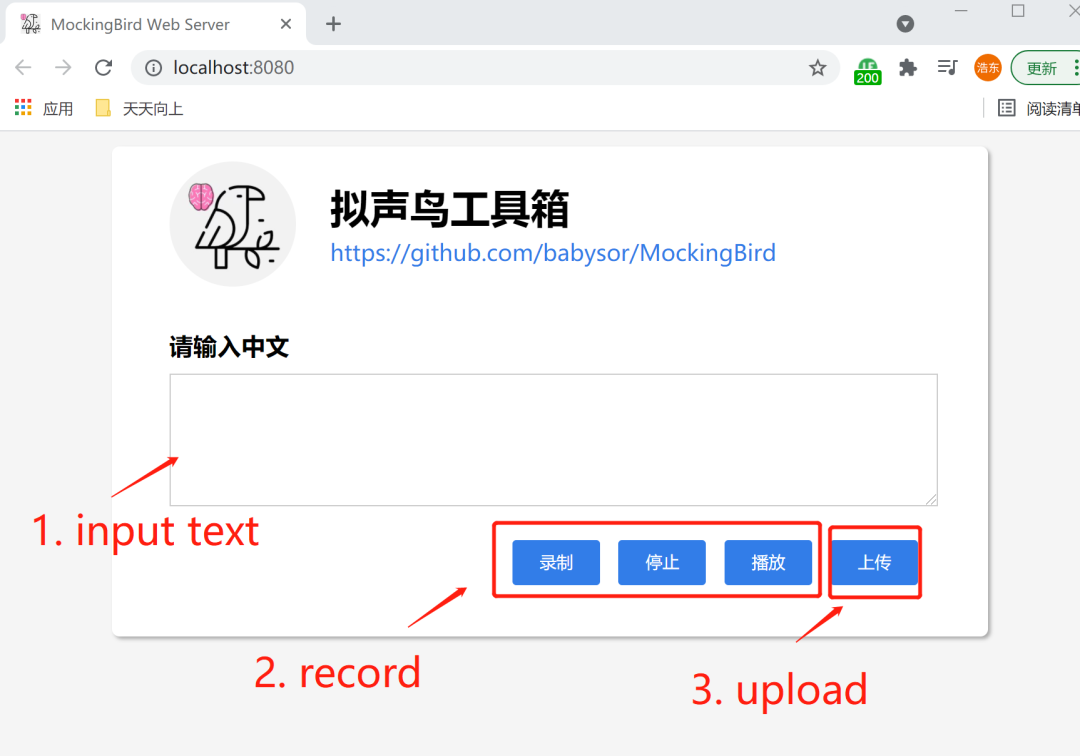

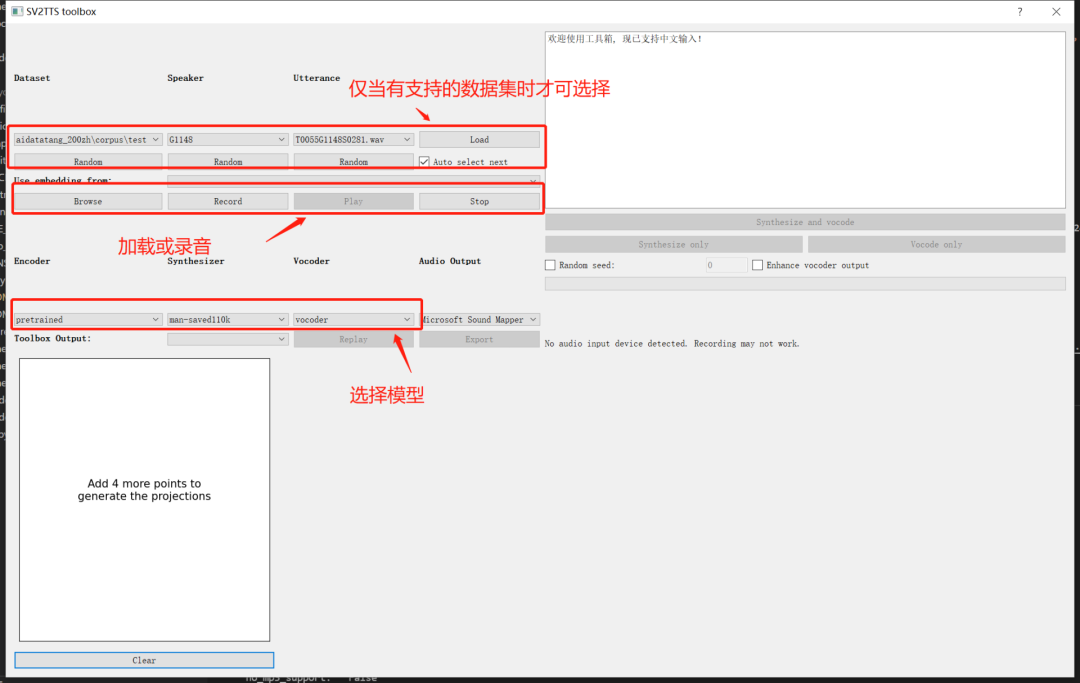

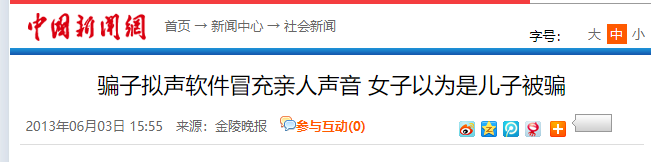

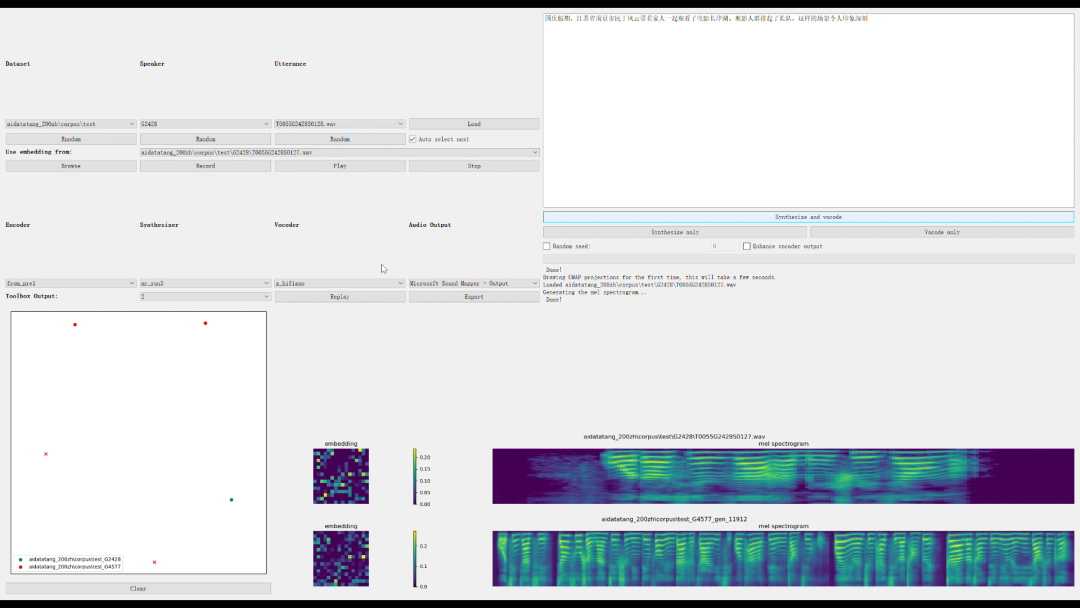

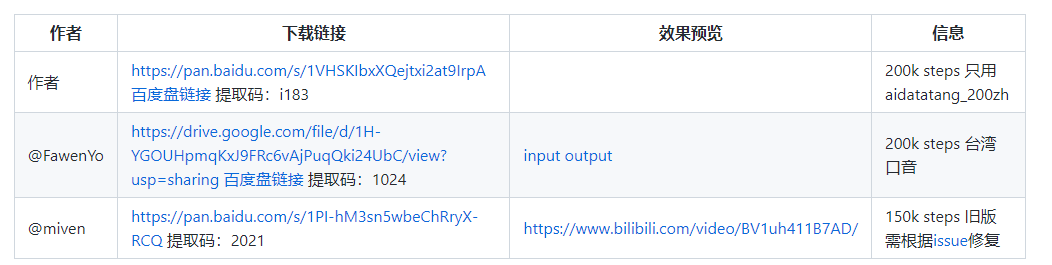

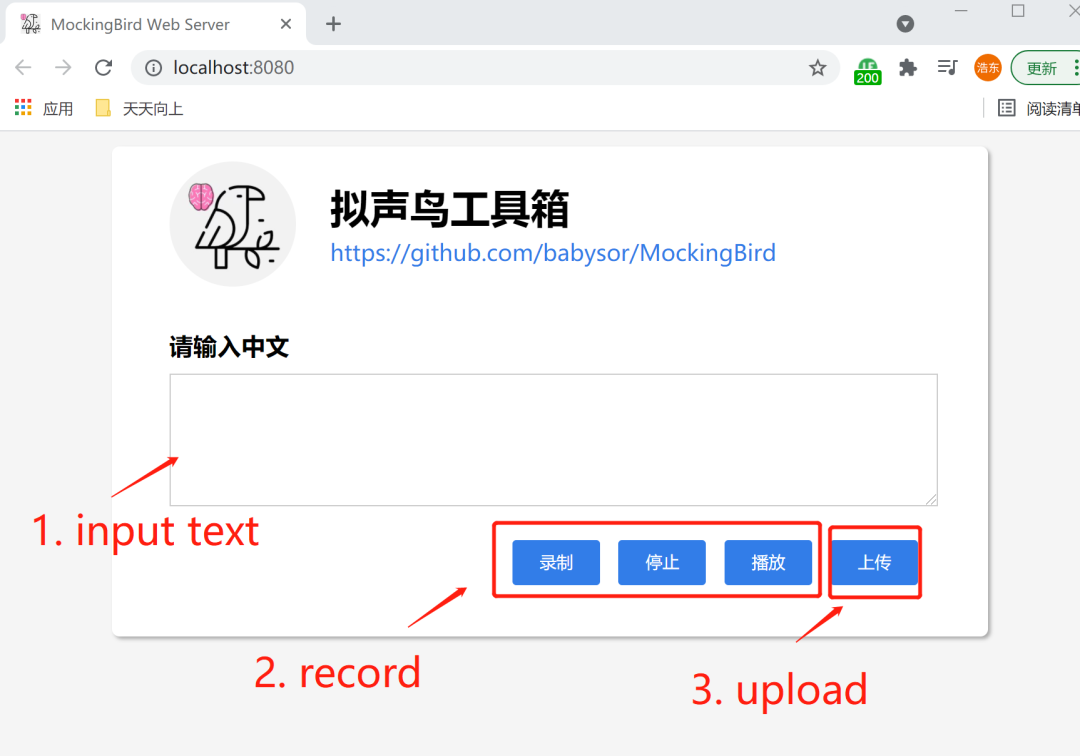

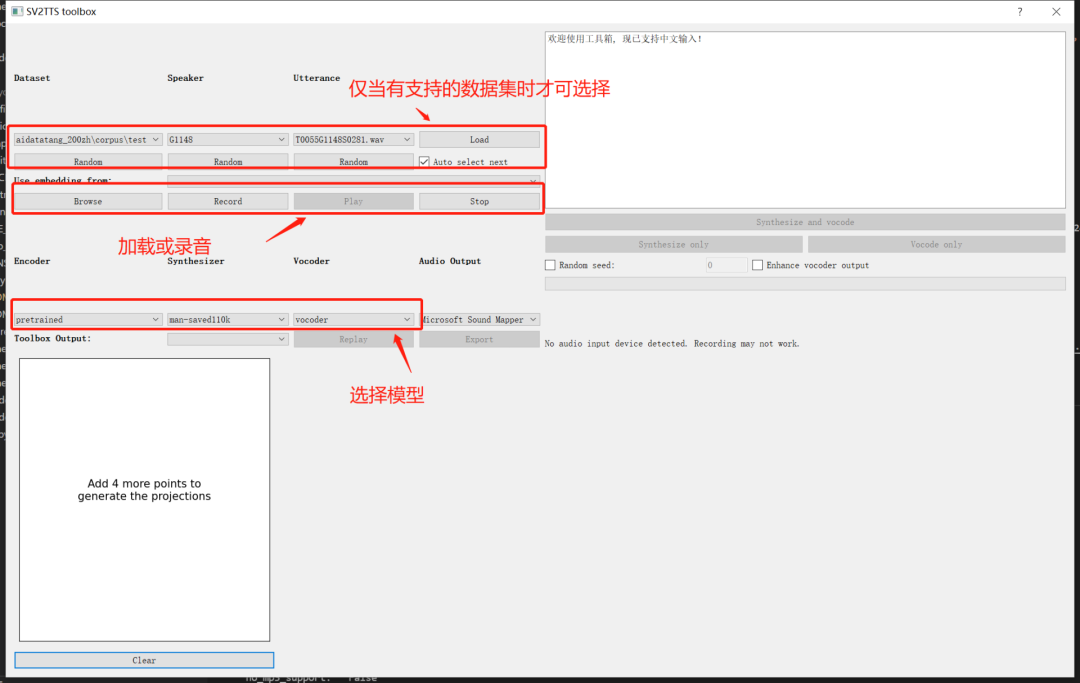

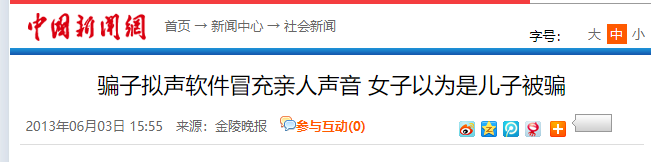

GitHub上有一个项目最近登上了每日趋势榜,只需5秒,就能用AI 技术来模拟声音来生成任意语音内容,并且还支持中文。https://www.bilibili.com/video/BV17Q4y1B7mY/1、支持普通话并使用多种中文数据集进行测试:aidatatang_200zh,magicdata,aishell3,biaobei,MozillaCommonVoice等;2、适用于pytorch,已在1.9.0版本(最新于2021年8月)中测试,GPU Tesla T4和GTX 2060;3、可在Windows操作系统和linux操作系统中运行(苹果系统M1版也有社区成功运行案例);4、仅需下载或新训练合成器(synthesizer)就有良好效果,复用预训练的编码器/声码器,或实时的HiFi-GAN作为vocoder;5、提供一个Webserver可查看训练结果,供远程调用。项目的作者是前Facebook的工程师,目前创业状态,创作的Mocking Bird仅用10天就窜上了GitHub Trending榜。并且在知乎上还有专栏MockingBird训练小技巧,可以说是保姆级教程了。例如作者分享的经验,在同一个数据集中大概训练了100k step之后,如果loss一直反复围绕一个值波动,同时发现生成效果不升反降,很可能你陷入了训练的过拟合(overfitting),此时需要及时中断训练,采取新的训练姿势:2、修改 hparam.py 文件中的参数,例如 batch size,learn rate等,用同一或者新的数据集进行短暂的培训,确保loss和效果持续变好,否则Save/Load大法回退模型。中断训练时,可以加载最好效果的更初版本进行以上操作,例如你在150k发现过拟合,但是110k的模型效果优于150k的,就将110k的模型文件直接改名后当作主文件使用。首先安装好PyTorch、ffmpeg、webrtcvad-wheels和requirements.txt中要求的剩余包。第二步是准备预训练模型,可以使用作者提供的或者是其他人训练好的模型。重要的数据处理操作是进行音频和梅尔频谱图预处理:python pre.py <datasets_root> 可以传入参数--dataset {dataset} 支持aidatatang_200zh, magicdata, aishell3作者还贴心的附上了所有可以学习的论文及原始代码仓库。这个仓库的名字MockingBird是仿声鸟、反舌鸟,以善于模仿其他鸟类及昆虫、两栖动物的叫声而闻名,也是一种经常出现在西方文学或影视作品之中的鸟类,在生物学上是嘲鸫的俗称。著名的书的名字《杀死一只知更鸟》的英文就是To Kill a Mocking Bird,实际上属于翻译的错误,知更鸟的英文是Robin。当然这种AI 模仿别人的技术一定存在着重大的风险。早在2013年,就有新闻报道,骗子拟声软件冒充亲人声音,以为是儿子被骗。在电话里,骗子的声音和儿子的一模一样,谎称在学校出车祸撞了人,要王女士赶紧汇钱给人动手术,但实际上儿子根本都不会开车。在2013年,没有大规模神经网络加持下,变声软件还不是特别发达,当时在南京一家软件公司从事软件开发的工程师钱先生说,要想通过某一款软件来模仿别人的声音是很困难的,除了软件的支持,还要经过专业的技术处理。钱先生介绍,要达到模仿一个声音,不仅要从声音的音色、频率分析,还要考虑到语气和节奏等因素。一般来说,要通过软件拟声,首先是采样,内容尽量丰富,和需要模拟的说话内容接近。采样后就要进行后期的专业处理,然后再经过人工调试,达到模仿声音的目的。以当年的拟声技术,还是很容易被识破的,所以如果骗子要用它来骗人,一般都要营造一个嘈杂的环境,否则很容易被识破。而如今不需要专业知识就可以按照MockingBird给的提示很容易就可以模仿其他人的声音。甚至骗子也有可能瞄准不是普通人群进行诈骗,通过伪造其他身份进行诈骗。2020年12月也有一起诈骗案,12月,某公司财务小王接到领导电话,要求立刻给供应商转款2万元,并将转账信息以邮件形式发送,转款理由是避免缴纳滞纳金。由于老板的口音十分逼真,小王信以为真,在1小时内转款完成,后发现被骗。2019年9月,犯罪分子使用语音克隆软件对英国一家能源公司高管的声音进行模仿。该公司的执行董事在接听诈骗电话后,将24万美元汇入了一个匈牙利账户。目前,该罪犯仍未被抓获。2020年2月20日 ,互联网安全专家公司Symantec报告了三起音频诈骗案例,犯罪分子通过电话会议、YouTube、社交媒体以及TED演讲获得了公司高管的音频,然后用机器学习技术复制高管的声音,致电财务部门的高级成员要求紧急汇款。去年7月,美国科技媒体The Verge报道称,网络诈骗犯正在利用Deepfake仿制公司高管的语音,合成语音邮件发送至公司员工,对大型公司进行经济诈骗。近年来,以「深度伪造」技术(Deepfake)为代表的AI换脸技术日益成熟。通过「深度伪造」技术,可以将图片或视频中A的脸换到B的头上。其名字由深度机器学习(deep machine learning)和假照片(fake photo)组合而成。骗子首先分析公众发布在网上的各类信息,根据所要实施的骗术,通过AI技术筛选目标人群。在视频通话中利用AI换脸,骗取信任。安全分析公司Sensity的调查结果称,自2018年12月以来,“深度伪造”技术在线造假视频的数量大约每6个月翻一番,而截至2020年6月,造假视频已经多达49081个,比2019年7月增长了330%。随着AI 技术的不断升级,以往的识别方法很多都已经失效,例如合成人物不会眨眼等。道高一尺魔高一丈,技术无罪,关键要看谁来使用他。当然科技作为工具肯定越发达越好,不能因为道德因素而阻碍科学技术的进步。

参考资料:

https://github.com/babysor/MockingBird