yolov5目标识别+DeepSort目标追踪

引言

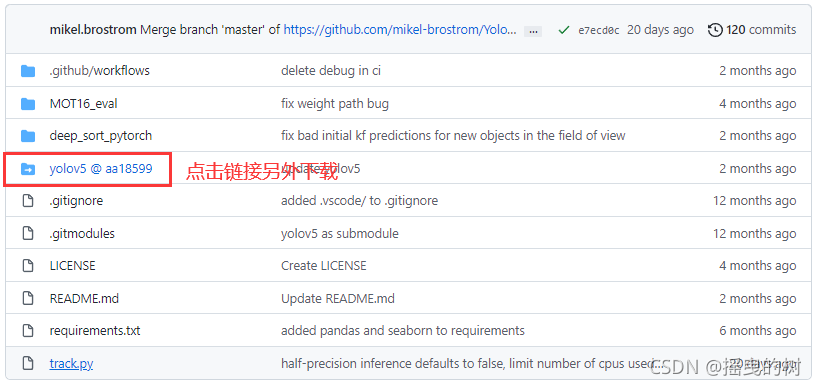

利用yolov5训练的目标识别模型,结合DeepSort实现目标追踪 源码下载:(1) (该源码下载下来的yolov5文件夹是空的,需要另外下载yolov5的源码) (2)

实现步骤

1 YOLO环境搭建+自定义模型训练

1、参考 先将yolov5的环境搭建好 2、参考 实现自定义的数据集训练

2 Yolov5_DeepSort_Pytorch 环境搭建

笔者在搭建完YOLO的环境后,基本不用再配置Yolov5_DeepSort_Pytorch,除了个别导入库,利用如下指令进行安装:

cd (自己下载的文件夹)\Yolov5_DeepSort_Pytorch-master

pip install -r requirements.txt

# 测试环境

import torch

from IPython.display import Image, clear_output # 显示结果

clear_output()

print(f"Setup complete. Using torch {<!-- -->torch.__version__} ({<!-- -->torch.cuda.get_device_properties(0).name if torch.cuda.is_available() else 'CPU'})")

# 在运行过程中个别所需的库

pip install 库名 -i https://pypi.douban.com/simple

3 目标追踪实现

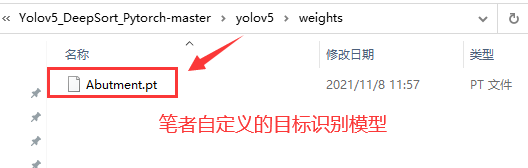

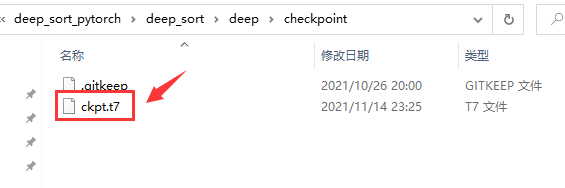

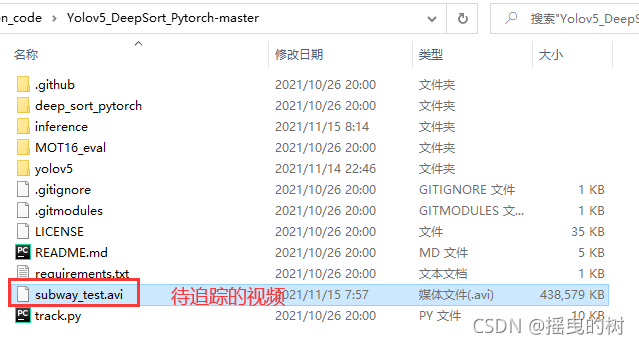

需要准备如下文件 (1)yolov5的识别模型(将模型放在.\Yolov5_DeepSort_Pytorch-master\yolov5\weights文件夹下,如图) (2)重识别/分类模型(将模型放在.\Yolov5_DeepSort_Pytorch-master\deep_sort_pytorch\deep_sort\deep\checkpoint文件夹下,如图) 链接:提取码:6cxt (3)待追踪的视频(将视频放在.\Yolov5_DeepSort_Pytorch-master文件夹下,如图)

在终端运行如下指令:

cd .\Yolov5_DeepSort_Pytorch-master

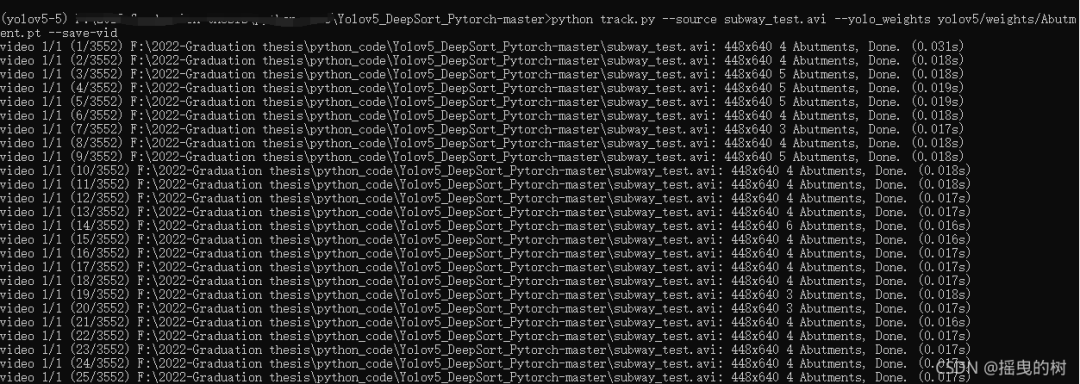

python track.py --source subway_test.avi --yolo_weights yolov5/weights/Abutment.pt --save-vid

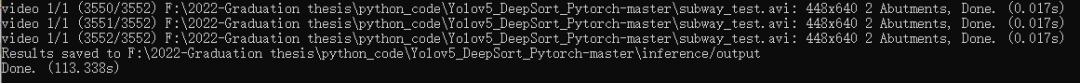

运行过程终端显示如下: 最终在

最终在.\Yolov5_DeepSort_Pytorch-master\inference\output生成结果视频:

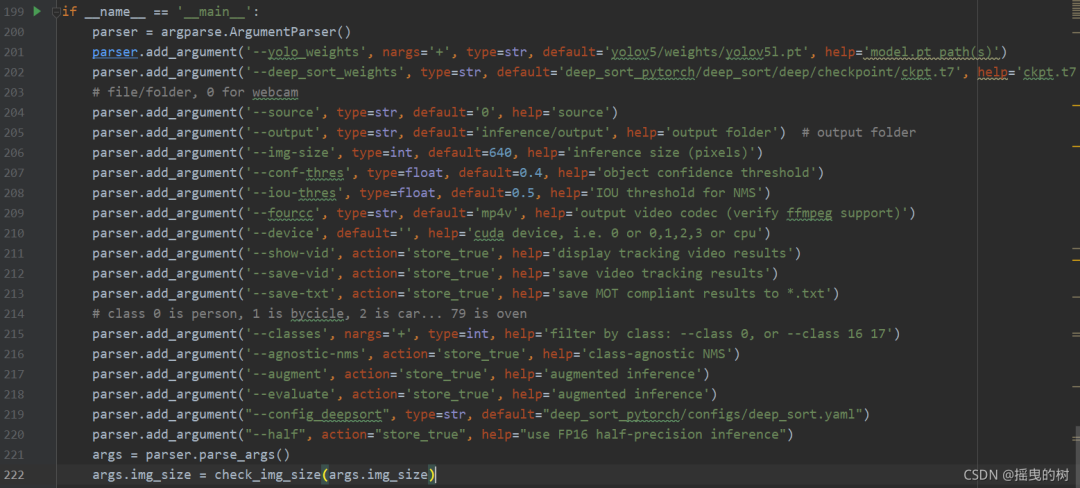

其他的参数设置可以参考

其他的参数设置可以参考track.py  综上,实现了基于自定义数据集的目标追踪

综上,实现了基于自定义数据集的目标追踪

Python“宝藏级”公众号【Python之王】专注于Python领域,会爬虫,数分,C++,tensorflow和Pytorch等等。

近 2年共原创 100+ 篇技术文章。创作的精品文章系列有:

日常收集整理了一批不错的 Python 学习资料,有需要的小伙可以自行免费领取。

获取方式如下:公众号回复资料。领取Python等系列笔记,项目,书籍,直接套上模板就可以用了。资料包含算法、python、算法小抄、力扣刷题手册和 C++ 等学习资料!