AI 修复:抗美援朝影像

点击上方“机器学习与生成对抗网络”,关注星标

获取有趣、好玩的前沿干货!

博雯 发自 凹非寺 量子位 报道 | 公众号 QbitAI

你对“历史”这个词的第一印象是什么?

很多人的脑海中最先冒出来的,或许是像下面这样粗糙颗粒、老旧模糊的黑白影片:

△图源1951年纪录片《抗美援朝》

但现在,在AI修复技术的帮助下,那些模糊的影片也能被赋予色彩:

在听到最新一批在韩中国人民志愿军烈士遗骸将于9月2日被移送回国的消息之后,“AI修复师”大谷Spitzer便再一次用这种独特的方法,表达了自己的哀思。

而共青团中央官博也转发了这段AI上色后的特殊视频,并表示:

山河无恙,英雄不朽。

历史并非黑白无声

就如同电影《你好,李焕英》中,那段仿佛“一脚踏入现实”的从黑白到彩色的镜头一样。

当这段70年前的纪录片染上色彩之时,我们这些观者也不禁有一种向历史踏近了一步的感觉。

有穿着绿色军装,扛着红旗前行的小战士们:

有挤在绿皮火车上,与自己的亲朋好友告别的军人们:

还有踩在黄色土地上,从鸭绿江上横跨而过的队伍:

制作者大谷Spitzer表示,“每次修复这些历史影像,都能给我带来很大的震撼”。

而在之前的“让革命先烈露出微笑”的项目中,他也解释了自己所认为的“AI修复的意义”:

我会把它定义成五分钟彼岸的一个概念。

就是说,在这种纷繁复杂的现代社会中,可能抽个五分钟去看一段古代的影像,或者以前的影响,看看当时的古人们是如何生活的,他们所思所想是怎样的。

AI如何修复

对于这次修复,大谷坦言,“技术难点在于多人物镜头的修复”。

因此,他使用了支持TensorFlow、Flink等多种计算框架的机器学习平台PAI。

在平台中,他增加了更多参考帧,并与其他的AI上色分辨率提升模型进行拼合,最终达到了很好的修复效果。

而在之前的项目中,大谷Spitzer也对自己所使用的AI修复技术进行了详细解释。

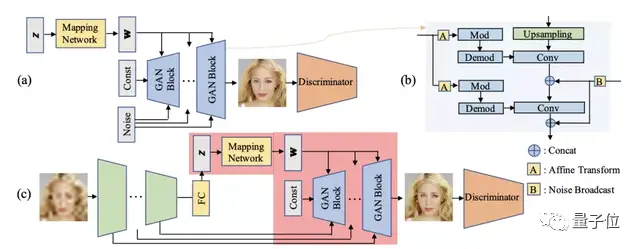

比如,用于脸部高清增强的是GAN先验嵌入式网络,也就是GPEN(GAN prior embedded network)。

这一网络架构会将GAN先验网络嵌入到深度神经网络(DNN)中,并从中进行微调。

上色的则是基于NoGAN技术的DeOldify,这种新型的GAN训练模型能够解决视频中物体闪烁等问题:

此外,还有负责视频帧插值的RIFE,用于脸部生成的Artbreeder,以及增加分辨率的Topaz Labs。

那些相隔百年的对视

其实在AI修复技术愈发成熟的今天,已经有越来越多的项目开始用到这项技术。

比如大谷Spitzer在去年就做过“晚清时期的北京”影像修复,玩了一把百年前的“老北京Vlog”:

而今年五月四日,央视还在AI修复节目《彩绘中国·觉醒》中展示了一段彩色的五四运动现场:

这一节目的执行编导说到他们为老影像进行修复上色的初衷,只是“想还原一段历史”。

因为当时的人们并非生活在黑白无声的世界里。

我们所有的努力就是想向老影像致敬并以电影的体验方式呈现出来,以此把观众带入到那段时空当中去,感受一百年前人们的精神风貌。

这也正像是这位网友所说的那样:

我们周围的高技术越多,就越需要人的感情。

最后附上完整视频:

参考链接:

[1]https://weibo.com/2395607675/KuLYKfPO7?filter=hot&root_comment_id=0&type=comment

[2]https://www.qbitai.com/2020/05/14211.html

[3]https://www.qbitai.com/2021/07/25886.html

版权声明

猜您喜欢:

CVPR 2021 | GAN的说话人驱动、3D人脸论文汇总

附下载 |《TensorFlow 2.0 深度学习算法实战》

附下载 | 超100篇!CVPR 2020最全GAN论文梳理汇总!