一些Camera相关概念整理

一些Camera相关概念,你可能听过,但可能没了解过,内容为网络资源整理~~

1) 人眼特性

2) 帧、场

3) BLC(Black level correction)

4) Binning

5) Video Size

6) 防红眼中的红眼

7) 色调映射

8) 一些光源的名称

9) 什么是3D sensing?

10) 慢镜头视频

11) 超高速摄像头凝时拍摄

12) 图像分割

13) 平坦区

14) 纹理区

15) 清晰边缘

16) Bayer CFA

17) Distortion

18) Artifacts

19) CIE1931

20) 色彩偏移

21) 枯叶图

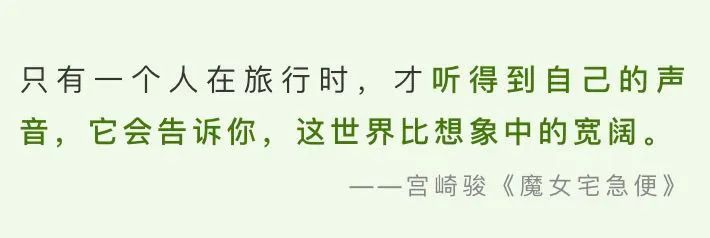

一、人眼特性

97 million rods(杆细胞)

4.6 million cones(锥细胞)

1 million 节细胞 100w节细胞

视网膜里有大约1.25亿个视杆细胞和视锥细胞,它们扮演感光器的角色。

其中视杆细胞的数量是视锥细胞的18倍之多。

视杆细胞对弱光敏感(可感受到一个光子),主要负责在昏暗环境中产生暗视觉,但只能辨别明暗,不能分辨物体的细节和颜色。97 million rods(杆细胞)

视锥细胞感受强光和颜色,产生明视觉,对物体细节和颜色分辨力强,我们能够读书看报,视锥细胞功不可没。4.6 million cones(锥细胞)

视杆细胞和视锥细胞接收到的信息随后被传送给视网膜上的近100万个节细胞。

这些节细胞将来自视杆细胞和视锥细胞的信息通过视神经发送到大脑。

视锥细胞有 3种,分别含有对红、绿、蓝3种光敏感的感光色素。

色光引起色觉,这是一种复杂的物理和心理现象。

根据三原色学说解释色觉的机制认为:不同的色光作用于视网膜时,3种视锥细胞产生了不同程度的兴奋,这样兴奋信息经处理后转化为不同组合的视神经冲动,

传到大脑皮层就产生不同的色觉。

例如红、绿、蓝3种视锥细胞兴奋程度的比例为4:1:0时,产生红色色觉;比例为2:8:1时,产生绿色色觉。

人眼可分辨波长在380~760nm约150种颜色,

但某些人多由于遗传因素,缺乏相应的视锥细胞,不能辨别某些颜色,称为色盲。

如缺乏感受红光或绿光的视锥细胞,不辨红绿,称为红绿色盲。

有些人多由于健康或营养不佳,辨色能力较差,称为色弱。

二、帧、场

活动电视图像是由一幅一幅连续的且内容变化不大的静止图像组成的。

其中一幅静止的图像在电视技术上称为“一帧”。

为了保证收看图像时不闪烁,根据人眼的视觉暂留特点(先前出现在人眼的图像在图像消失后会保留一段时间),要求每秒传送的连续图像达到25帧。

在电视传输技术中,为了进一步提高传输质量,又将一帧图像分成两幅来传,这时候的一幅就叫做“一场”了。

三、BLC(Black level correction)

模拟信号很微弱时,有可能不被 A/D 转换出来,导致光线很暗时,图像细节丢失。

因此,Sesnor 会在 A/D 转换前,给模拟信号一个固定的偏移量,保证输出的数字信号保留更多的图像细节。

黑电平校正模块就是通过标定的方式,确定这个偏移量的具体值。后续的 ISP 处理模块,需要先减掉该偏移值,才能保证数据的线性一致性。

四、Binning

Camera Binning Mode:像素合并模式,将相邻的像素单元电荷通过物理的方法叠加在一起作为一个像素输出信号

水平方向Binning: 同列相邻行的电荷叠加;

垂直方向Binning: 同行相邻列的电荷叠加;

1)Binning Mode 优势:

增加感光面积,提高暗处对光感应的灵敏度;应用:增加物理感光像素单元,采用像素合并模式,提升暗处对光感应的灵敏度;

2)Binning Mode 劣势:

降低输出分辨率;

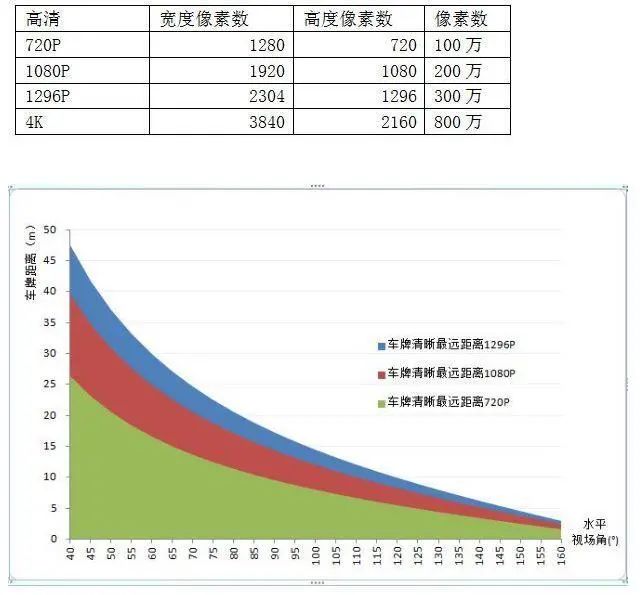

五、Video Size

1)FHD Video: 1920 * 1080 -16:9 30 fps

2)HD Video: 1280 * 720 -16:9 60 fps

3) VGA Video: 640 * 480 -4:3 120 fps

4) 4K 视频拍摄 3840x2160 30fps

5) 1080p 视频拍摄 1920x1080 30fps

6) 720p 视频拍摄 1280x720 30fps

7) 480p 视频拍摄 720x480 30fps

8) 慢动作视频, 720p 120fps

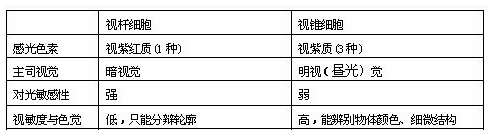

举个例子,水平视场角120度的行车记录仪,720P最远可拍清楚5.5米距离的车牌,大概一个车身的距离。

而1080P则可拍清楚8.3米的车牌,大概1个半车身的距离。而1296P则可拍清楚10米远外的车牌,约为2个车身的距离。

1、720P和1080P的区别仅为分辨率的上的区别。

2、1080P的画面分辨率为:1920x1080

3、720P的画面分辨率为:1280x720

4、720P中的“720”指的是画面分辨率,“P”指的是逐行扫描。一般的帧率有60帧,30帧,25帧,24帧。

以下是几种常见的扫描格式:

D1为480i格式,和NTSC模拟电视清晰度相同,525条垂直扫描线,480条可见垂直扫描线,4:3 或16:9,隔行/60Hz,行频为15.25KHz。

D2为480P格式,和逐行扫描DVD规格相同,525条垂直扫描线,480条可见垂直扫描线4:3 或 16:9,分辨率为640×480,逐行/60Hz,行频为31.5KHz。

D3为1080i格式,是标准数字电视显示模式,1125条垂直扫描线,1080条可见垂直扫描线16:9,分辨率为1920×1080,隔行/60Hz,行频为33.75KHz。

D4为 720p格式,是标准数字电视显示模式,750条垂直扫描线,720条可见垂直扫描线16:9,分辨率为1280×720,逐行/60Hz,行频为45KHz。

D5为1080p格式,是标准数字电视显示模式,1125条垂直扫描线,1080条可见垂直扫描线16:9,分辨率为1920×1080逐行扫描,专业格式。

高清网络摄像机中,我们通常叫成百万、两百万像素摄像机:

1080P 实际是指分辨率1920*1080像素 ——计算一下就是1920×1080=2073600像素 大家一般都会叫 1080p或1080i为200万像素分辨率

960P 实际是指分辨率1280*960像素 ——计算一下就是1280×960=1228800像素大家一般都会叫960p或960i为130万像素分辨率

720P 实际是指分辨率1280*720像素——计算一下就是1280×720=921600像素大家一般都会叫720p或720i为百万像素分辨率

1、XGA 分辨率 1024*768

2、VGA 分辨率 640*480

3、UXGA 分辨率 1600x1200

六、防红眼中的红眼

由于视网膜上的血管丰富,夜晚,用闪光灯拍照时,瞬间的强光令瞳孔来不及收缩,反而会放大以便让更多的光线通过,这样,光线便透过瞳孔投射到视网膜上。

视网膜的血管就会在照片上产生泛红现象,人的眼珠便呈现出一片红色,即人们常说的“红眼”。

七、色调映射

指对图像颜色进行映射变换的算法。

目的是调整图像的灰度,使得处理后的图像人眼看起来更加舒适,能更好的表达原图里的信息与特征。

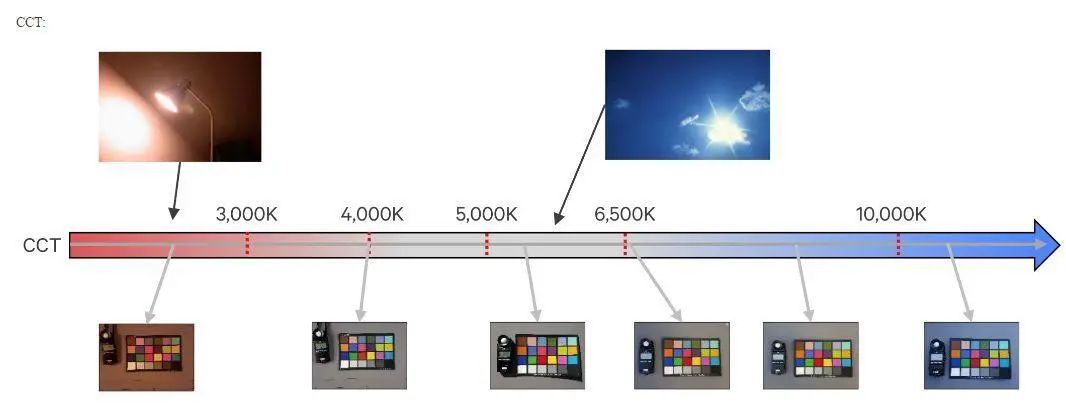

八、一些光源的名称

Tungsten:钨光,Horizon

Warm Fluorescent:A

Shade:D75

Strobe:闪光灯

Fluorescent:荧光灯 即CWF、TL84

Daylight Fluorescent:日光荧光灯

Incandescent:白炽灯,A,H

Neutral-density filter :

中性灰度镜(Neutral Density Filter)又叫中灰密度镜,简称ND镜,其作用是过滤光线。

这种滤光作用是非选择性的,也就是说,ND镜对各种不同波长的光线的减少能力是同等的、均匀的,只起到减 弱光线的作用,而对原物体的颜色不会产生任何影响,因此可以真实再现景物的反差。

九、什么是3D sensing?

3D Sensing 从字面意思理解,就是将原来 2D 的摄像头转换为 3D 数据,不仅让成像显得立体,更让每一个像素能够除了 x、y 轴数据外,还有 z 轴(深度 / 距离)数据。

所以简单的说 3D Sensing 就是原有的摄像头再新增一个测算深度数据的模块。

目前 3D Sensing 主要由发射端与接收端构成。不同的路径有着不同的器件结构,一般有激光发射器(VCSEL 发射端)、wafer-level optics ( WLO ) 、Sensor 这几个结构。

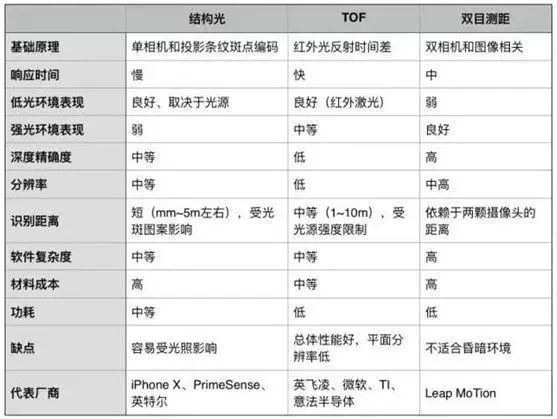

目前 3D Sensing 市场上有三种方案,成熟度按照从高到低顺序排列为:结构光、TOF 和双目。

其中最成熟的结构光方案已大量应用于工业 3D 视觉领域,而 TOF 方案已出现在 Google 的 Project Tango 方案中,双目由于算法开发难度高,在不在乎功耗的机器人、自动驾驶等新兴领域应用较多。

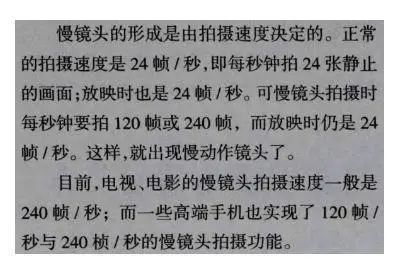

十、慢镜头视频

电影摄影中的一种技术手段,“电影是每秒钟24画格的真理。”

为了实现一些简单的技巧,就要改变正常的拍摄速度,比如高于24格/秒,拍摄速度达到50帧/秒、100帧/秒,甚至更高。

回放速度依旧为24帧/秒,这就相当于把实际1秒钟拍摄的图像用2秒多到4秒多时间回放,这就是我们口中说的慢镜头效果。

如果降低拍摄速度(低于24格/秒),放映效果就是快动作。

960fps 超高帧率的慢动作录影,并用 30fps 的帧率输出影片。

• 960fps/30fps=32x

这意味着即使是手机也具备 32 倍的慢动作录影能力,相较于 Google Pixel 所具备的 240fps 录影,Sony Xperia XZs、XZ Premium 的超慢动作录影还要慢了 4 倍,并且所搭载的感光元件图像记录速度上要快 5 倍,过往需要 40ms(毫秒)记录的影像仅需要 8ms 即可纪录完成,这也大幅减低了滚动快门效应。

大家不少新款手机,像iPhone X已支持1080/240P慢动作视频,但慢动作视频会削弱画质,并占用大量储存空间,不是一个常用功能。

1、120fps是每秒播放120帧,也可以理解为每秒播放120张图片。240fps是每秒播放240帧,也可以理解为每秒播放240张图片。

两者相对而言,播放慢动作的话,后者可以播放慢动作更慢。

2、iphone6可以达到慢动作240fps,一般相对而言的话,帧数越高,可能造成的画面相对于60帧有些模糊。

产生这种情况的原因是摄像头和图像处理器性能相同,数值越大,相对图像越模糊。

经常念叨的“果冻”,或者是拍到现场有相机闪光灯的只拍到 了一条亮线,根源都是 CMOS的滚动快门造成的。

1.滚动快门(electronic rolling shutter,又名卷帘快门)

目前大多数CMOS传感器采用这种快门。对任一像素,在曝光开始时现将其清零,然后等待曝光时间过后,将信号值读出。因为数据的读出是串行的,所以清零/曝光/读出也只能逐行顺序进行,通常是从上至下,和机械的焦平面快门非常像。和机械式焦平面快门一样,对高速运动的物体会产生明显的变形。而且因为其扫描速度比机械式焦平面快门慢,变形会更加明显。例如如果数据的读出速度是每秒20帧,那么图像顶部和底部的曝光先后差异将多达50毫秒。为了弥补这个缺陷,通常数码相机中通常配合机械快门,曝光开始时整个图像传感器清零(目前的绝大多数传感器都具备快速清零功能,可以在几个时钟周期内完成整个传感器的清零),然后机械快门打开,曝光结束后机械快门关闭,数据顺序读出。

2.全局快门(global shutter/snapshot shutter)

最主要的区别是在每个像素处增加了采样保持单元,在指定时间达到后对数据进行采样然后顺序读出,这样虽然后读出的像素仍然在进行曝光,但存储在采样保持单元中的数据却并未改变。

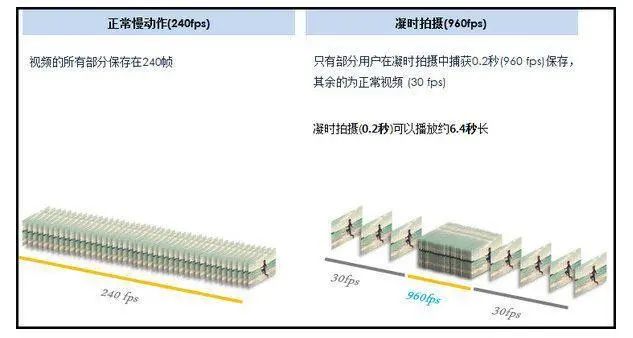

十一、超高速摄像头凝时拍摄

凝时拍摄(960fps)是一个功能可以让用户使用超高速摄像头在960fps条件下录制视频,并通过以正常视频(30fps)的32倍慢速播放捕捉人类肉眼通常无法观察到的镜头并且以使用现有慢动作功能(240fps)的4倍慢速进行。

正常的视频(30fps):

视频的速度与实际运动一样了。

慢动作视频(240fps):

视频播放比正常人慢8倍,类似于典型的电影,商业,或运动速度。

凝时拍摄视频(960fps):

图像的播放比正常人慢32倍,捕捉小的变化在面部表情和快速移动物体的细微的动作。

在慢动作(240fps)中,所有视频片段都是以240fps进行保存的。

而凝时拍摄(960fps)中,只有用户在超高速条件下拍摄的0.2秒视频以960fps进行保存,其余部分为普通视频(30 fps)。因此凝时拍摄(960fps)存储的视频相对较小。

960fps慢动作摄影是什么?

首先是fps的定义,指的是一个图像或视频画面每秒传输帧数,通俗来讲可以理解为我们常说的“刷新率”。这个数字越高,动态画面看起来就越连贯。

当一个视频帧数高达960fps,就已经超越“顺畅”的领域,只有用慢动作视频才能够完全展示。

这项技术在专业的影视领域用的比较多。举个例子,当我们观看赛车时,高速赛车呼啸而过连车型都看不清;而应用高帧数的慢动作拍摄,就可以完整看清赛车本身通过观众席的全过程,而不只是一个影子。

十二、图像分割

就是按照一定的特征如灰度,色彩,空间纹理,几何形状等将一幅图像分割为若干部分或子集的技术过程。

分割质量的好坏直接影响图像分析和处理的结果。

十三、平坦区

是指不包含明显边缘,像素变化相对平缓的区域。

十四、纹理区

是指检测出边缘相对密集,并存在一些伪边缘的区域纹理区内的边缘分布呈现一定的周期性,因而存在某些纹理特征。

十五、清晰边缘

是指边缘特征明显,可以被传统边缘检测算子检测出的图像边缘清晰边缘。

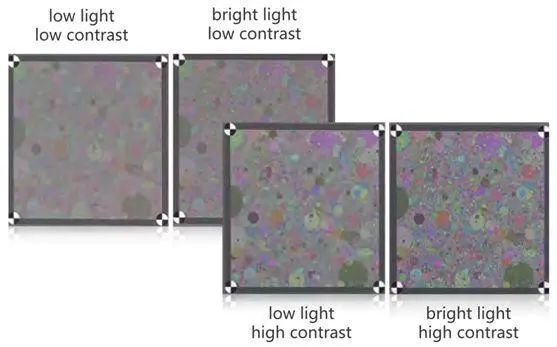

常见图例:

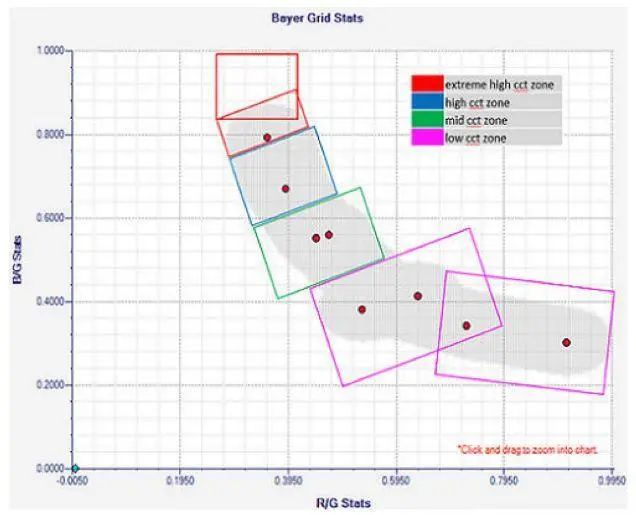

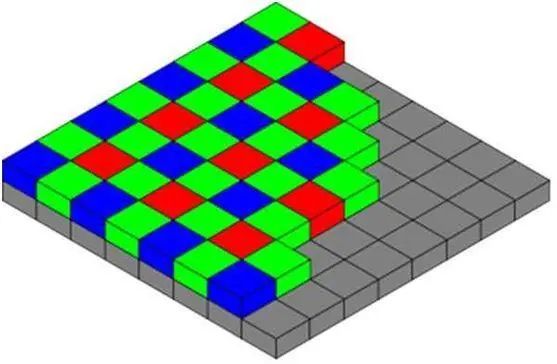

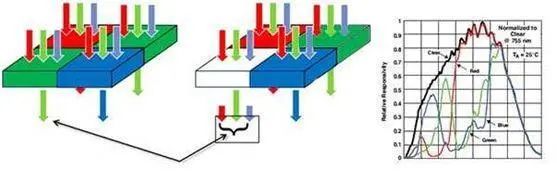

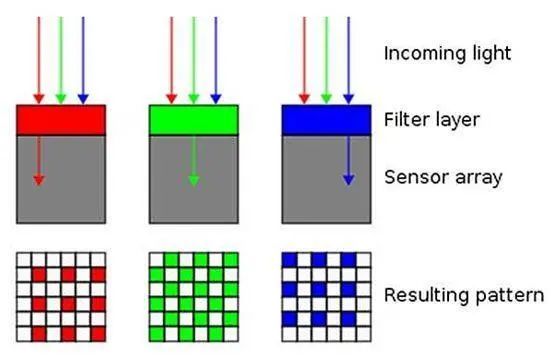

十六、Bayer CFA

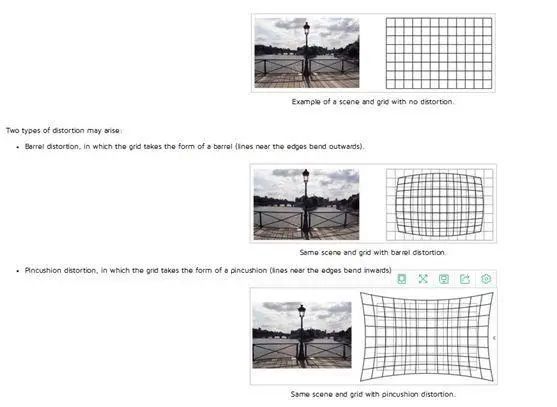

十七、Distortion

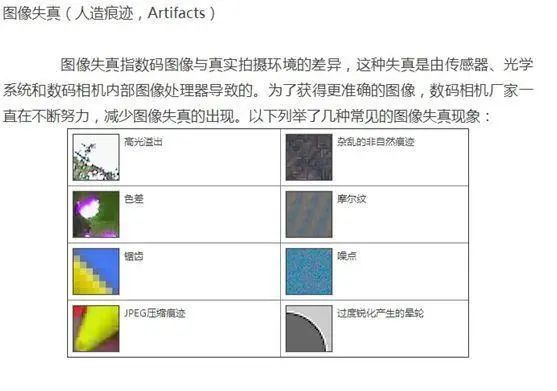

十八、Artifacts

十九、CIE1931

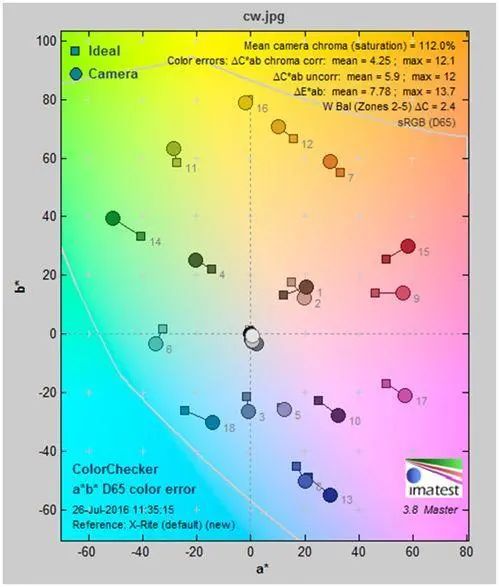

二十、色彩偏移

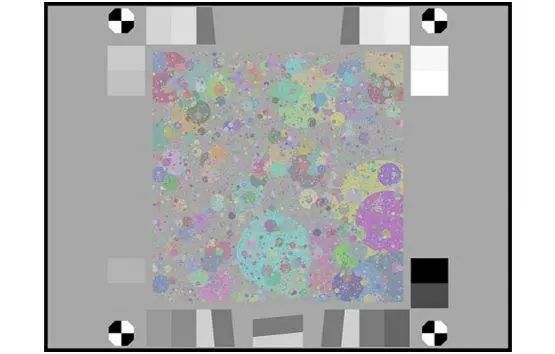

二十一、枯叶图

彩色落币图是枯叶图的升级设计是为了测量纹理清晰度。

比起旧版的枯叶图它有几大优势:包括为提高测量精度和鲁棒性不变的比例,左右两边的灰色区域有助于去除噪声(使用的一种技术叫做灰块噪声的功率光谱密度是从中心溢出区域的信号和噪声总和的PSD中减去得到的。)

觉得不错,点个赞呗~