通俗易懂的解释Sparse Convolution过程

来源:信息网络工程研究中心 本文约2400字,建议阅读10分钟 本文作者运用简单的举例和图片对稀疏卷积这一工作进行了详细的阐述。

前言

一、为什么提出稀疏卷积?它有什么好处?(可以跳过这个先看卷积过程)

二、举例子之前的定义

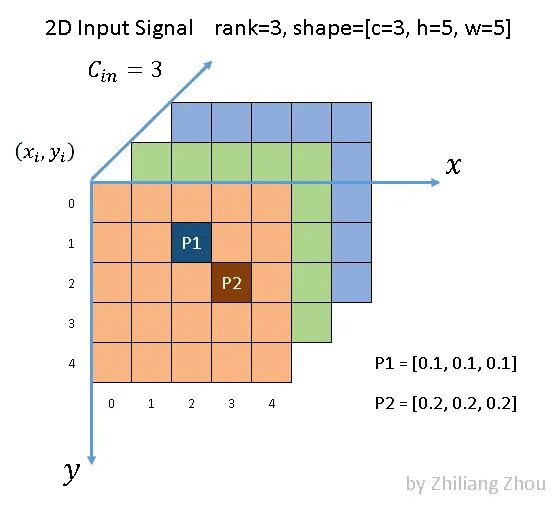

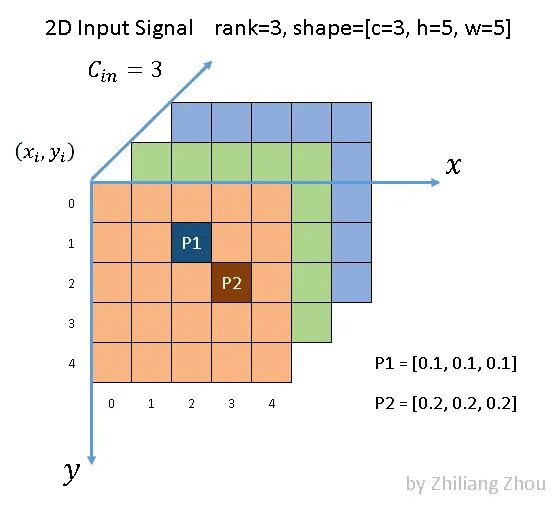

1. 输入定义

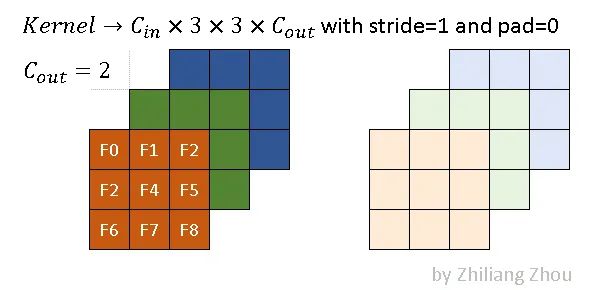

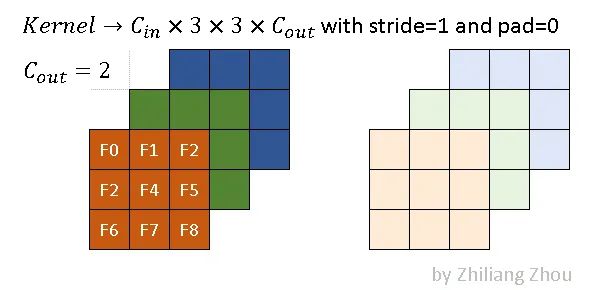

2. kernel 定义

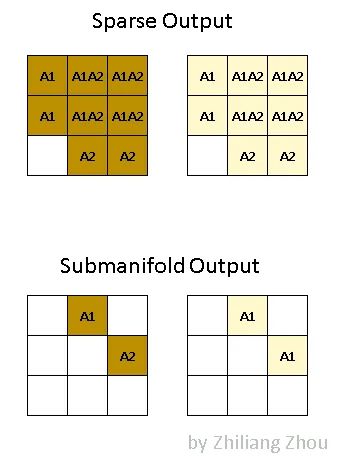

conv2D(kernel_size=3, out_channels=2, stride=1, padding=0)3. 输出的定义

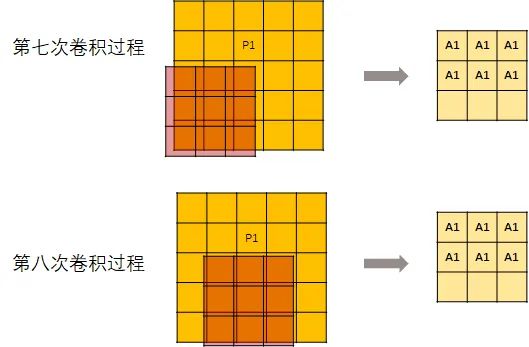

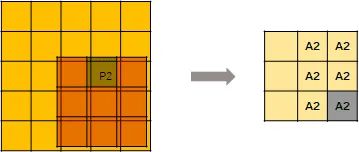

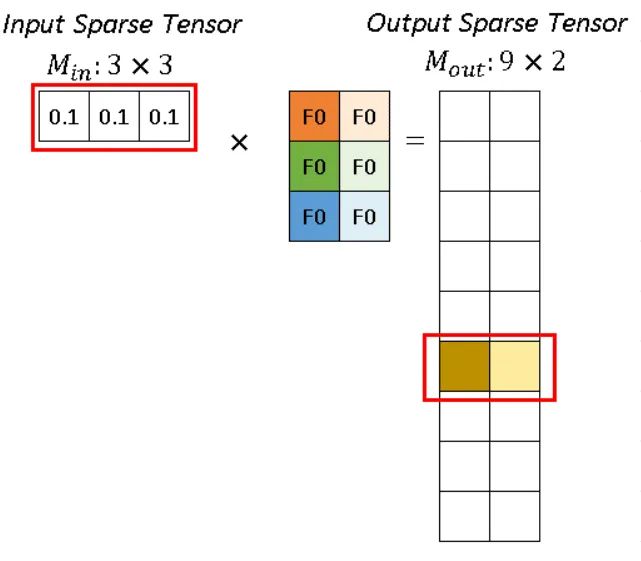

三、稀疏卷积的计算过程

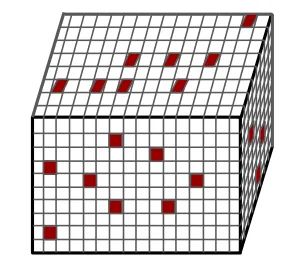

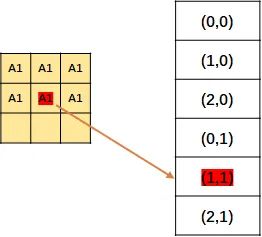

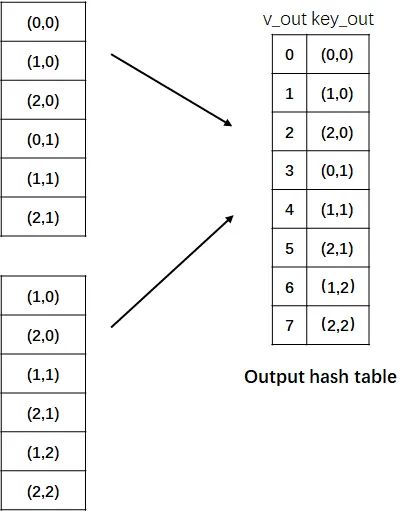

1. 构建 Input Hash Table 和 Output Hash Table

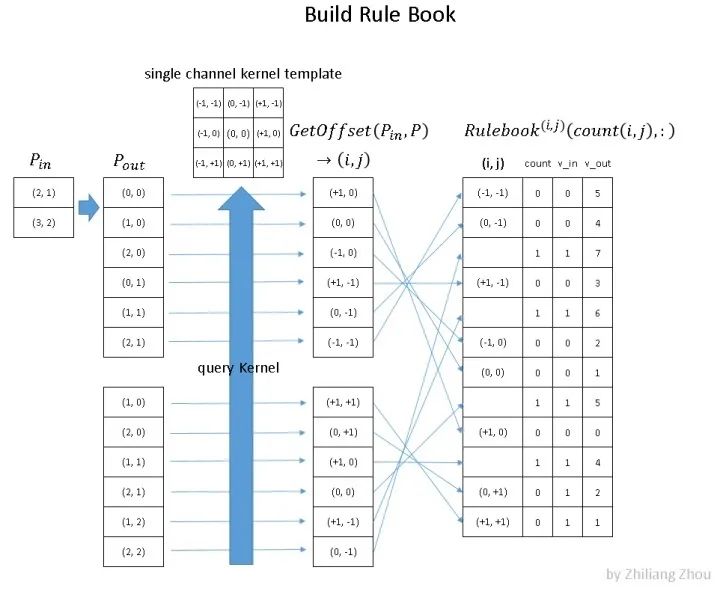

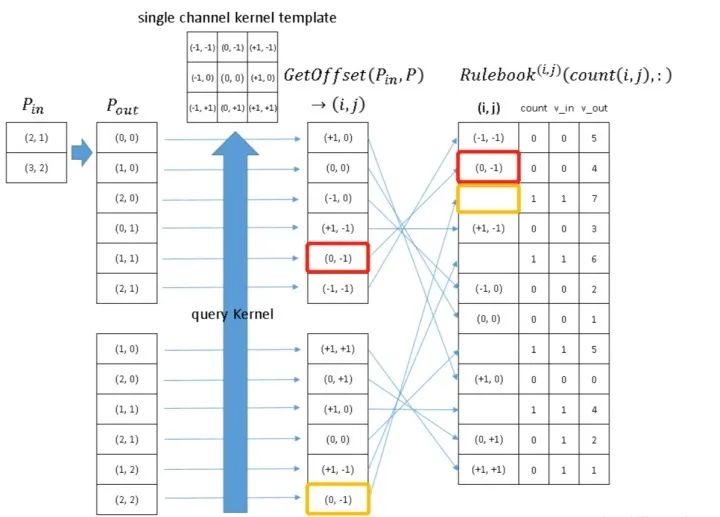

2.构建 Rulebook

3. Computation Pipeline

conv2D(kernel_size=3, out_channels=2, stride=1, padding=0)

四、总结

编辑:黄继彦

评论