深度解析移动机器人的几种视觉算法

极市导读

如果对移动机器人视觉算法进行拆解,你就会发现获取物体深度信息、定位导航以及壁障等都是基于不同的视觉算法,本文就带大家聊一聊几种不同但又必不可少的视觉算法组成。 >>加入极市CV技术交流群,走在计算机视觉的最前沿

移动机器人的视觉算法种类

Q:实现定位导航、路径规划以及避障,那么这些过程中需要哪些算法的支持?

深度信息提取 视觉导航 视觉避障

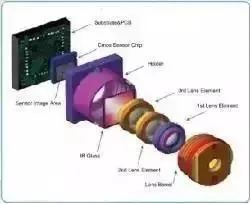

视觉算法的基础:传感器

Q:智能手机上的摄像头可以作为机器人的眼睛吗?

Q:计算机视觉中还会用到什么传感器?

算法一:深度信息提取

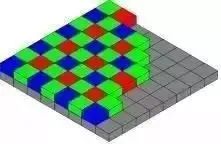

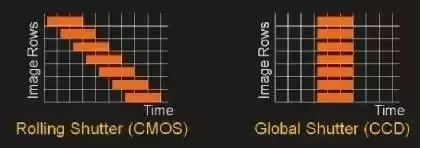

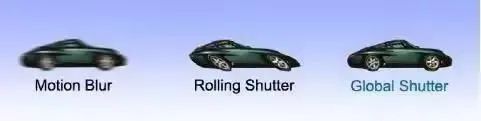

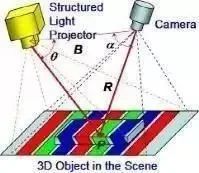

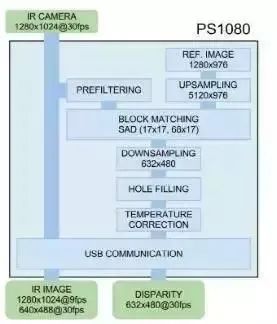

Q:深度相机如何识别物体的深度信息的呢?

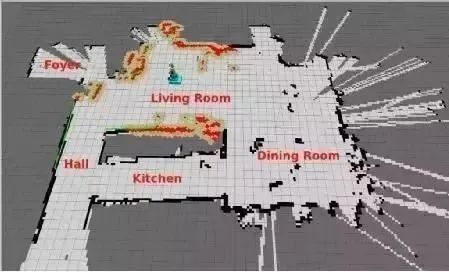

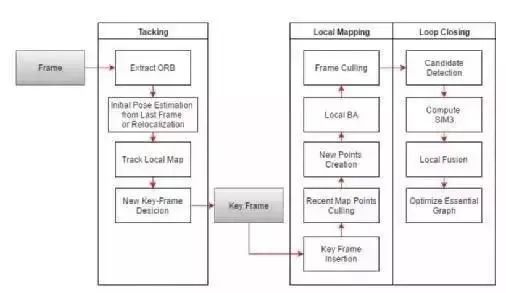

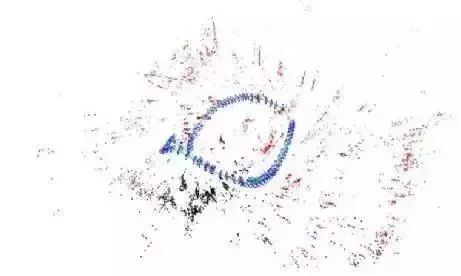

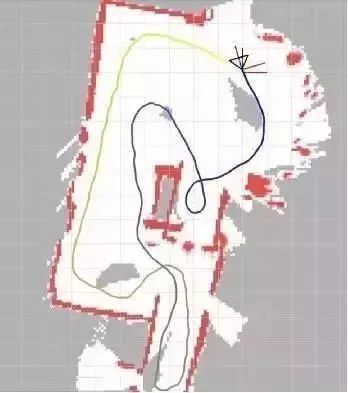

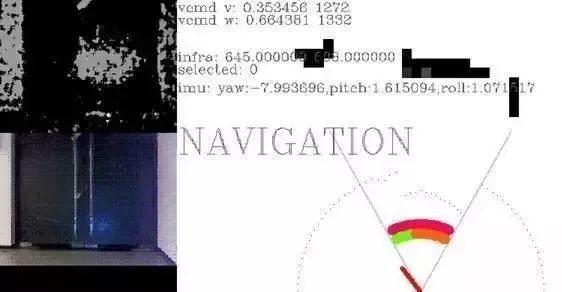

算法二:定位导航

Q:视觉处理后,机器人是如何实现导航的?

Q:视觉VSLAM在机器人上的实现有哪些难点?

针对尺度问题,有两种方法解决:增加一个摄像头形成双目SLAM系统,或者增加一个IMU形成松耦合/紧耦合的视觉惯导定位系统。这里简单介绍松耦合的视觉惯导定位系统。一般把VSLAM当成一个黑盒子,将其的输出作为观测量放到一个基于IMU的EKF系统中,EKF最终fuse的输出即是系统的输出。

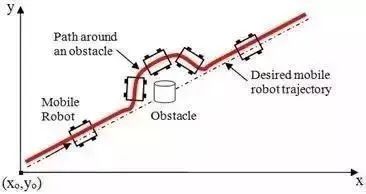

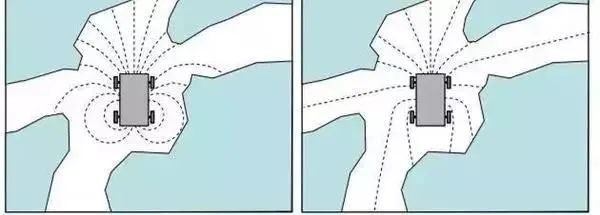

算法三:避障

Q:视觉避障的算法原理是怎样的?

精彩问答

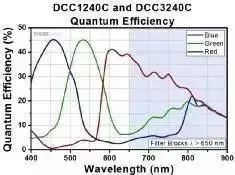

Q:为什么选用ir相机而不是传统的rgb相机呢?ir相机相对来讲的优势在哪里?

Q:现在机器人导航是否主要是slam技术,还有没其他导航技术?主要流行的slam技术有哪些?用于无人驾驶和无人机的视觉导航技术有哪些异同?

Q:现在有无用于机器人导航的导航地图存在,类似车载导航地图?用于机器人导航的地图数据有哪些?

后台回复关键字“生日快乐”即可参与领取666元现金红包~

“

点击阅读原文进入CV社区

收获更多技术干货

评论