数据湖存储架构选型

一、数据湖是个潮流

熟悉 Hadoop 整个生态的话,过去经常会谈到一个非常大的、非常复杂的生态的大图。那个图里面涉及到非常多的组件,结构关系非常复杂。而基于数据湖的架构,可以得到大大的简化。

熟悉 Hadoop 整个生态的话,过去经常会谈到一个非常大的、非常复杂的生态的大图。那个图里面涉及到非常多的组件,结构关系非常复杂。而基于数据湖的架构,可以得到大大的简化。

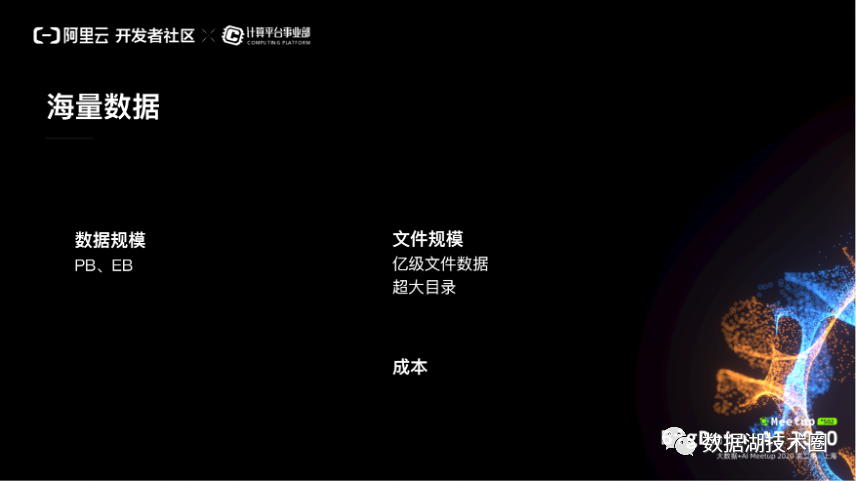

二、湖存储/加速:挑战很大

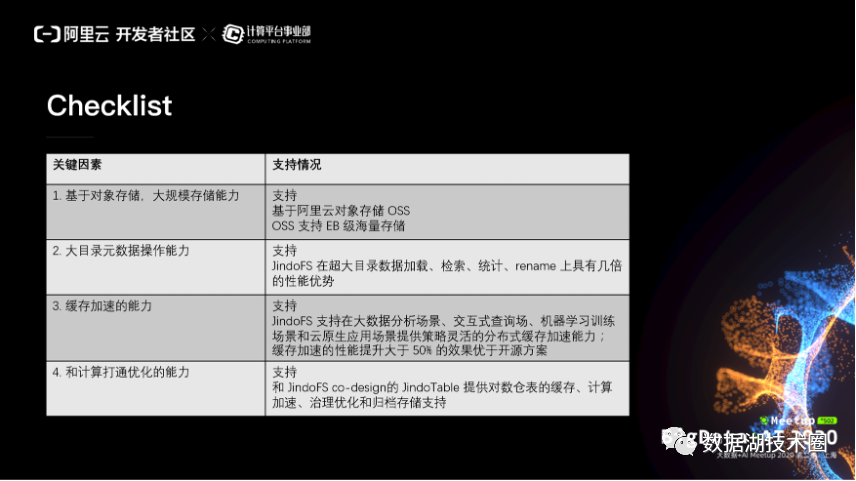

三、完美选项之 checklist

第一, 基于对象存储,大规模存储能力。

第二,大目录元数据操作能力。

第三,策略灵活的缓存加速能力。

第四,和计算打通优化的能力。

第五,支持数据湖新型表格存储的能力。

第六,归档/压缩/安全存储的能力。

第七,全面的大数据+ AI 生态支持。

第八,强大迁移能力,甚至是无缝迁移能力。

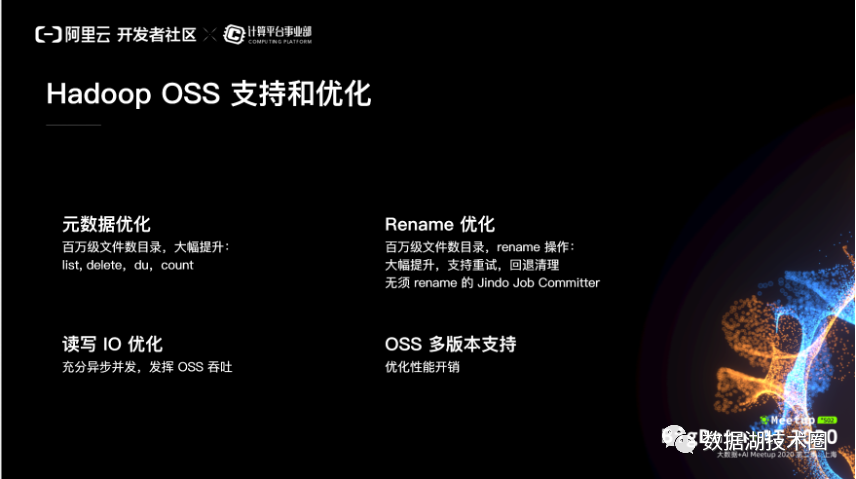

四、阿里云上的 JindoFS

第一,基于对象存储,大规模存储能力。支持,基于阿里云对象存储 OSS , OSS 支持 EB 级海量存储。 第二,大目录元数据操作能力。支持,JindoFS 在超大目录数据加载、检索、统计、rename 上具有几倍的性能优势。 第三, 缓存加速的能力。支持,JindoFS 支持在大数据分析场景、交互式查询场、机器学习训练 场景和云原生应用场景提供策略灵活的分布式缓存加速能力;缓存加速的性能提升大于 50% 的效果优于开源方案。 第四,和计算打通优化的能力。支持,和 JindoFS co-design 的 JindoTable 提供对数仓表的缓存、计算加速、治理优化和归档存储支持。

第五,支持数据湖新型表格存储的能力。支持,JindoFS 提供 Delta 、Hudi 和 Iceberg 所需要的存储接口和事务支持语义,并支持 Flink 实时入湖。 第六,归档/压缩/安全存储的能力。支持, JindoFS 在目录、表、分区级别支持 OSS 归档;提供透明压缩;支持 AK 免密保护,Ranger 授权和审计扩展功能。 第七,全面的大数据+ AI 生态支持。支持,JindoFS 全面兼容和支持开源生态,提供:Hadoop JindoFS SDK;Jindo Job Committer ; POSIX fuse 支持 JindoFuse ;TensorFlow FileSystem ;Flink connector ;Kite SDK 。 第八,强大迁移能力甚至是无缝迁移的能力。部分支持,提供优化的 JindoDistCp 工具,支持 Hadoop 数据源导入。

评论