想成为NLP算法工程师,你必须要看一下这10篇论文!

微软亚洲研究院成立20周年时表示:NLP将迎来黄金十年。

ACL2019NLP进展趋势也主要包括:预训练语言模型、低资源NLP任务(迁移学习/半监督学习/多任务学习/主动学习)、模型可解释性、更多任务&数据集。

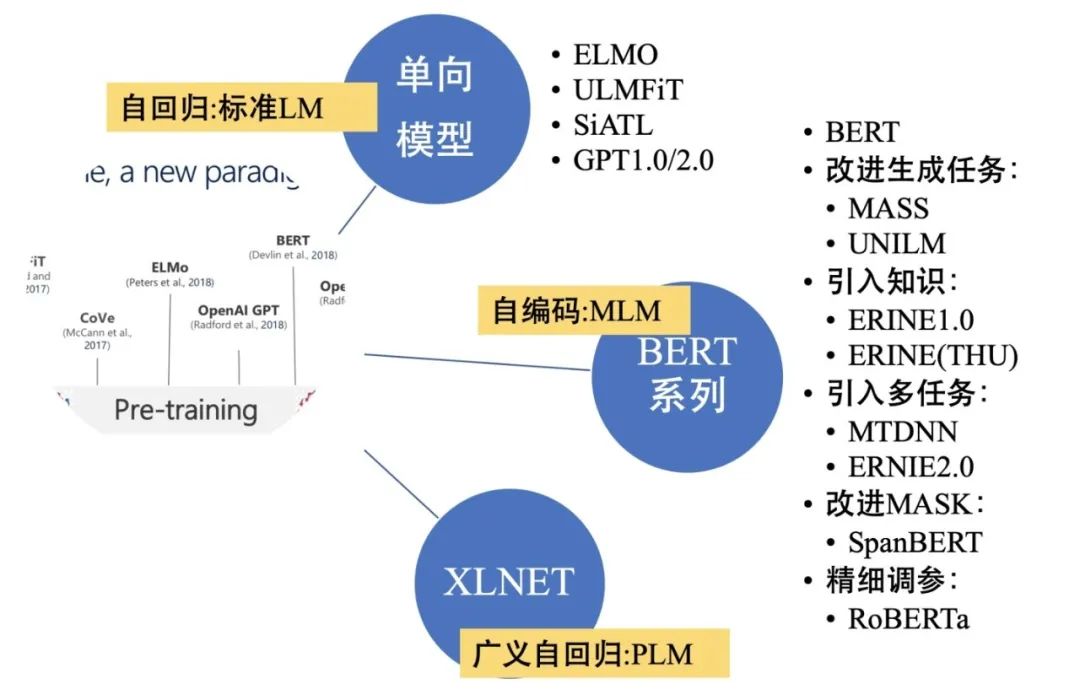

【预训练语言模型】已经形成了一种新的 NLP 范式:使用大规模文本语料库进行预训练,对特定任务的小数据集微调,降低单个 NLP 任务的难度。

预训练模型最开始是在图像领域提出的,获得了良好的效果,近几年才被广泛应用到自然语言处理各项任务中。

预训练模型的应用通常分为两步:

第一步:在计算性能满足的情况下用某个较大的数据集训练出一个较好的模型;

第二步:根据不同的任务,改造预训练模型,用新任务的数据集在预训练模型上进行微调。

预训练模型的好处是训练代价较小,配合下游任务可以实现更快的收敛速度,并且能够有效地提高模型性能,尤其是对一些训练数据比较稀缺的任务。

今天,给大家推荐的这10篇学术论文,都是经典中的经典,对大家在学习预训练模型时有很大帮助。其中有图灵奖得主的经典之作,也有最强的特征提取器、最强的NLP模型、最全的大规模预训练模型,还有ACL2020最佳论文。

10篇经典人工智能学术论文

这些论文是由老师尽心挑选的,非常适合对预训练模型有所了解的同学、有一定基础的NLP同学、对词向量有了解的同学、合适NLP知识进阶同学等。

长按扫码添加

本号只有200个名额

↓ ↓ ↓

备注【论文】添加?

最后,给大家推荐为期三天的《文本生成任务——GPT系列模型训练营》,主要讲述最强特征提取器Transformer理论原理解读;GPT1、GPT2、GPT3演进过程;文本生成任务等。8月10号晚上7:30开班,感兴趣的同学也可以扫描上面二维码咨询哦!

评论