图灵奖得主Yann LeCun发推道歉!Google AI黑人女科学家批其种族歧...

新智元原创

编辑:鹏飞,永上

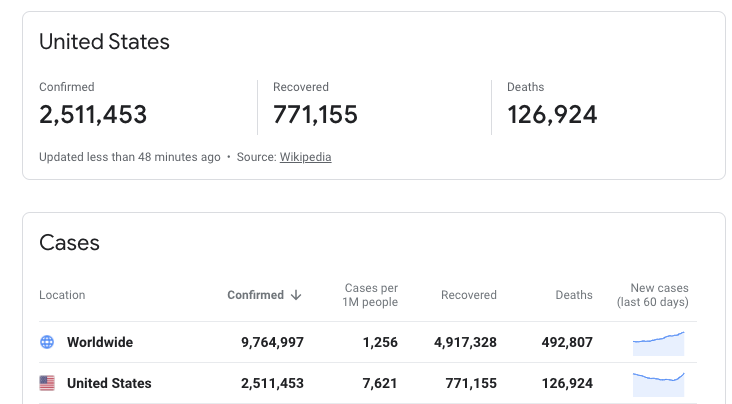

【新智元导读】BLM运动已经延伸至AI界。Yann LeCun此前发推称当数据有偏差时,ML系统就会有偏差。在白人为主的数据集训练后,生成的人脸偏白;在黑人为主的数据集训练后偏黑。遭到网友声讨。LeCun随后向提出质疑的黑人女科学家道歉。

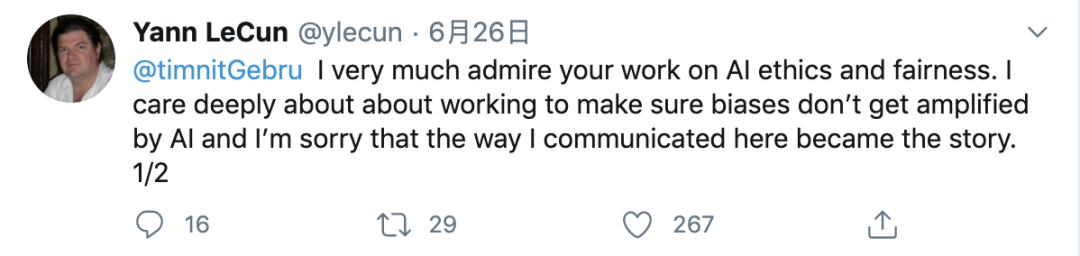

最近,图灵奖得主、人工智能标杆人物Yann LeCun,因为一则言论被群攻,迫不得已出来道歉。而这起事件的导火索,正是最近突然爆火的PULSE算法。

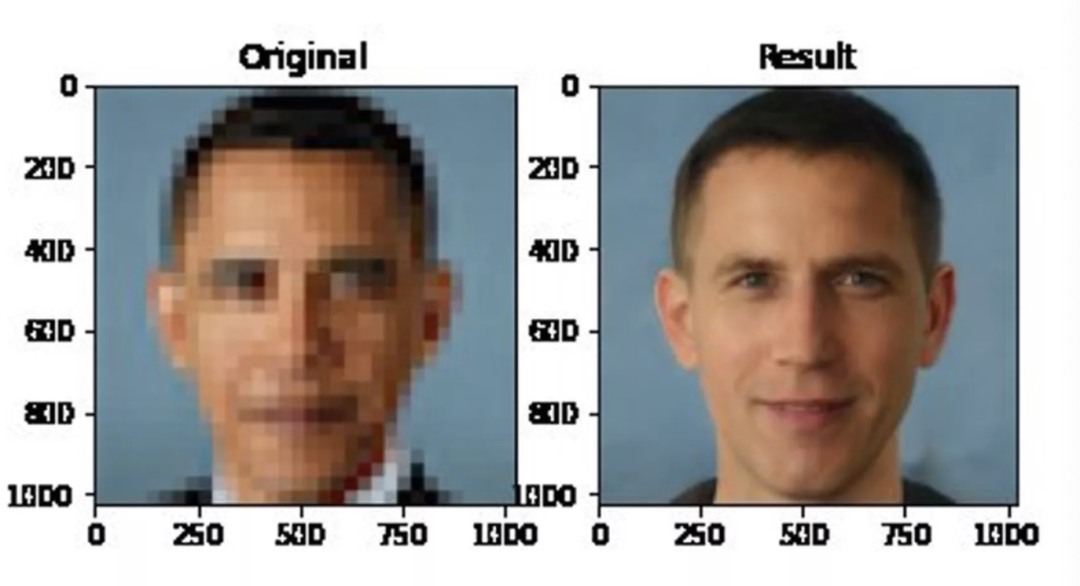

该算法由杜克大学推出,可以将模糊的照片秒变清晰,效果出奇的好。这项研究在CVPR 2020上发表,论文标题为《PULSE:通过对生成模型的潜在空间探索实现自监督照片上采样(PULSE:Self-Supervised Photo Upsampling via Latent Space Exploration of Generative Models)》。

一张照片引发AI社区大争议,Yann LeCun发推先解释后道歉

有人发现,将一张奥巴马的模糊照片,用PULSE洗出来以后,变成了一个白人!真•洗白?

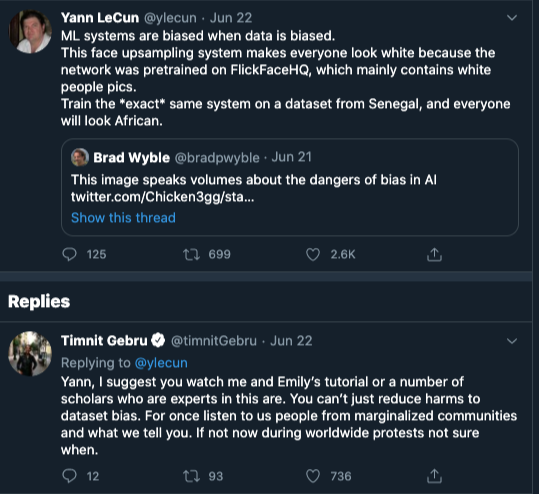

她直接回复Yann LeCun:「Yann,我建议你看看我和Emily的教程,或者这方面专家学者的东西。你不要只是将罪魁归结为数据集偏见,听听我们这些来自边缘化社区的人的说法」

她直接回复Yann LeCun:「Yann,我建议你看看我和Emily的教程,或者这方面专家学者的东西。你不要只是将罪魁归结为数据集偏见,听听我们这些来自边缘化社区的人的说法」

她指出,人工智能中的偏见受到更广泛的社会不公正和偏见的影响,仅仅使用「正确」(完美的、没有偏见)的数据并不能解决更大的不公正问题。将AI学术问题,上升到了社会伦理层面。 她甚至在Timnit Gebru的推下面提及Yann LeCun,直呼:「恶心!」

她指出,人工智能中的偏见受到更广泛的社会不公正和偏见的影响,仅仅使用「正确」(完美的、没有偏见)的数据并不能解决更大的不公正问题。将AI学术问题,上升到了社会伦理层面。 她甚至在Timnit Gebru的推下面提及Yann LeCun,直呼:「恶心!」

在「最黑暗的时代」依然坚持深度学习研究,如今被拉下「神坛」

Yann LeCun,当今世界人工智能领域,甚至被有些人奉为「神一样的人物」。

网友:这种问责很可能造成寒蝉效应,研究人员不再公布完整的来源

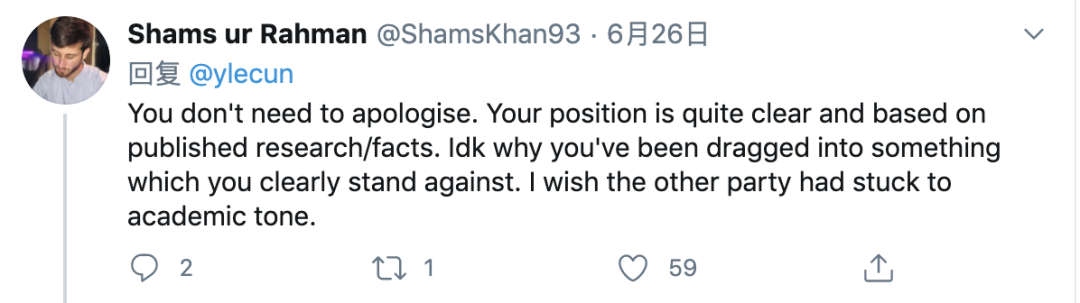

its_a_gibibyte表示有点儿懵:「我到现在都没整明白LeCun说错啥了?他不就解释了导致AI的偏见的原因和造成的结果吗?」 WittyKap0跟its_a_gibibyte解释:「这条推是没错啦。但是在随后的一条推中,他把这个问题扔给了业界,称这不是研究人员应该关注的问题,而是应该由业界做部署的工程师去解决的。结果Pytorch之父就不干了,源头没做好指望下游给你收拾烂摊子吗?顺便还讽刺了LeCun在FB工作。」 nonotan看不下去了:「我懂,研究人员至少应该提供某种程度的证据,证明他们的工作在实验中的情况,并给出更多的传统绩效指标。这将是一个很好的方向,没有任何问题。但归根结底,研究者的工作不是提供市场上可用的产品啊!难道那不是ML工程师的工作吗?作为一个ML工程师,你说『我只是从网上随便抓了一些模型,作为我的生产流水线的一部分使用,没有任何验证或监督。如果出了问题,就怪作者没有阻止我这个白痴』这是人话吗?而且这种问责很可能造成一种寒蝉效应,研究人员为了尽量不担责任,不愿意公布完整的来源/训练过的权重/等等。坦率地说,如果你按字面意思来理解他所写的东西我认为完全没有问题。我觉得只是因为人们发现LeCun没有重视或者支持他们的事业而感到不满。」 Deto提出了一个非常有意思的观点:「他是不是觉得人们只是扫了一眼这篇文章(而不是实际阅读——说实话,真没几个人能认真读完),然后可能会错误地认为种族主义意图被研究人员以某种方式,有意地编码到这些模型中?所以他想直接澄清这个细节。」 Shams在Twitter上发表评论,认为LeCun没有支持不公正事件的发生,不需要道歉。「你的立场很明确,而且是基于已经发表的科学研究。我不知道你为什么被卷进一件你明显反对的事件中。我希望对方能够坚持学术论调。」

评论