(附论文)基于混合鸟瞰边缘的自动代客泊车语义视觉SLAM

共 2428字,需浏览 5分钟

·

2021-07-11 19:54

点击左上方蓝字关注我们

转载自 | 泡泡机器人

标题:Hybrid Bird’s-Eye Edge Based Semantic Visual SLAM for Automated Valet Parking

作者:Zhenzhen Xiang, Anbo Bao and Jianbo Su

机构:Shanghai Jiao Tong University,the Department of Automation

来源:ICRA 2021

链接:https://www.zhenzhenxiang.xyz/publication/icra2021/

摘要

基于视觉的定位和建图解决方案有望在自动代客泊车任务中采用。本文提出了一种在鸟瞰图像上利用混合边缘信息的语义SLAM框架。为了从合成的鸟瞰图图像和自由空间轮廓中提取有用的边缘以用于SLAM任务,设计了不同的分割方法,以消除视图合成中逆透视变换(IPM)所导致的嘈杂的眩光边缘和扭曲的对象边缘。由于只要自由空间分割模型需要训练,因此与以前的基于道路标记的方法相比,我们的方法可以大大减少标签负担。这些不正确和不完整的边缘分别通过局部地图中连续边缘的时间融合来进一步清理和恢复。语义边缘点云图和占据栅格图都可以同时实时构建。停车场中的实验表明,与以前的基于点特征的方法相比,所提出的框架可以实现更高的准确性和更强大的性能。

主要工作与贡献

提出了一种混合语义信息提取方法,该方法结合了经典的无监督边缘检测器和一组基于IPM的边缘分割方法。自由空间粗糙地分割,大大减少了标注数据的负担。使用IPM先验知识,可以过滤掉嘈杂和扭曲的边,例如眩光的边缘和扭曲物体轮廓。

将自由空间内的鸟瞰边缘和自由空间的轮廓组合为混合边缘,再进行定位和建图。

算法流程

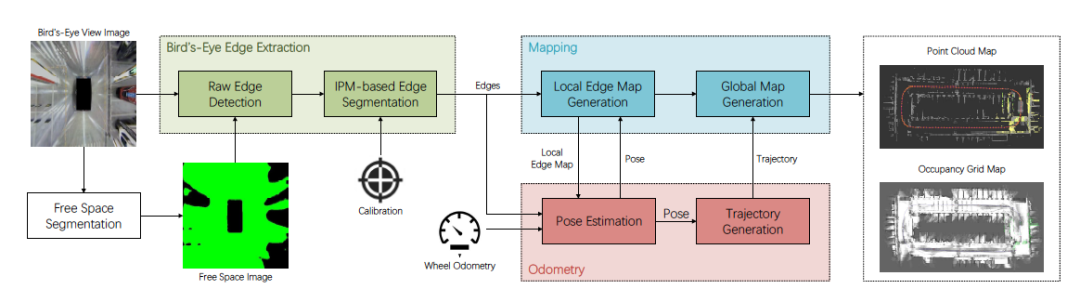

上图所示的是系统流程图,系统框架可划分为:Bird’s-eye edge extraction、Mapping、Odometry三部分。

1.鸟瞰边缘提取

A.原始边缘检测

借助自由空间分割,可以去除地面上物体内部的边缘。但仍然包含大量来自眩光和被 IPM 扭曲的物体的干扰边缘。因此,这些边缘在发送到建图和里程计模块之前需要进一步处理。

B.基于IPM边缘分割,介绍三种不同方法的分割

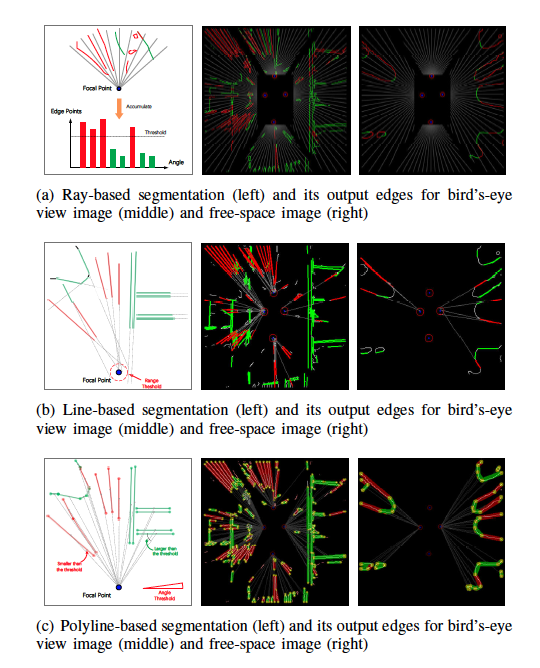

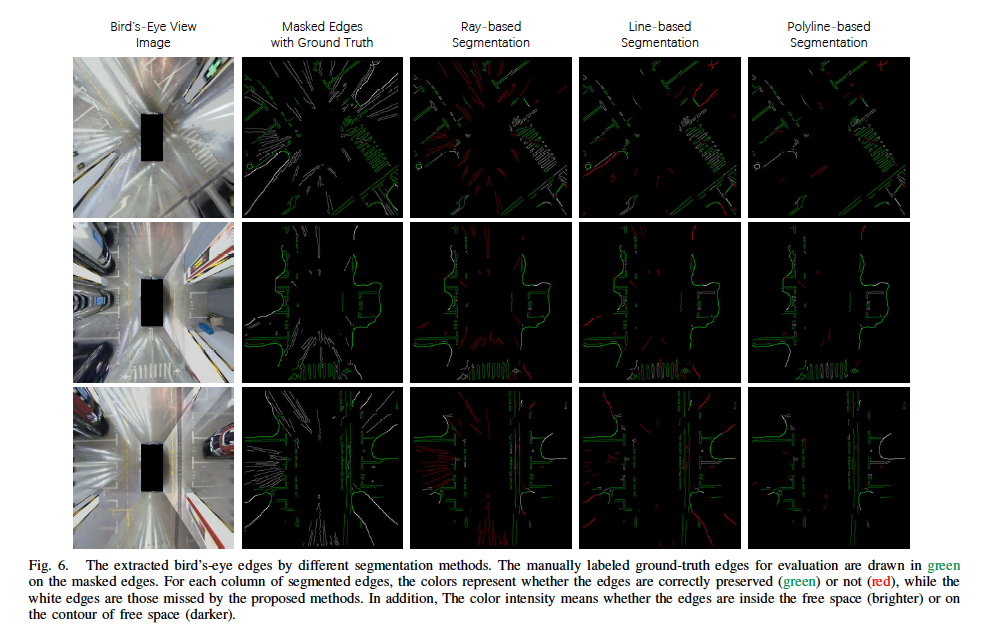

图4.不同边缘分割方法及其结果的图示。红色边缘被分割成IPM扭曲的边缘,并将其去除。绿色边缘保留用于建图和里程计模块。

基于射线分割法:

虽然射线分割法能够简单、快速去除部分扭曲的边,但是缺陷也是明显的。第一,扭曲的边缘通常不是直的,预先设定angle bins的分界线,导致长的扭曲边容易被划分成两部分。第二,由于没有考虑边的结构,容易将小而密集的边错误地去除掉。第三,由于角度步长和阈值是耦合的,调整基于射线的分割参数也很困难。

基于线段分割法:

考虑到边的几何分布,本文试图检测线段分割方法,如图4(b)所示。通过线段检测器检测得到线段,计算相机焦点与每条线段之间的距离,并与距离阈值进行比较。非常靠近焦点的线段被标记为扭曲的边。

优点:减少沿特定径向方向错误地去除密集边缘的可能性;检测参数和分割阈值划分明确。

缺点:那些与不相连边的点容易错误的的认为是同一部分;距离相机较远的扭曲边,很难满足条件被去除。

基于折线分割法:

分割前,区分不同边的实例,然后在对每个边实例,使用Douglas-Peucker算法简化边缘并生成折线,如图4(c)所示。线段与焦点连接线段的虚线形成一个夹角,一般扭曲边的线段与焦点连线形成的夹角都很小。

优点:简化了线估计,限制折线成为边实例。

缺点:与线段分割法相比,用两条线的方向向量的之间的夹角作为一个评估方式有点不明智,尤其是在远离相机的那些边。

2.语义里程计和建图

利用鸟瞰边缘和自由空间的的混合点云,建立语义 SLAM 系统。

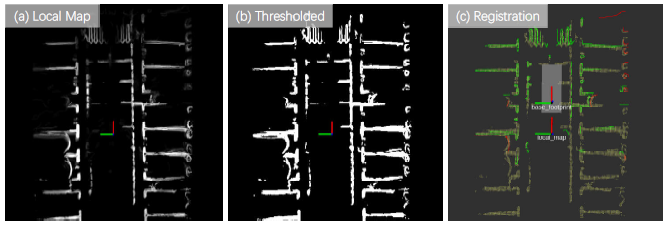

图 5. 用于姿态估计的局部地图生成管道,包括(a)累积概率局部地图,(b)阈值局部地图和(c)提取的边缘(绿色是鸟瞰边缘,红色是自由空间边)加入到局部地图。

A.局部地图的建立

交替地在连续帧中累积提取的边缘并构建局部边缘图以获得更稳定的运动估计。图5显示的是局部地图的示例,不同帧的融合是概率性的。为了平稳地更新局部地图并填补小间隙,使用高斯滤波器对加入到局部的边进行一个筛选处理。增加滑动窗口融合机制,去除已经在局部地图中的被错误分割的边。

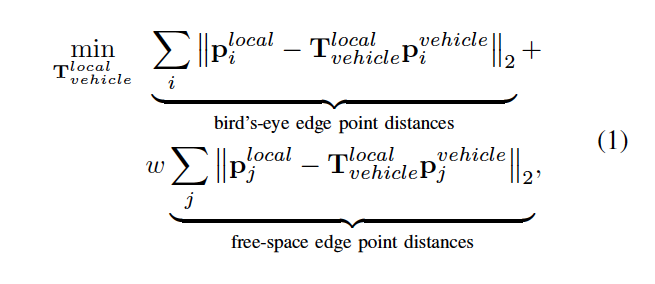

B.位姿估计

融合的局部边地图被阈值化并转换为世界坐标中的点云。为了估计当前车辆在局部地图中的姿态,首先通过车轮里程计的变换将当前帧中边点投影到局部地图上。通过最近邻搜索建立数据关联。最后,可以通过解决以下问题来估计局部地图车辆中的当前位姿:

C.全局地图

由于提取的自由空间边缘也可以被视为 2D LiDAR 测量,因此不仅可以同时构建语义点云图,还可以同时构建占用网格图。当局部地图之间检测到回环时,执行正常位姿图优化以校正漂移。

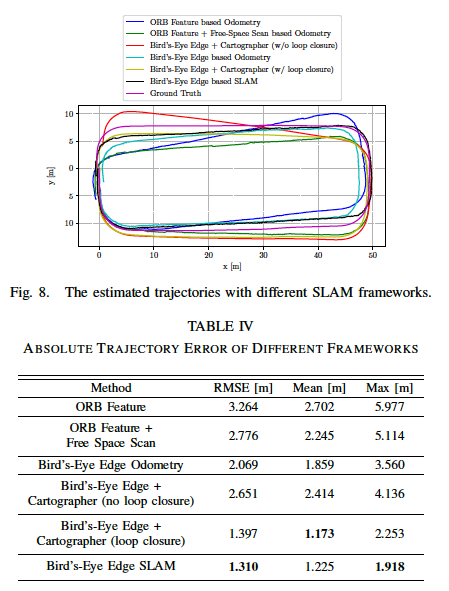

实验结果

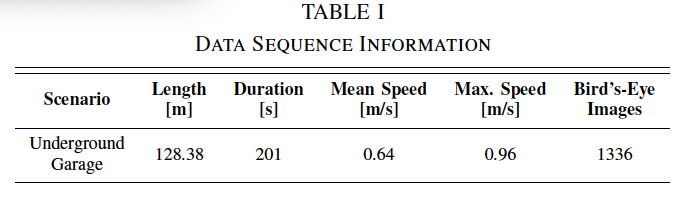

1.实验数据信息

合成鸟瞰图大小为384×384,覆盖车辆周围15.3 m×15.3 m的区域。ground truth trajectory通过车轮里程计和高精度 IMU 测量值的融合来计算的。

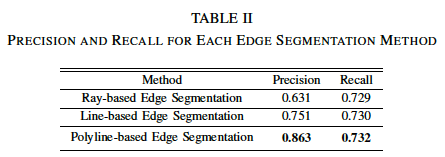

2.鸟瞰边缘提取

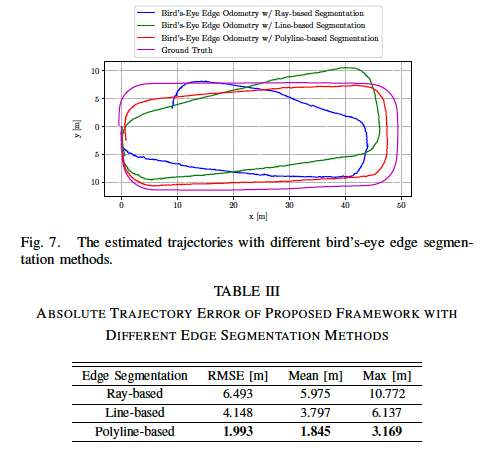

3.语义里程计和建图

END

整理不易,点赞三连↓